Cara Mengajari AI untuk Ragu: Komputasi Saat Inferensi dan Seni Penerjemahan yang Dipertimbangkan

Lompat ke bagian

Lompat ke bagian

Bagikan

Bagikan

Bagikan

Alat Penerjemah Video AI, Lokalisasi, dan Dubbing

Coba secara Gratis

Cara Mengajarkan AI untuk Bimbang

Beberapa hari lalu, saya menemukan sebuah klip YouTube. Pembawa berita Sohn Suk-hee sedang mewawancarai novelis Kim Ae-ran. Pertanyaannya adalah "Apa yang dimiliki manusia yang tidak dimiliki AI?", dan jawabannya adalah "Keraguan."

Sang novelis menyinggung satu momen dari salah satu siaran lama pembawa berita itu. Saat membacakan berita wafatnya mendiang Roh Hoe-chan, seorang aktivis buruh yang kemudian menjadi politisi, ia kehilangan kata-kata selama dua puluh detik. Momen menahan kata-kata, bimbang, dan memilah—itulah keraguan. AI tidak mampu melakukan ini. Namun, keraguan manusia menjadi penghiburan dan kesopanan.

Itu terjadi sekitar dua puluh tahun lalu, saat saya sedang fokus mengembangkan sebuah game tembak-menembak. Seorang rekan tim dalam pemodelan karakter 3D menyerahkan sebuah buku kepada saya sambil berkata, "Teman SMA saya seorang novelis; kamu harus membaca ini." Pengamatan yang mendalam diselimuti kecerdikan. Saya langsung tenggelam di dalamnya. Buku itu adalah kumpulan cerita pendek Kim Ae-ran Run, Daddy, Run (달려라 아비). Saya telah menjadi penggemarnya sejak saat itu.

Keraguan Membutuhkan Waktu dan Ketidakpastian yang Lebih Rendah

Kim Ae-ran mengatakan otot menulisnya menguat melalui ketelitian yang menyakitkan dan pertanyaan pada diri sendiri di setiap baris. Ia mengatakan waktu yang dihabiskan di antara kalimat-kalimat menjadi bentuk pertimbangan bagi orang lain. Ia juga mengemukakan bahwa nilai sejati sastra tidak terletak pada isinya, melainkan pada bentuknya. Lalu, jika bentuk juga penting, mungkin AI bisa menirunya setidaknya secara kasar?

Dari sudut pandang fisika, waktu adalah perubahan dalam keadaan fisik. Dalam fisika, waktu belum berlalu jika keadaannya belum berubah. Jadi, semakin sedikit perubahan keadaan berarti waktu yang lebih lambat, dan semakin banyak perubahan berarti waktu yang lebih panjang. Satu detik yang singkat bagi manusia adalah, bagi AI, keabadian yang terbentang di ratusan miliar, bahkan triliunan, operasi floating-point (FLOPs). Dibandingkan perangkat lunak lama, jawaban AI belakangan ini adalah produk dari kerja keras yang panjang dan menyiksa. Ini juga alasan mengapa industri AI bisa bertumbuh dalam pendapatan sambil berjuang dalam laba. Dari sudut pandang perangkat lunak warisan, AI terlalu lambat bagi mesin. Bahkan sesuatu yang sesederhana validasi format JSON, ketika dijalankan melalui inferensi model bahasa besar, menghabiskan ratusan juta komputasi dibandingkan dengan perangkat lunak warisan.

Model bahasa besar (LLM), mesin di balik kemajuan AI belakangan ini, adalah program yang memprediksi kata berikutnya dalam sebuah kalimat. AI mengalirkan arus listrik untuk menemukan kata berikutnya. Ia berulang kali mengalikan dan menjumlahkan matriks-matriks raksasa. Komputasi AI memerlukan konsumsi fisik dari perangkat keras. Untuk memberi AI setidaknya suatu bentuk keraguan, waktu penderitaan manusia, Anda harus melewatinya melalui komputasi yang intens. Ratusan miliar operasi untuk menghasilkan satu kata berikutnya. Ratusan miliar operasi lagi menyusul untuk menghasilkan kata setelahnya.

Sebagian besar komputasi pembelajaran mendalam kontemporer melibatkan penjumlahan berbobot, dan nilai yang telah dihitung sebelumnya yang digunakan dalam penjumlahan ini dikenal sebagai parameter.

Ketika kita berbicara tentang model "Qwen 3.6 27B", artinya ada 27 miliar parameter yang siap untuk penjumlahan berbobot, sehingga membutuhkan sekitar 27 miliar perkalian hanya untuk memprediksi satu token berikutnya. Dan itu baru awalnya. Selain itu, satu perkalian bilangan bulat melibatkan puluhan operasi logis dan bilangan floating-point memerlukan ribuan. Dengan kerumitan seperti itu, orang bisa menyebutnya benar-benar membingungkan.

Menurunkan Temperatur Menajamkan Bias

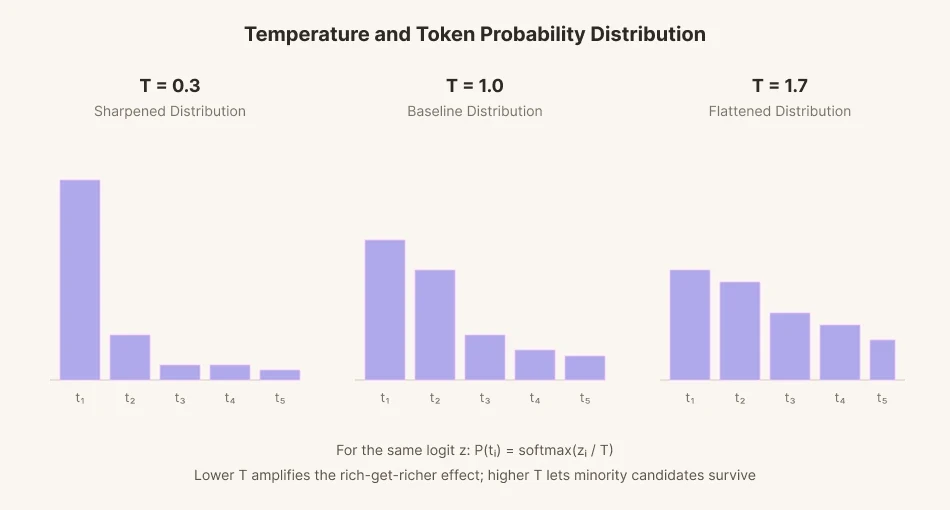

Mari kita lihat lebih dalam cara kerja LLM. Sudah menjadi pengetahuan umum bahwa deep learning, fondasi LLM, adalah mesin pencocokan pola yang menerapkan pola yang dihafal selama pelatihan ke penggunaan dunia nyata. Dua hal mengatur proses mengulang kembali itu: sampling token dan temperatur.

Untuk memprediksi satu kata berikutnya, model memberikan skor (logit) pada setiap dari puluhan ribu kata kandidat. Skor-skor itu kemudian diubah menjadi probabilitas, dan sebuah kata dipilih secara proporsional terhadap tiap probabilitas. Proses ini disebut sampling.

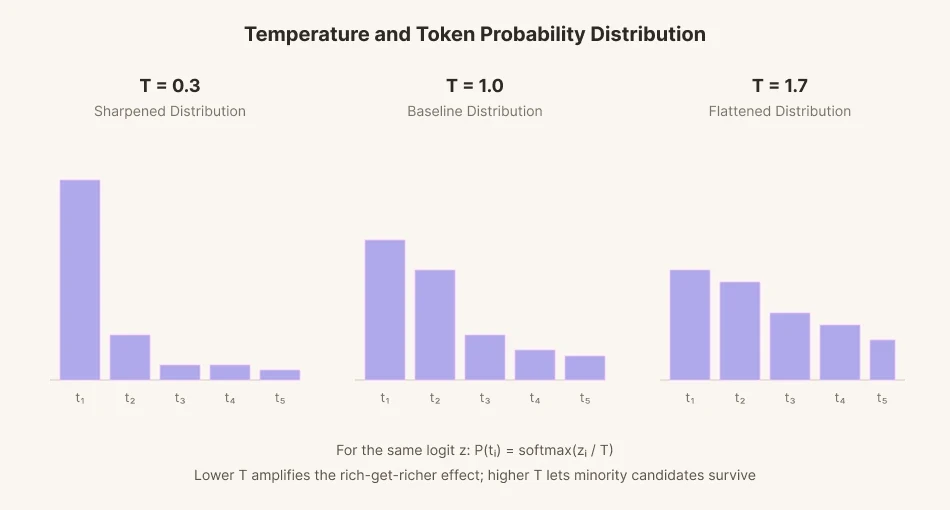

Untuk menambah variasi pada sampling, diperkenalkan parameter matematis yang disebut "temperatur". Turunkan temperatur, dan jarak antara skor kandidat terbentang sampai ke ekstrem. Kata-kata dengan probabilitas tinggi dipilih lebih sering daripada kata-kata pada garis dasar. Kata-kata dengan probabilitas rendah dipilih lebih jarang lagi. Ini mirip dengan bagaimana yang kaya makin kaya dan yang miskin makin miskin. Sebaliknya, jaraknya menyempit ketika temperatur naik. Kesenjangan menjadi rata, lalu seimbang. Kata-kata berprobabilitas rendah yang biasanya akan dilewatkan, bisa dipilih dengan tingkat yang lebih tinggi ketika temperatur naik.

Bahasa manusia mirip dengan ini. Kelompok dan budaya tempat saya berada tercermin dalam distribusi probabilitas bahasa saya. Bahasa yang lebih dingin dan tajam menghasilkan ujaran yang lebih rasional, lebih dioptimalkan, dan lebih selaras dengan mayoritas. Bahasa yang lebih hangat dan membulat kurang rasional dan kurang optimal, tetapi mempertimbangkan minoritas.

Pertimbangan adalah tindakan menghabiskan energi ekstra untuk keluar dari distribusi probabilitas pikiran sendiri. Ini berarti memperhatikan apa yang ditutupi oleh mayoritas, dan menemukan kalimat yang biasanya tidak digunakan. Apa yang digambarkan penulis sebagai proses menulis yang menyakitkan, bagi AI, seharusnya menjadi tindakan menolak respons yang hanya didasarkan pada pelatihan yang bias, dan berusaha menempuh jalan melampauinya.

Kegelisahan Mekanis

Bagaimana kita bisa mengajarkan AI untuk bersikap penuh pertimbangan? Anda tidak bisa membiarkannya langsung memuntahkan kata dengan probabilitas tertinggi. Itu hanya mengekspor bias yang melekat pada data pelatihan.

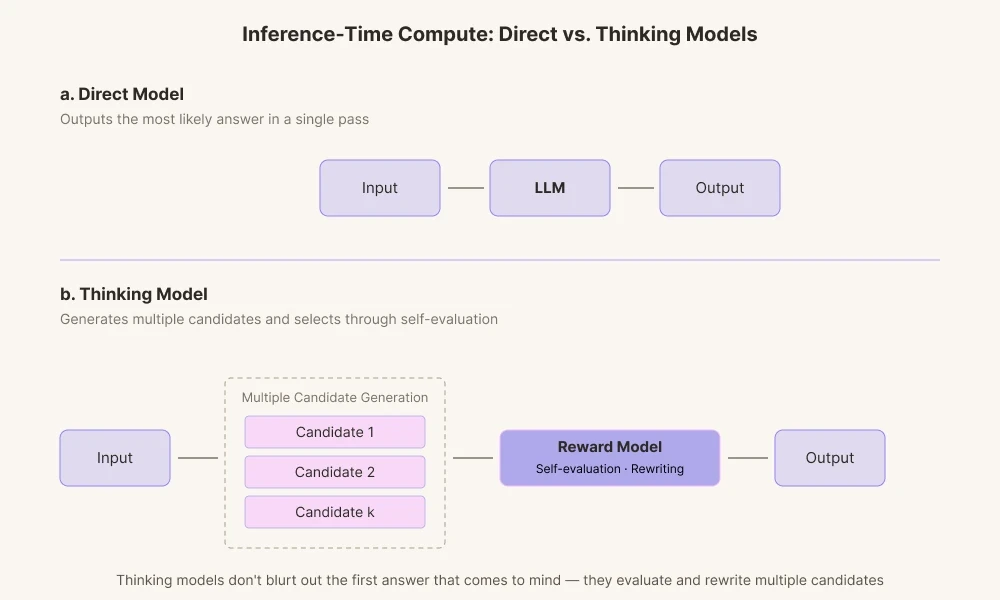

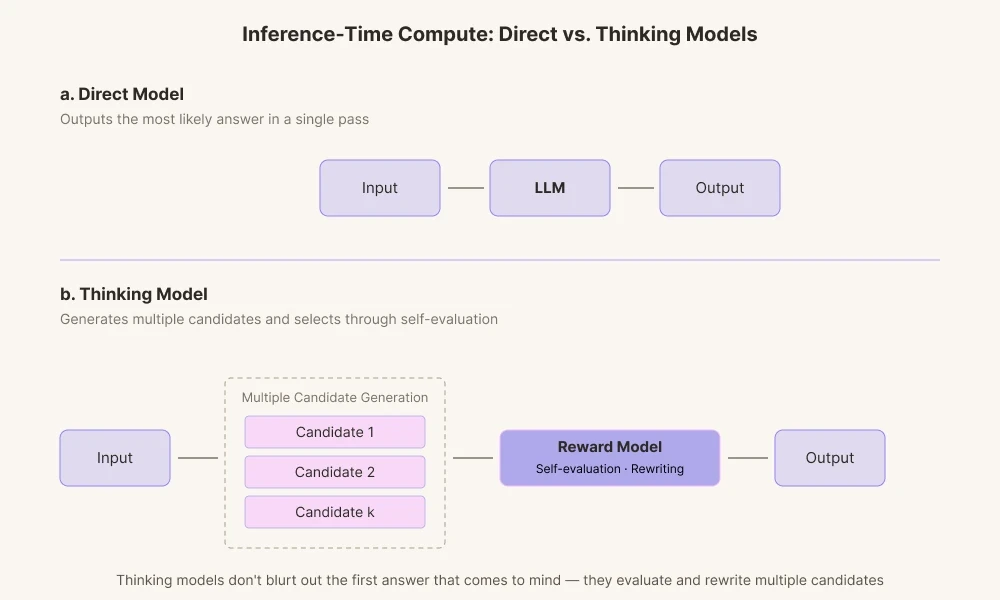

Alasan model AI masa kini mencapai hasil yang begitu mencolok adalah karena bidang ini telah memajukan teknologi yang berfokus pada 'Inference-Time Compute'. Ini adalah teknologi memberi AI lebih banyak waktu komputasi sebelum ia menjawab. Model AI masa lalu hanya mengeluarkan jawaban pertama yang dihitung, dengan kata lain jawaban yang pertama terlintas di benak. Sebaliknya, model pemikir masa kini menghasilkan beberapa jalur penalaran.

Mereka menghasilkan berbagai jawaban kandidat dan menilainya melalui model reward intrinsik mereka. Proses ini memeriksa apakah kata-kata itu cocok dengan konteks dan apakah terdengar terlalu definitif bagi model, lalu membuangnya secara internal jika perlu.

Ini mirip dengan bagaimana manusia menyunting ulang kalimat di dalam pikiran sebelum berbicara. Alih-alih menuntut AI memberikan jawaban seakurat mungkin berdasarkan distribusi probabilitas, sumber daya komputasi dihabiskan untuk memberinya waktu merevisi. Kita membiarkannya mengembara keluar dari pusat massa probabilitas menuju tepi-tepinya: semacam kegelisahan mekanis.

Kegelisahan dalam Penerjemahan Video

Penerjemahan biasa selesai begitu maknanya pas, tetapi penerjemahan video membutuhkan bukan hanya makna yang akurat, melainkan juga panjang dan waktu gerakan bibir harus sesuai.

Jika seorang aktor di layar menggerakkan mulutnya selama 1,8 detik dan mengucapkan 11 suku kata bahasa Inggris, penerjemah harus menyusun baris bahasa Korea yang muat di dalam 1,8 detik itu. Pertahankan makna, dan panjangnya jadi terpotong. Sesuaikan panjangnya, dan maknanya menjadi kabur. Ketika konsonan penutup dan vokal terbuka berbeda dari aslinya, penonton merasa ada yang janggal begitu melihatnya. Teks subtitle membawa batasan lain: 12 hingga 15 karakter per detik kecepatan baca. Jadi, penerjemah yang bekerja dengan dubbing menyusun lima baris dengan makna setara, menghitung suku kata, menyamakan penekanan, dan memilih bukan terjemahan yang paling akurat, melainkan yang paling sedikit kehilangan makna di bawah batasan yang ada.

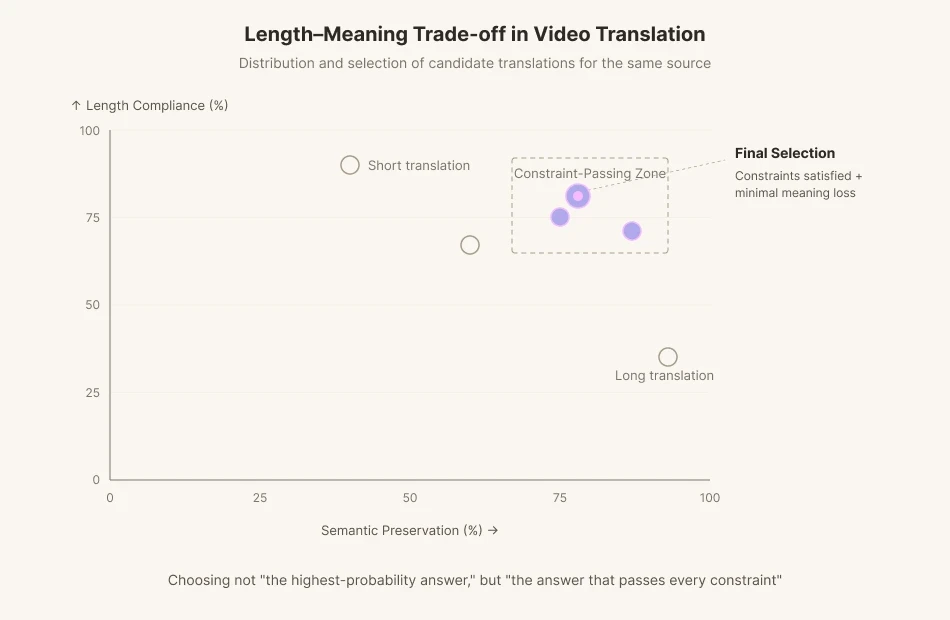

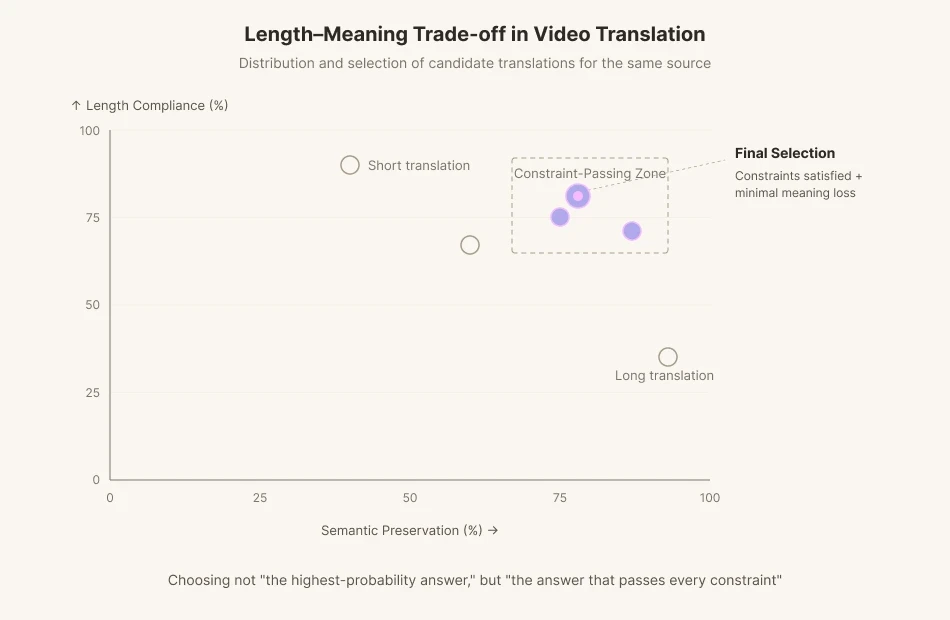

Tim penerjemahan Perso AI telah mengerjakan tepat masalah ini. Tim tersebut memublikasikan sebuah makalah di EMNLP (https://aclanthology.org/2025.emnlp-demos.37) yang mengukur trade-off antara Isochrony (kepatuhan panjang) dan Semantic Alignment dalam penerjemahan video.

EMNLP (Empirical Methods in Natural Language Processing) adalah ajang tingkat atas dalam pemrosesan bahasa alami. Sesuai namanya, ajang ini menghargai penelitian empiris yang membuktikan efektivitas teknologi di dunia nyata melalui data dan eksperimen, bukan semata hipotesis teoretis. Sejalan dengan karakter itu, makalah tim riset ESTsoft mengambil masalah yang sulit dalam penerjemahan video, mengukurnya dengan data, dan menyelesaikannya dengan algoritma. Sebuah kontribusi praktis di dunia nyata.

Pertanyaan kunci yang diperhitungkan oleh alur dubbing Perso AI ada di sini. Bukan karakter, bukan suku kata, melainkan fonem, yaitu unit ujaran terkecil. Karakter dan suku kata adalah unit di layar; fonem berkaitan dengan waktu yang benar-benar dihabiskan di dalam mulut. Algoritma yang diusulkan dalam makalah ini, CountPhonemes, menghitung jumlah fonem dari kalimat terjemahan, membandingkannya dengan jumlah fonem target, dan merevisi kalimat agar keduanya selaras.

Model penerjemahan mesin yang ada dioptimalkan untuk metrik pelestarian makna seperti BLEU dan COMET. Mereka dilatih untuk menghasilkan terjemahan yang paling masuk akal, secepat mungkin. Tetapi penerjemahan video kadang harus menolak yang paling masuk akal itu. Ketika jumlah fonem tidak cukup, Anda harus mengorbankan sebagian makna dan menemukan ungkapan lain. Kita meminta AI bukan "jawaban dengan probabilitas tertinggi", melainkan "jawaban yang lolos setiap batasan."

Inilah tepatnya yang diselesaikan oleh alur dubbing Perso AI. Pada tahap penerjemahan, sistem menghasilkan banyak kandidat yang memenuhi batasan panjang dan fonem, lalu memilih yang kehilangan makna paling sedikit. Ini adalah gagasan inference-time compute dari bagian sebelumnya, yang dipindahkan ke ranah dubbing. Hentikan model agar tidak langsung meluapkan jawaban pertama yang terlintas di benaknya. Buat ia menulis ulang. Buat ia memverifikasi. Penerjemahan iteratif ini adalah keraguan yang disengaja yang dibebankan pada mesin. Di dalam loop umpan balik iteratif, model mengejar titik optimum antara kepatuhan panjang (Isochrony) dan keselarasan makna (Semantic Alignment). Inilah pekerjaan memindahkan penderitaan penerjemah video ke dalam model itu sendiri.

Penutup

Keraguan bukanlah sekadar ketidaksempurnaan, bukan pula sekadar perlambatan. Ia adalah penumpukan waktu yang dihabiskan untuk mempertimbangkan orang lain. Jika AI suatu saat belajar berhenti sejenak demi pertimbangan, itu bukan karena modelnya menjadi lebih pintar. Melainkan karena kita merancangnya agar kurang yakin, agar berlama-lama, agar bimbang.

Cara Mengajarkan AI untuk Bimbang

Beberapa hari lalu, saya menemukan sebuah klip YouTube. Pembawa berita Sohn Suk-hee sedang mewawancarai novelis Kim Ae-ran. Pertanyaannya adalah "Apa yang dimiliki manusia yang tidak dimiliki AI?", dan jawabannya adalah "Keraguan."

Sang novelis menyinggung satu momen dari salah satu siaran lama pembawa berita itu. Saat membacakan berita wafatnya mendiang Roh Hoe-chan, seorang aktivis buruh yang kemudian menjadi politisi, ia kehilangan kata-kata selama dua puluh detik. Momen menahan kata-kata, bimbang, dan memilah—itulah keraguan. AI tidak mampu melakukan ini. Namun, keraguan manusia menjadi penghiburan dan kesopanan.

Itu terjadi sekitar dua puluh tahun lalu, saat saya sedang fokus mengembangkan sebuah game tembak-menembak. Seorang rekan tim dalam pemodelan karakter 3D menyerahkan sebuah buku kepada saya sambil berkata, "Teman SMA saya seorang novelis; kamu harus membaca ini." Pengamatan yang mendalam diselimuti kecerdikan. Saya langsung tenggelam di dalamnya. Buku itu adalah kumpulan cerita pendek Kim Ae-ran Run, Daddy, Run (달려라 아비). Saya telah menjadi penggemarnya sejak saat itu.

Keraguan Membutuhkan Waktu dan Ketidakpastian yang Lebih Rendah

Kim Ae-ran mengatakan otot menulisnya menguat melalui ketelitian yang menyakitkan dan pertanyaan pada diri sendiri di setiap baris. Ia mengatakan waktu yang dihabiskan di antara kalimat-kalimat menjadi bentuk pertimbangan bagi orang lain. Ia juga mengemukakan bahwa nilai sejati sastra tidak terletak pada isinya, melainkan pada bentuknya. Lalu, jika bentuk juga penting, mungkin AI bisa menirunya setidaknya secara kasar?

Dari sudut pandang fisika, waktu adalah perubahan dalam keadaan fisik. Dalam fisika, waktu belum berlalu jika keadaannya belum berubah. Jadi, semakin sedikit perubahan keadaan berarti waktu yang lebih lambat, dan semakin banyak perubahan berarti waktu yang lebih panjang. Satu detik yang singkat bagi manusia adalah, bagi AI, keabadian yang terbentang di ratusan miliar, bahkan triliunan, operasi floating-point (FLOPs). Dibandingkan perangkat lunak lama, jawaban AI belakangan ini adalah produk dari kerja keras yang panjang dan menyiksa. Ini juga alasan mengapa industri AI bisa bertumbuh dalam pendapatan sambil berjuang dalam laba. Dari sudut pandang perangkat lunak warisan, AI terlalu lambat bagi mesin. Bahkan sesuatu yang sesederhana validasi format JSON, ketika dijalankan melalui inferensi model bahasa besar, menghabiskan ratusan juta komputasi dibandingkan dengan perangkat lunak warisan.

Model bahasa besar (LLM), mesin di balik kemajuan AI belakangan ini, adalah program yang memprediksi kata berikutnya dalam sebuah kalimat. AI mengalirkan arus listrik untuk menemukan kata berikutnya. Ia berulang kali mengalikan dan menjumlahkan matriks-matriks raksasa. Komputasi AI memerlukan konsumsi fisik dari perangkat keras. Untuk memberi AI setidaknya suatu bentuk keraguan, waktu penderitaan manusia, Anda harus melewatinya melalui komputasi yang intens. Ratusan miliar operasi untuk menghasilkan satu kata berikutnya. Ratusan miliar operasi lagi menyusul untuk menghasilkan kata setelahnya.

Sebagian besar komputasi pembelajaran mendalam kontemporer melibatkan penjumlahan berbobot, dan nilai yang telah dihitung sebelumnya yang digunakan dalam penjumlahan ini dikenal sebagai parameter.

Ketika kita berbicara tentang model "Qwen 3.6 27B", artinya ada 27 miliar parameter yang siap untuk penjumlahan berbobot, sehingga membutuhkan sekitar 27 miliar perkalian hanya untuk memprediksi satu token berikutnya. Dan itu baru awalnya. Selain itu, satu perkalian bilangan bulat melibatkan puluhan operasi logis dan bilangan floating-point memerlukan ribuan. Dengan kerumitan seperti itu, orang bisa menyebutnya benar-benar membingungkan.

Menurunkan Temperatur Menajamkan Bias

Mari kita lihat lebih dalam cara kerja LLM. Sudah menjadi pengetahuan umum bahwa deep learning, fondasi LLM, adalah mesin pencocokan pola yang menerapkan pola yang dihafal selama pelatihan ke penggunaan dunia nyata. Dua hal mengatur proses mengulang kembali itu: sampling token dan temperatur.

Untuk memprediksi satu kata berikutnya, model memberikan skor (logit) pada setiap dari puluhan ribu kata kandidat. Skor-skor itu kemudian diubah menjadi probabilitas, dan sebuah kata dipilih secara proporsional terhadap tiap probabilitas. Proses ini disebut sampling.

Untuk menambah variasi pada sampling, diperkenalkan parameter matematis yang disebut "temperatur". Turunkan temperatur, dan jarak antara skor kandidat terbentang sampai ke ekstrem. Kata-kata dengan probabilitas tinggi dipilih lebih sering daripada kata-kata pada garis dasar. Kata-kata dengan probabilitas rendah dipilih lebih jarang lagi. Ini mirip dengan bagaimana yang kaya makin kaya dan yang miskin makin miskin. Sebaliknya, jaraknya menyempit ketika temperatur naik. Kesenjangan menjadi rata, lalu seimbang. Kata-kata berprobabilitas rendah yang biasanya akan dilewatkan, bisa dipilih dengan tingkat yang lebih tinggi ketika temperatur naik.

Bahasa manusia mirip dengan ini. Kelompok dan budaya tempat saya berada tercermin dalam distribusi probabilitas bahasa saya. Bahasa yang lebih dingin dan tajam menghasilkan ujaran yang lebih rasional, lebih dioptimalkan, dan lebih selaras dengan mayoritas. Bahasa yang lebih hangat dan membulat kurang rasional dan kurang optimal, tetapi mempertimbangkan minoritas.

Pertimbangan adalah tindakan menghabiskan energi ekstra untuk keluar dari distribusi probabilitas pikiran sendiri. Ini berarti memperhatikan apa yang ditutupi oleh mayoritas, dan menemukan kalimat yang biasanya tidak digunakan. Apa yang digambarkan penulis sebagai proses menulis yang menyakitkan, bagi AI, seharusnya menjadi tindakan menolak respons yang hanya didasarkan pada pelatihan yang bias, dan berusaha menempuh jalan melampauinya.

Kegelisahan Mekanis

Bagaimana kita bisa mengajarkan AI untuk bersikap penuh pertimbangan? Anda tidak bisa membiarkannya langsung memuntahkan kata dengan probabilitas tertinggi. Itu hanya mengekspor bias yang melekat pada data pelatihan.

Alasan model AI masa kini mencapai hasil yang begitu mencolok adalah karena bidang ini telah memajukan teknologi yang berfokus pada 'Inference-Time Compute'. Ini adalah teknologi memberi AI lebih banyak waktu komputasi sebelum ia menjawab. Model AI masa lalu hanya mengeluarkan jawaban pertama yang dihitung, dengan kata lain jawaban yang pertama terlintas di benak. Sebaliknya, model pemikir masa kini menghasilkan beberapa jalur penalaran.

Mereka menghasilkan berbagai jawaban kandidat dan menilainya melalui model reward intrinsik mereka. Proses ini memeriksa apakah kata-kata itu cocok dengan konteks dan apakah terdengar terlalu definitif bagi model, lalu membuangnya secara internal jika perlu.

Ini mirip dengan bagaimana manusia menyunting ulang kalimat di dalam pikiran sebelum berbicara. Alih-alih menuntut AI memberikan jawaban seakurat mungkin berdasarkan distribusi probabilitas, sumber daya komputasi dihabiskan untuk memberinya waktu merevisi. Kita membiarkannya mengembara keluar dari pusat massa probabilitas menuju tepi-tepinya: semacam kegelisahan mekanis.

Kegelisahan dalam Penerjemahan Video

Penerjemahan biasa selesai begitu maknanya pas, tetapi penerjemahan video membutuhkan bukan hanya makna yang akurat, melainkan juga panjang dan waktu gerakan bibir harus sesuai.

Jika seorang aktor di layar menggerakkan mulutnya selama 1,8 detik dan mengucapkan 11 suku kata bahasa Inggris, penerjemah harus menyusun baris bahasa Korea yang muat di dalam 1,8 detik itu. Pertahankan makna, dan panjangnya jadi terpotong. Sesuaikan panjangnya, dan maknanya menjadi kabur. Ketika konsonan penutup dan vokal terbuka berbeda dari aslinya, penonton merasa ada yang janggal begitu melihatnya. Teks subtitle membawa batasan lain: 12 hingga 15 karakter per detik kecepatan baca. Jadi, penerjemah yang bekerja dengan dubbing menyusun lima baris dengan makna setara, menghitung suku kata, menyamakan penekanan, dan memilih bukan terjemahan yang paling akurat, melainkan yang paling sedikit kehilangan makna di bawah batasan yang ada.

Tim penerjemahan Perso AI telah mengerjakan tepat masalah ini. Tim tersebut memublikasikan sebuah makalah di EMNLP (https://aclanthology.org/2025.emnlp-demos.37) yang mengukur trade-off antara Isochrony (kepatuhan panjang) dan Semantic Alignment dalam penerjemahan video.

EMNLP (Empirical Methods in Natural Language Processing) adalah ajang tingkat atas dalam pemrosesan bahasa alami. Sesuai namanya, ajang ini menghargai penelitian empiris yang membuktikan efektivitas teknologi di dunia nyata melalui data dan eksperimen, bukan semata hipotesis teoretis. Sejalan dengan karakter itu, makalah tim riset ESTsoft mengambil masalah yang sulit dalam penerjemahan video, mengukurnya dengan data, dan menyelesaikannya dengan algoritma. Sebuah kontribusi praktis di dunia nyata.

Pertanyaan kunci yang diperhitungkan oleh alur dubbing Perso AI ada di sini. Bukan karakter, bukan suku kata, melainkan fonem, yaitu unit ujaran terkecil. Karakter dan suku kata adalah unit di layar; fonem berkaitan dengan waktu yang benar-benar dihabiskan di dalam mulut. Algoritma yang diusulkan dalam makalah ini, CountPhonemes, menghitung jumlah fonem dari kalimat terjemahan, membandingkannya dengan jumlah fonem target, dan merevisi kalimat agar keduanya selaras.

Model penerjemahan mesin yang ada dioptimalkan untuk metrik pelestarian makna seperti BLEU dan COMET. Mereka dilatih untuk menghasilkan terjemahan yang paling masuk akal, secepat mungkin. Tetapi penerjemahan video kadang harus menolak yang paling masuk akal itu. Ketika jumlah fonem tidak cukup, Anda harus mengorbankan sebagian makna dan menemukan ungkapan lain. Kita meminta AI bukan "jawaban dengan probabilitas tertinggi", melainkan "jawaban yang lolos setiap batasan."

Inilah tepatnya yang diselesaikan oleh alur dubbing Perso AI. Pada tahap penerjemahan, sistem menghasilkan banyak kandidat yang memenuhi batasan panjang dan fonem, lalu memilih yang kehilangan makna paling sedikit. Ini adalah gagasan inference-time compute dari bagian sebelumnya, yang dipindahkan ke ranah dubbing. Hentikan model agar tidak langsung meluapkan jawaban pertama yang terlintas di benaknya. Buat ia menulis ulang. Buat ia memverifikasi. Penerjemahan iteratif ini adalah keraguan yang disengaja yang dibebankan pada mesin. Di dalam loop umpan balik iteratif, model mengejar titik optimum antara kepatuhan panjang (Isochrony) dan keselarasan makna (Semantic Alignment). Inilah pekerjaan memindahkan penderitaan penerjemah video ke dalam model itu sendiri.

Penutup

Keraguan bukanlah sekadar ketidaksempurnaan, bukan pula sekadar perlambatan. Ia adalah penumpukan waktu yang dihabiskan untuk mempertimbangkan orang lain. Jika AI suatu saat belajar berhenti sejenak demi pertimbangan, itu bukan karena modelnya menjadi lebih pintar. Melainkan karena kita merancangnya agar kurang yakin, agar berlama-lama, agar bimbang.

Lanjutkan Membaca

Jelajahi Semua

PRODUK

KASUS PENGGUNAAN

SUMBER DAYA

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618

PRODUK

KASUS PENGGUNAAN

SUMBER DAYA

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618

PRODUK

KASUS PENGGUNAAN

SUMBER DAYA

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618