จะสอนให้ AI ลังเลอย่างไร: การประมวลผลในช่วงอนุมานและศิลปะแห่งการแปลอย่างรอบคอบ

เครื่องมือแปลวิดีโอ AI การทำให้เข้าท้องถิ่น และการพากย์เสียง

ลองใช้งานฟรี

จะสอน AI ให้ลังเลได้อย่างไร

ไม่กี่วันก่อน ฉันบังเอิญเจอคลิปบน YouTube ผู้ประกาศข่าวซน ซอก-ฮี กำลังสัมภาษณ์นักเขียนนวนิยาย คิม แอ-รัน คำถามคือ "มนุษย์มีอะไรที่ AI ไม่มี?" และคำตอบของเธอคือ "ความลังเล"

นักเขียนนวนิยายได้หยิบยกช่วงเวลาหนึ่งจากรายการข่าวเก่า ๆ ของผู้ประกาศข่าวมาเล่า ขณะรายงานข่าวการเสียชีวิตของโน โฮ-ชัน ผู้เคลื่อนไหวแรงงานที่ผันตัวเป็นนักการเมือง เขาพูดไม่ออกไปยี่สิบวินาที ช่วงเวลาแห่งการยั้งถ้อยคำ การสั่นไหว และการใคร่ครวญ—ความลังเล AI ไม่มีสิ่งนี้ แต่ความลังเลของมนุษย์กลับกลายเป็นการปลอบประโลมและความสุภาพ

เมื่อประมาณยี่สิบปีก่อน ตอนที่ฉันกำลังทุ่มเทกับการพัฒนาเกมยิง ทีมเมทคนหนึ่งที่ทำโมเดลตัวละคร 3D ยื่นหนังสือให้ฉันเล่มหนึ่งพร้อมบอกว่า "เพื่อนสมัยมัธยมปลายของฉันเป็นนักเขียนนวนิยาย เธอน่าจะอ่านเล่มนี้" การสังเกตอย่างลึกซึ้งที่แฝงอารมณ์ขัน ฉันอ่านจนไม่อาจละสายตาได้เลย หนังสือเล่มนั้นคือรวมเรื่องสั้นของคิม แอ-รัน Run, Daddy, Run (달려라 아비) ตั้งแต่นั้นมาฉันก็เป็นแฟนของเธอเรื่อยมา

การลังเลต้องใช้เวลาและความแน่นอนที่ต่ำลง

คิม แอ-รัน กล่าวว่า กล้ามเนื้อการเขียนของเธอแข็งแรงขึ้นผ่านการเอาใจใส่อย่างพิถีพิถันและการตั้งคำถามกับตัวเองในทุกบรรทัด เธอบอกว่าเวลาที่ใช้ไประหว่างประโยคกลายเป็นการคำนึงถึงผู้อื่น เธอยังเสนอว่าคุณค่าที่แท้จริงของวรรณกรรมไม่ได้อยู่ที่เนื้อหา แต่อยู่ที่รูปแบบของมัน แล้วถ้ารูปแบบก็สำคัญด้วย บางที AI อาจเลียนแบบมันได้อย่างคร่าว ๆ?

จากมุมมองของฟิสิกส์ เวลา คือการเปลี่ยนแปลงของสถานะทางกายภาพ ในฟิสิกส์ หากสถานะไม่เปลี่ยน เวลาก็ยังไม่ผ่านไป ดังนั้น การเปลี่ยนแปลงสถานะที่น้อยลงจึงเท่ากับเวลาที่ช้าลง และการเปลี่ยนแปลงที่มากขึ้นก็คือเวลาที่ยาวนานขึ้น สำหรับมนุษย์หนึ่งวินาทีที่ผ่านไปอย่างฉับพลัน คือชั่วนิรันดร์ที่ถูกยืดออกไปผ่านการคำนวณทศนิยมลอยตัว (FLOPs) หลายร้อยพันล้าน แม้กระทั่งหลายล้านล้าน เมื่อเทียบกับซอฟต์แวร์แบบเก่า คำตอบของ AI ยุคหลังเป็นผลผลิตของงานหนักที่ยืดเยื้อและทรมาน นี่เองเป็นเหตุผลที่อุตสาหกรรม AI สามารถเติบโตด้านรายได้ แต่ยังดิ้นรนเรื่องกำไร จากมุมมองของซอฟต์แวร์ดั้งเดิม AI ช้าจนเกินไปสำหรับเครื่องจักร แม้แต่เรื่องง่าย ๆ อย่างการตรวจสอบรูปแบบ JSON เมื่อรันผ่านการอนุมานของโมเดลภาษาขนาดใหญ่ ก็มีต้นทุนการคำนวณเป็นร้อยล้าน เทียบกับซอฟต์แวร์ดั้งเดิม

โมเดลภาษาขนาดใหญ่ (LLMs) ซึ่งเป็นเครื่องยนต์ของความก้าวหน้าล่าสุดของ AI เป็นโปรแกรมที่ทำนายคำถัดไปในประโยค AI ส่งกระแสไฟฟ้าเพื่อหาคำถัดไป มันคูณและบวกเมทริกซ์ขนาดมหึมาอย่างซ้ำแล้วซ้ำเล่า การคำนวณของ AI ต้องอาศัยการใช้ทรัพยากรฮาร์ดแวร์ทางกายภาพ หากจะทำให้ AI มีรูปแบบของความลังเลเหมือนเวลาที่มนุษย์ต้องใช้ในการครุ่นคิด คุณต้องบังคับมันให้ผ่านการคำนวณอย่างเข้มข้น การทำงานหลายร้อยพันล้านครั้งเพื่อสร้างเพียงคำถัดไปหนึ่งคำ จากนั้นการทำงานอีกหลายร้อยพันล้านครั้งก็จะตามมาเพื่อสร้างคำถัดไปหลังจากนั้น

การคำนวณของดีปเลิร์นนิงร่วมสมัยส่วนใหญ่อาศัยการหาผลรวมแบบถ่วงน้ำหนัก และค่าที่คำนวณไว้ล่วงหน้าซึ่งใช้ในผลรวมเหล่านี้เรียกว่า พารามิเตอร์

เมื่อเราพูดถึงโมเดล 'Qwen 3.6 27B' หมายความว่ามีพารามิเตอร์ 27 พันล้านตัวพร้อมสำหรับการหาผลรวมถ่วงน้ำหนัก ซึ่งต้องใช้การคูณประมาณ 27 พันล้านครั้งเพื่อทำนายเพียงโทเคนถัดไปหนึ่งตัว และนั่นเป็นเพียงจุดเริ่มต้นเท่านั้น ยิ่งไปกว่านั้น การคูณจำนวนเต็มหนึ่งครั้งยังต้องอาศัยการดำเนินการเชิงตรรกะหลายสิบขั้น และแบบทศนิยมลอยตัวต้องใช้ถึงหลายพันขั้น เมื่อมองจากความซับซ้อนเช่นนี้ ใคร ๆ ก็อาจเรียกมันว่าเกินกว่าจะเชื่อได้

ยิ่งลดอุณหภูมิ อคติยิ่งคมชัด

ลองมาดูให้ลึกขึ้นว่า LLMs ทำงานอย่างไร เรื่องหนึ่งที่กลายเป็นความรู้ทั่วไปคือ ดีปเลิร์นนิงซึ่งเป็นรากฐานของ LLMs เป็นเครื่องจักรจับรูปแบบที่นำรูปแบบที่จดจำได้ระหว่างการฝึก ไปใช้กับการใช้งานจริง ปัจจัยสองอย่างที่กำกับกระบวนการท่องจำซ้ำนี้คือ การสุ่มเลือกโทเคนและอุณหภูมิ

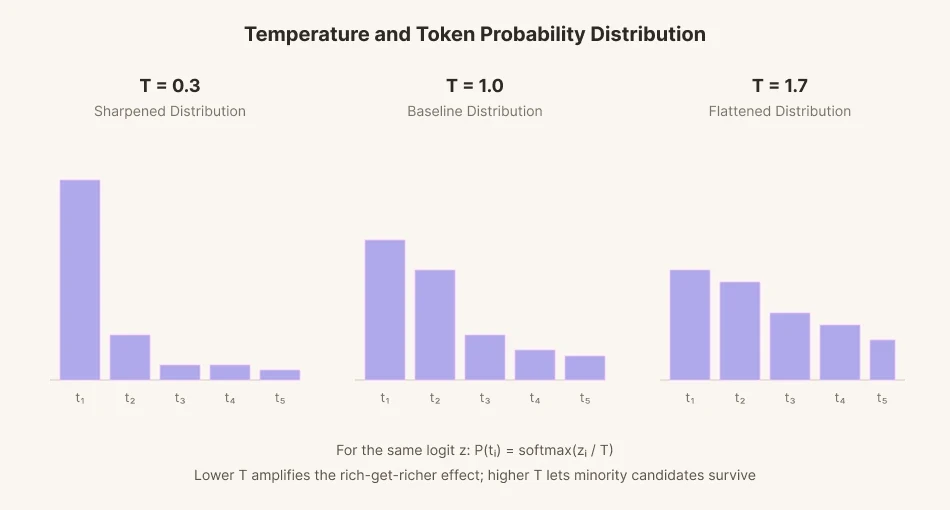

เพื่อทำนายคำถัดไปหนึ่งคำ โมเดลจะกำหนดคะแนน (logit) ให้กับคำผู้สมัครนับหมื่นคำ จากนั้นคะแนนเหล่านั้นจะถูกแปลงเป็นความน่าจะเป็น และเลือกคำตามสัดส่วนของความน่าจะเป็นแต่ละค่า กระบวนการนี้เรียกว่า sampling

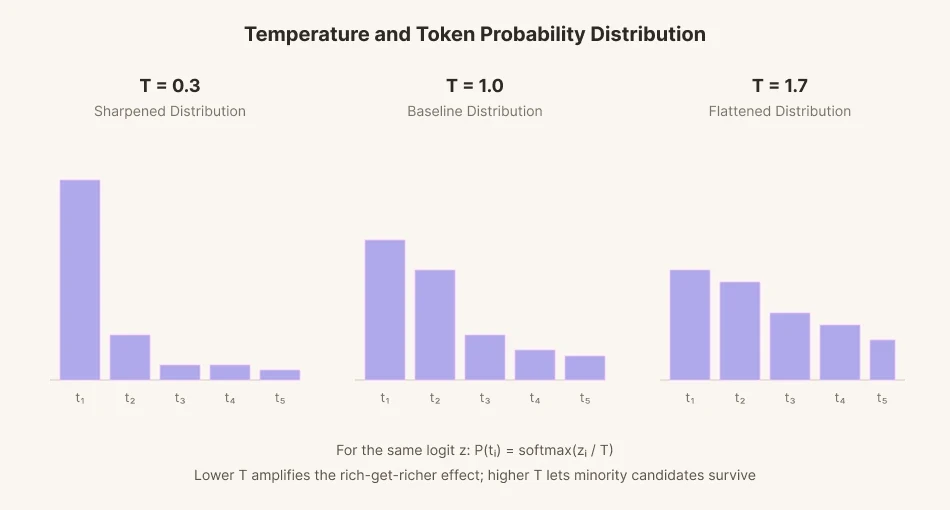

เพื่อเพิ่มความหลากหลายให้กับ sampling จึงมีการนำพารามิเตอร์ทางคณิตศาสตร์ที่เรียกว่า 'temperature' มาใช้ ยิ่งลดอุณหภูมิ ความแตกต่างระหว่างคะแนนของคำผู้สมัครก็ยิ่งแผ่กว้างไปสู่ขั้วสุดโต่ง คำที่มีความน่าจะเป็นสูงจะถูกเลือกบ่อยกว่าคำที่อยู่ในระดับพื้นฐาน คำที่มีความน่าจะเป็นต่ำจะยิ่งถูกเลือกน้อยลงไปอีก คล้ายกับคนรวยยิ่งรวย คนจนยิ่งจน ตรงกันข้าม เมื่ออุณหภูมิสูงขึ้น ช่องว่างนั้นจะหดแคบลงและแบนราบลง คำที่มีความน่าจะเป็นต่ำซึ่งปกติจะถูกมองข้าม ก็สามารถถูกเลือกได้มากขึ้นเมื่ออุณหภูมิสูงขึ้น

ภาษามนุษย์ก็คล้ายกับสิ่งนี้ กลุ่มและวัฒนธรรมที่ฉันสังกัดสะท้อนอยู่ในการแจกแจงความน่าจะเป็นของภาษา คำพูดที่เย็นกว่าและคมกว่า ทำให้ถ้อยคำดูมีเหตุผลมากขึ้น ถูกปรับให้เหมาะสมมากขึ้น และสอดคล้องกับคนส่วนใหญ่มากขึ้น ภาษาที่อุ่นกว่าและกลมกว่า มีเหตุผลน้อยกว่าและปรับให้เหมาะสมน้อยกว่า แต่ก็เอื้อมาถึงคนส่วนน้อยด้วย

การคำนึงถึงผู้อื่น คือการยอมใช้พลังงานเพิ่มขึ้นเพื่อก้าวออกจากการแจกแจงความน่าจะเป็นของความคิดของตนเอง มันหมายถึงการสังเกตสิ่งที่คนส่วนใหญ่บดบัง และค้นหาประโยคที่ปกติไม่ค่อยใช้ สิ่งที่นักเขียนอธิบายว่าเป็นกระบวนการเขียนอันพิถีพิถัน สำหรับ AI แล้ว ควรกลายเป็นการปฏิเสธคำตอบที่อิงจากอคติของการฝึกเพียงอย่างเดียว และทุ่มแรงเพื่อเดินทางออกไปไกลกว่านั้น

ความกังวลเชิงกลไก

เราจะสอน AI ให้คำนึงถึงผู้อื่นได้อย่างไร? คุณไม่สามารถปล่อยให้มันคายคำที่มีความน่าจะเป็นสูงสุดออกมาได้ทันที เพราะนั่นก็แค่ส่งต่ออคติที่ฝังอยู่ในข้อมูลฝึก

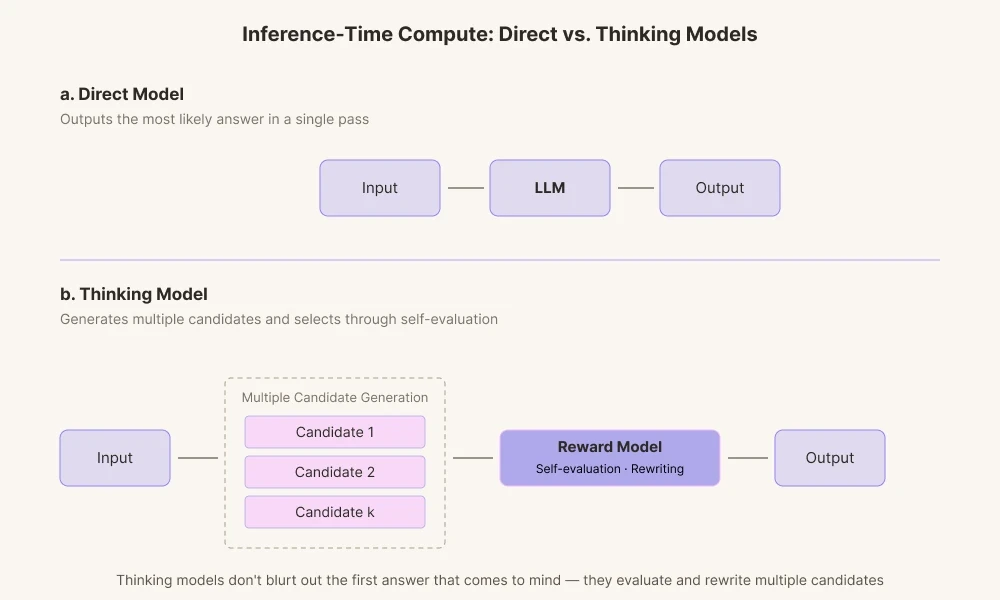

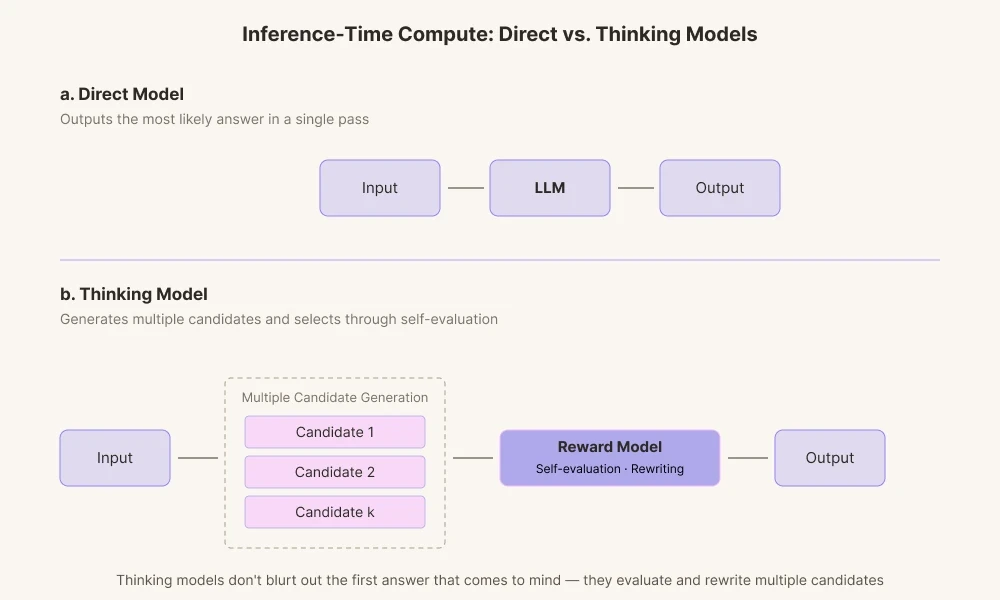

เหตุผลที่โมเดล AI ในปัจจุบันทำผลงานได้โดดเด่นเช่นนี้ เป็นเพราะวงการได้พัฒนาเทคโนโลยีที่มุ่งเน้น 'Inference-Time Compute' มันคือเทคโนโลยีที่ให้ AI มีเวลาคำนวณมากขึ้นก่อนจะตอบกลับ โมเดล AI ในอดีตเพียงแค่ส่งออกคำตอบแรกที่คำนวณได้ กล่าวอีกอย่างคือคำตอบที่ผุดขึ้นมาเป็นอันดับแรก ตรงกันข้าม โมเดลคิดของยุคปัจจุบันสร้างเส้นทางของการให้เหตุผลได้หลายแบบ

มันสร้างคำตอบทางเลือกหลายแบบและให้คะแนนผ่านโมเดลรางวัลภายในของมันเอง จากนั้นก็ไล่ตรวจสอบว่าคำเหล่านั้นเหมาะกับบริบทหรือไม่ และฟังดูเด็ดขาดเกินไปหรือไม่ แล้วค่อยทิ้งมันภายในหากจำเป็น

สิ่งนี้คล้ายกับวิธีที่มนุษย์แก้ประโยคในใจเสียก่อนจะพูด แทนที่จะบังคับให้ AI ส่งคำตอบที่แม่นยำที่สุดเท่าที่เป็นไปได้ตามการแจกแจงความน่าจะเป็น เรากลับใช้ทรัพยากรคำนวณเพื่อให้มันมีเวลาแก้ไข เราปล่อยมันให้หลุดออกจากศูนย์กลางของมวลความน่าจะเป็นไปสู่ขอบ: ความกังวลแบบกลไก

ความกังวลในการแปลวิดีโอ

การแปลทั่วไปเสร็จสิ้นเมื่อความหมายตรงกันแล้ว แต่การแปลวิดีโอต้องไม่เพียงแม่นยำในความหมายเท่านั้น ความยาวและจังหวะของการขยับปากก็ต้องตรงกันด้วย

ถ้านักแสดงบนจอขยับปาก 1.8 วินาทีและพูดพยางค์ภาษาอังกฤษ 11 พยางค์ ผู้แปลต้องสร้างประโยคภาษาเกาหลีที่พอดีกับ 1.8 วินาทีนั้น รักษาความหมายไว้และช่วงความยาวก็ขาด ถ้าจับความยาวได้แต่ความหมายกลับเลือน การที่ตัวสะกดท้ายและสระเปิดต่างจากต้นฉบับ ผู้ชมจะรู้สึกว่ามีอะไรแปลกไปทันทีที่เห็นมัน ซับไตเติลยังเพิ่มข้อจำกัดอีกอย่างคือความเร็วในการอ่าน 12 ถึง 15 ตัวอักษรต่อวินาที ดังนั้นผู้แปลที่ทำงานกับการพากย์จึงต้องวางคำตอบเทียบเท่าไว้ห้าบรรทัด นับพยางค์ จับจังหวะเน้นเสียง และเลือกไม่ใช่คำแปลที่แม่นที่สุด แต่เป็นคำแปลที่สูญเสียน้อยที่สุดภายใต้ข้อจำกัด

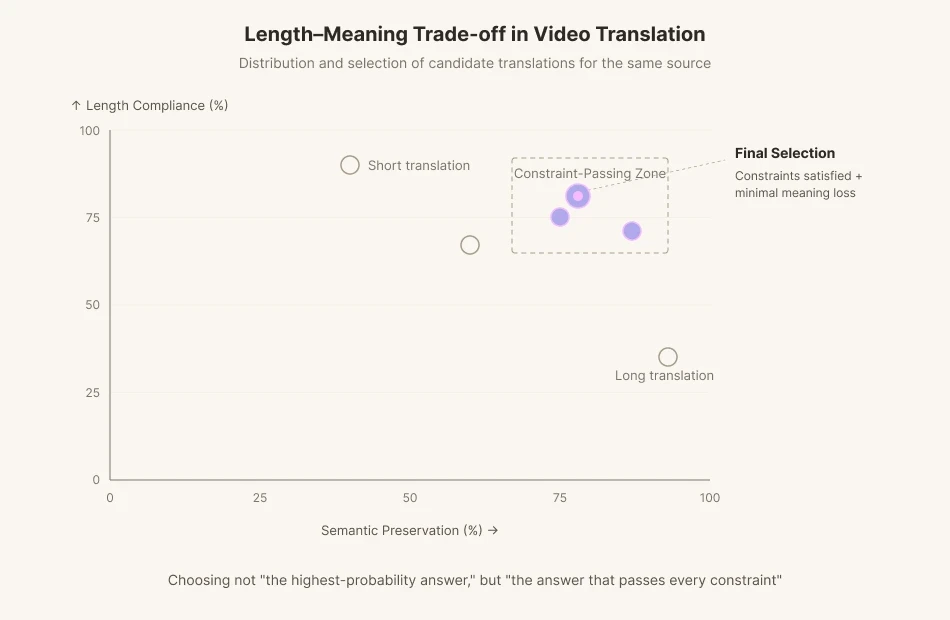

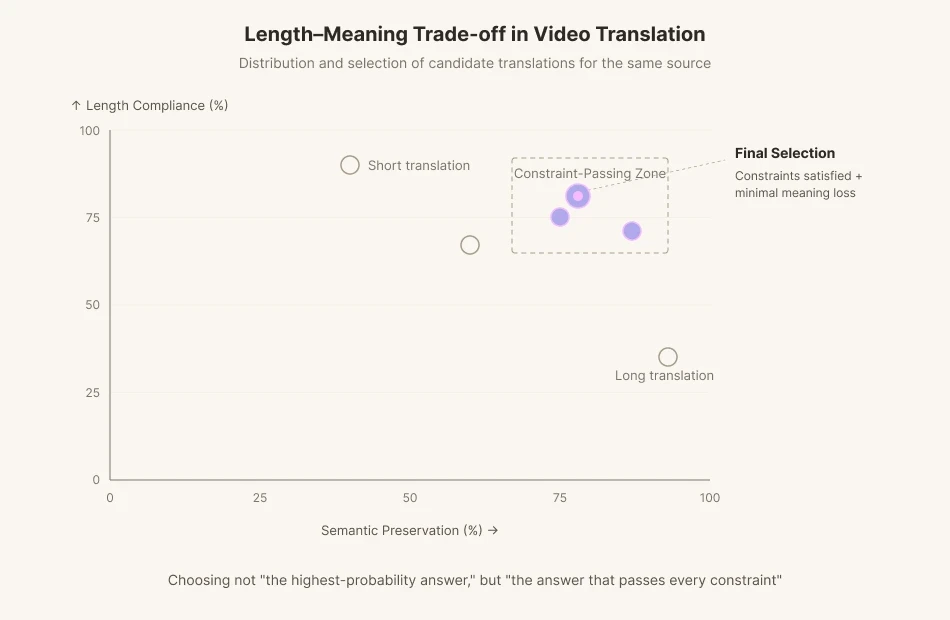

ทีมแปลของ Perso AI กำลังทำงานกับปัญหานี้โดยตรง ทีมได้เผยแพร่บทความใน EMNLP (https://aclanthology.org/2025.emnlp-demos.37) ซึ่งวัดปริมาณการแลกเปลี่ยนระหว่าง Isochrony (การสอดคล้องกับความยาว) และ Semantic Alignment ในการแปลวิดีโอ

EMNLP (Empirical Methods in Natural Language Processing) เป็นเวทีชั้นนำด้านการประมวลผลภาษาธรรมชาติ ตามชื่อของมัน มันให้คุณค่ากับงานวิจัยเชิงประจักษ์ที่พิสูจน์ประสิทธิผลในโลกจริงของเทคโนโลยีผ่านข้อมูลและการทดลอง มากกว่าการตั้งสมมุติฐานเชิงทฤษฎีล้วน ๆ สอดคล้องกับลักษณะนั้น บทความของทีมวิจัย ESTsoft หยิบปัญหายากในการแปลวิดีโอ มาวัดเชิงปริมาณด้วยข้อมูล และแก้ด้วยอัลกอริทึม เป็นผลงานที่ใช้ได้จริงในโลกจริง

คำถามสำคัญที่ไปป์ไลน์พากย์ของ Perso AI คำนึงถึงอยู่ตรงนี้ ไม่ใช่ตัวอักษร ไม่ใช่พยางค์ แต่คือ phoneme ซึ่งเป็นหน่วยเสียงที่เล็กที่สุดของการพูด ตัวอักษรและพยางค์เป็นหน่วยบนหน้าจอ ส่วน phoneme สอดคล้องกับเวลาจริงที่ใช้ในปาก อัลกอริทึมที่เสนอในบทความ CountPhonemes จะนับจำนวน phoneme ของประโยคที่แปล เปรียบเทียบกับจำนวน phoneme เป้าหมาย และปรับแก้ประโยคเพื่อให้ทั้งสองสอดคล้องกัน

โมเดลแปลภาษาด้วยเครื่องที่มีอยู่ถูกปรับให้เหมาะกับตัวชี้วัดการรักษาความหมาย เช่น BLEU และ COMET พวกมันถูกฝึกให้ส่งมอบคำแปลที่มีความเป็นไปได้มากที่สุดโดยเร็วที่สุด แต่การแปลวิดีโอบางครั้งต้องปฏิเสธคำแปลที่ดูน่าเป็นไปได้ที่สุด เมื่อจำนวน phoneme ไม่พอ คุณต้องยอมสละความหมายบางส่วนและหาวิธีเรียบเรียงใหม่ เรากำลังขอให้ AI ไม่ใช่ "คำตอบที่มีความน่าจะเป็นสูงสุด" แต่เป็น "คำตอบที่ผ่านทุกข้อจำกัด"

นี่คือสิ่งที่ไปป์ไลน์พากย์ของ Perso AI แก้ได้พอดี ในขั้นตอนการแปล ระบบจะสร้างผู้สมัครจำนวนมากที่เป็นไปตามข้อจำกัดด้านความยาวและ phoneme จากนั้นเลือกตัวที่สูญเสียความหมาย น้อยที่สุด มันคือแนวคิด inference-time compute จากส่วนก่อนหน้าที่ถูกย้ายมาสู่โดเมนการพากย์ หยุดไม่ให้โมเดลพูดคำตอบแรกที่ผุดขึ้นมาในใจทันที ให้มันเขียนใหม่ ให้มันตรวจสอบ นี่คือ iterative translation ซึ่งเป็นความลังเลอย่างตั้งใจที่ถูกบังคับใส่เข้าไปในเครื่อง ภายใน iterative feedback loop โมเดลไล่หาค่าที่เหมาะที่สุดระหว่างการสอดคล้องกับความยาว (Isochrony) และการสอดคล้องของความหมาย (Semantic Alignment) นี่คืองานของการปลูกถ่ายความคร่ำเคร่งของนักแปลวิดีโอเข้าไปในตัวโมเดลเอง

ปิดท้าย

ความลังเลไม่ใช่แค่ความไม่สมบูรณ์ ไม่ใช่แค่ความช้า แต่มันคือการสะสมของเวลาที่ใช้คำนึงถึงผู้อื่น หากวันหนึ่ง AI เรียนรู้ที่จะหยุดเพื่อคำนึงถึงผู้อื่นได้ มันจะไม่ใช่เพราะโมเดลฉลาดขึ้น แต่เป็นเพราะเราออกแบบให้มันไม่แน่ใจน้อยลง ให้อยู่กับเรื่องนั้นนานขึ้น ให้ลังเล

จะสอน AI ให้ลังเลได้อย่างไร

ไม่กี่วันก่อน ฉันบังเอิญเจอคลิปบน YouTube ผู้ประกาศข่าวซน ซอก-ฮี กำลังสัมภาษณ์นักเขียนนวนิยาย คิม แอ-รัน คำถามคือ "มนุษย์มีอะไรที่ AI ไม่มี?" และคำตอบของเธอคือ "ความลังเล"

นักเขียนนวนิยายได้หยิบยกช่วงเวลาหนึ่งจากรายการข่าวเก่า ๆ ของผู้ประกาศข่าวมาเล่า ขณะรายงานข่าวการเสียชีวิตของโน โฮ-ชัน ผู้เคลื่อนไหวแรงงานที่ผันตัวเป็นนักการเมือง เขาพูดไม่ออกไปยี่สิบวินาที ช่วงเวลาแห่งการยั้งถ้อยคำ การสั่นไหว และการใคร่ครวญ—ความลังเล AI ไม่มีสิ่งนี้ แต่ความลังเลของมนุษย์กลับกลายเป็นการปลอบประโลมและความสุภาพ

เมื่อประมาณยี่สิบปีก่อน ตอนที่ฉันกำลังทุ่มเทกับการพัฒนาเกมยิง ทีมเมทคนหนึ่งที่ทำโมเดลตัวละคร 3D ยื่นหนังสือให้ฉันเล่มหนึ่งพร้อมบอกว่า "เพื่อนสมัยมัธยมปลายของฉันเป็นนักเขียนนวนิยาย เธอน่าจะอ่านเล่มนี้" การสังเกตอย่างลึกซึ้งที่แฝงอารมณ์ขัน ฉันอ่านจนไม่อาจละสายตาได้เลย หนังสือเล่มนั้นคือรวมเรื่องสั้นของคิม แอ-รัน Run, Daddy, Run (달려라 아비) ตั้งแต่นั้นมาฉันก็เป็นแฟนของเธอเรื่อยมา

การลังเลต้องใช้เวลาและความแน่นอนที่ต่ำลง

คิม แอ-รัน กล่าวว่า กล้ามเนื้อการเขียนของเธอแข็งแรงขึ้นผ่านการเอาใจใส่อย่างพิถีพิถันและการตั้งคำถามกับตัวเองในทุกบรรทัด เธอบอกว่าเวลาที่ใช้ไประหว่างประโยคกลายเป็นการคำนึงถึงผู้อื่น เธอยังเสนอว่าคุณค่าที่แท้จริงของวรรณกรรมไม่ได้อยู่ที่เนื้อหา แต่อยู่ที่รูปแบบของมัน แล้วถ้ารูปแบบก็สำคัญด้วย บางที AI อาจเลียนแบบมันได้อย่างคร่าว ๆ?

จากมุมมองของฟิสิกส์ เวลา คือการเปลี่ยนแปลงของสถานะทางกายภาพ ในฟิสิกส์ หากสถานะไม่เปลี่ยน เวลาก็ยังไม่ผ่านไป ดังนั้น การเปลี่ยนแปลงสถานะที่น้อยลงจึงเท่ากับเวลาที่ช้าลง และการเปลี่ยนแปลงที่มากขึ้นก็คือเวลาที่ยาวนานขึ้น สำหรับมนุษย์หนึ่งวินาทีที่ผ่านไปอย่างฉับพลัน คือชั่วนิรันดร์ที่ถูกยืดออกไปผ่านการคำนวณทศนิยมลอยตัว (FLOPs) หลายร้อยพันล้าน แม้กระทั่งหลายล้านล้าน เมื่อเทียบกับซอฟต์แวร์แบบเก่า คำตอบของ AI ยุคหลังเป็นผลผลิตของงานหนักที่ยืดเยื้อและทรมาน นี่เองเป็นเหตุผลที่อุตสาหกรรม AI สามารถเติบโตด้านรายได้ แต่ยังดิ้นรนเรื่องกำไร จากมุมมองของซอฟต์แวร์ดั้งเดิม AI ช้าจนเกินไปสำหรับเครื่องจักร แม้แต่เรื่องง่าย ๆ อย่างการตรวจสอบรูปแบบ JSON เมื่อรันผ่านการอนุมานของโมเดลภาษาขนาดใหญ่ ก็มีต้นทุนการคำนวณเป็นร้อยล้าน เทียบกับซอฟต์แวร์ดั้งเดิม

โมเดลภาษาขนาดใหญ่ (LLMs) ซึ่งเป็นเครื่องยนต์ของความก้าวหน้าล่าสุดของ AI เป็นโปรแกรมที่ทำนายคำถัดไปในประโยค AI ส่งกระแสไฟฟ้าเพื่อหาคำถัดไป มันคูณและบวกเมทริกซ์ขนาดมหึมาอย่างซ้ำแล้วซ้ำเล่า การคำนวณของ AI ต้องอาศัยการใช้ทรัพยากรฮาร์ดแวร์ทางกายภาพ หากจะทำให้ AI มีรูปแบบของความลังเลเหมือนเวลาที่มนุษย์ต้องใช้ในการครุ่นคิด คุณต้องบังคับมันให้ผ่านการคำนวณอย่างเข้มข้น การทำงานหลายร้อยพันล้านครั้งเพื่อสร้างเพียงคำถัดไปหนึ่งคำ จากนั้นการทำงานอีกหลายร้อยพันล้านครั้งก็จะตามมาเพื่อสร้างคำถัดไปหลังจากนั้น

การคำนวณของดีปเลิร์นนิงร่วมสมัยส่วนใหญ่อาศัยการหาผลรวมแบบถ่วงน้ำหนัก และค่าที่คำนวณไว้ล่วงหน้าซึ่งใช้ในผลรวมเหล่านี้เรียกว่า พารามิเตอร์

เมื่อเราพูดถึงโมเดล 'Qwen 3.6 27B' หมายความว่ามีพารามิเตอร์ 27 พันล้านตัวพร้อมสำหรับการหาผลรวมถ่วงน้ำหนัก ซึ่งต้องใช้การคูณประมาณ 27 พันล้านครั้งเพื่อทำนายเพียงโทเคนถัดไปหนึ่งตัว และนั่นเป็นเพียงจุดเริ่มต้นเท่านั้น ยิ่งไปกว่านั้น การคูณจำนวนเต็มหนึ่งครั้งยังต้องอาศัยการดำเนินการเชิงตรรกะหลายสิบขั้น และแบบทศนิยมลอยตัวต้องใช้ถึงหลายพันขั้น เมื่อมองจากความซับซ้อนเช่นนี้ ใคร ๆ ก็อาจเรียกมันว่าเกินกว่าจะเชื่อได้

ยิ่งลดอุณหภูมิ อคติยิ่งคมชัด

ลองมาดูให้ลึกขึ้นว่า LLMs ทำงานอย่างไร เรื่องหนึ่งที่กลายเป็นความรู้ทั่วไปคือ ดีปเลิร์นนิงซึ่งเป็นรากฐานของ LLMs เป็นเครื่องจักรจับรูปแบบที่นำรูปแบบที่จดจำได้ระหว่างการฝึก ไปใช้กับการใช้งานจริง ปัจจัยสองอย่างที่กำกับกระบวนการท่องจำซ้ำนี้คือ การสุ่มเลือกโทเคนและอุณหภูมิ

เพื่อทำนายคำถัดไปหนึ่งคำ โมเดลจะกำหนดคะแนน (logit) ให้กับคำผู้สมัครนับหมื่นคำ จากนั้นคะแนนเหล่านั้นจะถูกแปลงเป็นความน่าจะเป็น และเลือกคำตามสัดส่วนของความน่าจะเป็นแต่ละค่า กระบวนการนี้เรียกว่า sampling

เพื่อเพิ่มความหลากหลายให้กับ sampling จึงมีการนำพารามิเตอร์ทางคณิตศาสตร์ที่เรียกว่า 'temperature' มาใช้ ยิ่งลดอุณหภูมิ ความแตกต่างระหว่างคะแนนของคำผู้สมัครก็ยิ่งแผ่กว้างไปสู่ขั้วสุดโต่ง คำที่มีความน่าจะเป็นสูงจะถูกเลือกบ่อยกว่าคำที่อยู่ในระดับพื้นฐาน คำที่มีความน่าจะเป็นต่ำจะยิ่งถูกเลือกน้อยลงไปอีก คล้ายกับคนรวยยิ่งรวย คนจนยิ่งจน ตรงกันข้าม เมื่ออุณหภูมิสูงขึ้น ช่องว่างนั้นจะหดแคบลงและแบนราบลง คำที่มีความน่าจะเป็นต่ำซึ่งปกติจะถูกมองข้าม ก็สามารถถูกเลือกได้มากขึ้นเมื่ออุณหภูมิสูงขึ้น

ภาษามนุษย์ก็คล้ายกับสิ่งนี้ กลุ่มและวัฒนธรรมที่ฉันสังกัดสะท้อนอยู่ในการแจกแจงความน่าจะเป็นของภาษา คำพูดที่เย็นกว่าและคมกว่า ทำให้ถ้อยคำดูมีเหตุผลมากขึ้น ถูกปรับให้เหมาะสมมากขึ้น และสอดคล้องกับคนส่วนใหญ่มากขึ้น ภาษาที่อุ่นกว่าและกลมกว่า มีเหตุผลน้อยกว่าและปรับให้เหมาะสมน้อยกว่า แต่ก็เอื้อมาถึงคนส่วนน้อยด้วย

การคำนึงถึงผู้อื่น คือการยอมใช้พลังงานเพิ่มขึ้นเพื่อก้าวออกจากการแจกแจงความน่าจะเป็นของความคิดของตนเอง มันหมายถึงการสังเกตสิ่งที่คนส่วนใหญ่บดบัง และค้นหาประโยคที่ปกติไม่ค่อยใช้ สิ่งที่นักเขียนอธิบายว่าเป็นกระบวนการเขียนอันพิถีพิถัน สำหรับ AI แล้ว ควรกลายเป็นการปฏิเสธคำตอบที่อิงจากอคติของการฝึกเพียงอย่างเดียว และทุ่มแรงเพื่อเดินทางออกไปไกลกว่านั้น

ความกังวลเชิงกลไก

เราจะสอน AI ให้คำนึงถึงผู้อื่นได้อย่างไร? คุณไม่สามารถปล่อยให้มันคายคำที่มีความน่าจะเป็นสูงสุดออกมาได้ทันที เพราะนั่นก็แค่ส่งต่ออคติที่ฝังอยู่ในข้อมูลฝึก

เหตุผลที่โมเดล AI ในปัจจุบันทำผลงานได้โดดเด่นเช่นนี้ เป็นเพราะวงการได้พัฒนาเทคโนโลยีที่มุ่งเน้น 'Inference-Time Compute' มันคือเทคโนโลยีที่ให้ AI มีเวลาคำนวณมากขึ้นก่อนจะตอบกลับ โมเดล AI ในอดีตเพียงแค่ส่งออกคำตอบแรกที่คำนวณได้ กล่าวอีกอย่างคือคำตอบที่ผุดขึ้นมาเป็นอันดับแรก ตรงกันข้าม โมเดลคิดของยุคปัจจุบันสร้างเส้นทางของการให้เหตุผลได้หลายแบบ

มันสร้างคำตอบทางเลือกหลายแบบและให้คะแนนผ่านโมเดลรางวัลภายในของมันเอง จากนั้นก็ไล่ตรวจสอบว่าคำเหล่านั้นเหมาะกับบริบทหรือไม่ และฟังดูเด็ดขาดเกินไปหรือไม่ แล้วค่อยทิ้งมันภายในหากจำเป็น

สิ่งนี้คล้ายกับวิธีที่มนุษย์แก้ประโยคในใจเสียก่อนจะพูด แทนที่จะบังคับให้ AI ส่งคำตอบที่แม่นยำที่สุดเท่าที่เป็นไปได้ตามการแจกแจงความน่าจะเป็น เรากลับใช้ทรัพยากรคำนวณเพื่อให้มันมีเวลาแก้ไข เราปล่อยมันให้หลุดออกจากศูนย์กลางของมวลความน่าจะเป็นไปสู่ขอบ: ความกังวลแบบกลไก

ความกังวลในการแปลวิดีโอ

การแปลทั่วไปเสร็จสิ้นเมื่อความหมายตรงกันแล้ว แต่การแปลวิดีโอต้องไม่เพียงแม่นยำในความหมายเท่านั้น ความยาวและจังหวะของการขยับปากก็ต้องตรงกันด้วย

ถ้านักแสดงบนจอขยับปาก 1.8 วินาทีและพูดพยางค์ภาษาอังกฤษ 11 พยางค์ ผู้แปลต้องสร้างประโยคภาษาเกาหลีที่พอดีกับ 1.8 วินาทีนั้น รักษาความหมายไว้และช่วงความยาวก็ขาด ถ้าจับความยาวได้แต่ความหมายกลับเลือน การที่ตัวสะกดท้ายและสระเปิดต่างจากต้นฉบับ ผู้ชมจะรู้สึกว่ามีอะไรแปลกไปทันทีที่เห็นมัน ซับไตเติลยังเพิ่มข้อจำกัดอีกอย่างคือความเร็วในการอ่าน 12 ถึง 15 ตัวอักษรต่อวินาที ดังนั้นผู้แปลที่ทำงานกับการพากย์จึงต้องวางคำตอบเทียบเท่าไว้ห้าบรรทัด นับพยางค์ จับจังหวะเน้นเสียง และเลือกไม่ใช่คำแปลที่แม่นที่สุด แต่เป็นคำแปลที่สูญเสียน้อยที่สุดภายใต้ข้อจำกัด

ทีมแปลของ Perso AI กำลังทำงานกับปัญหานี้โดยตรง ทีมได้เผยแพร่บทความใน EMNLP (https://aclanthology.org/2025.emnlp-demos.37) ซึ่งวัดปริมาณการแลกเปลี่ยนระหว่าง Isochrony (การสอดคล้องกับความยาว) และ Semantic Alignment ในการแปลวิดีโอ

EMNLP (Empirical Methods in Natural Language Processing) เป็นเวทีชั้นนำด้านการประมวลผลภาษาธรรมชาติ ตามชื่อของมัน มันให้คุณค่ากับงานวิจัยเชิงประจักษ์ที่พิสูจน์ประสิทธิผลในโลกจริงของเทคโนโลยีผ่านข้อมูลและการทดลอง มากกว่าการตั้งสมมุติฐานเชิงทฤษฎีล้วน ๆ สอดคล้องกับลักษณะนั้น บทความของทีมวิจัย ESTsoft หยิบปัญหายากในการแปลวิดีโอ มาวัดเชิงปริมาณด้วยข้อมูล และแก้ด้วยอัลกอริทึม เป็นผลงานที่ใช้ได้จริงในโลกจริง

คำถามสำคัญที่ไปป์ไลน์พากย์ของ Perso AI คำนึงถึงอยู่ตรงนี้ ไม่ใช่ตัวอักษร ไม่ใช่พยางค์ แต่คือ phoneme ซึ่งเป็นหน่วยเสียงที่เล็กที่สุดของการพูด ตัวอักษรและพยางค์เป็นหน่วยบนหน้าจอ ส่วน phoneme สอดคล้องกับเวลาจริงที่ใช้ในปาก อัลกอริทึมที่เสนอในบทความ CountPhonemes จะนับจำนวน phoneme ของประโยคที่แปล เปรียบเทียบกับจำนวน phoneme เป้าหมาย และปรับแก้ประโยคเพื่อให้ทั้งสองสอดคล้องกัน

โมเดลแปลภาษาด้วยเครื่องที่มีอยู่ถูกปรับให้เหมาะกับตัวชี้วัดการรักษาความหมาย เช่น BLEU และ COMET พวกมันถูกฝึกให้ส่งมอบคำแปลที่มีความเป็นไปได้มากที่สุดโดยเร็วที่สุด แต่การแปลวิดีโอบางครั้งต้องปฏิเสธคำแปลที่ดูน่าเป็นไปได้ที่สุด เมื่อจำนวน phoneme ไม่พอ คุณต้องยอมสละความหมายบางส่วนและหาวิธีเรียบเรียงใหม่ เรากำลังขอให้ AI ไม่ใช่ "คำตอบที่มีความน่าจะเป็นสูงสุด" แต่เป็น "คำตอบที่ผ่านทุกข้อจำกัด"

นี่คือสิ่งที่ไปป์ไลน์พากย์ของ Perso AI แก้ได้พอดี ในขั้นตอนการแปล ระบบจะสร้างผู้สมัครจำนวนมากที่เป็นไปตามข้อจำกัดด้านความยาวและ phoneme จากนั้นเลือกตัวที่สูญเสียความหมาย น้อยที่สุด มันคือแนวคิด inference-time compute จากส่วนก่อนหน้าที่ถูกย้ายมาสู่โดเมนการพากย์ หยุดไม่ให้โมเดลพูดคำตอบแรกที่ผุดขึ้นมาในใจทันที ให้มันเขียนใหม่ ให้มันตรวจสอบ นี่คือ iterative translation ซึ่งเป็นความลังเลอย่างตั้งใจที่ถูกบังคับใส่เข้าไปในเครื่อง ภายใน iterative feedback loop โมเดลไล่หาค่าที่เหมาะที่สุดระหว่างการสอดคล้องกับความยาว (Isochrony) และการสอดคล้องของความหมาย (Semantic Alignment) นี่คืองานของการปลูกถ่ายความคร่ำเคร่งของนักแปลวิดีโอเข้าไปในตัวโมเดลเอง

ปิดท้าย

ความลังเลไม่ใช่แค่ความไม่สมบูรณ์ ไม่ใช่แค่ความช้า แต่มันคือการสะสมของเวลาที่ใช้คำนึงถึงผู้อื่น หากวันหนึ่ง AI เรียนรู้ที่จะหยุดเพื่อคำนึงถึงผู้อื่นได้ มันจะไม่ใช่เพราะโมเดลฉลาดขึ้น แต่เป็นเพราะเราออกแบบให้มันไม่แน่ใจน้อยลง ให้อยู่กับเรื่องนั้นนานขึ้น ให้ลังเล

อ่านต่อ

เรียกดูทั้งหมด

ผลิตภัณฑ์

กรณีการใช้งาน

ทรัพยากร

ESTsoft Inc. 15770 Laguna Canyon Rd #250, เออร์ไวน์, รัฐแคลิฟอร์เนีย 92618

ผลิตภัณฑ์

กรณีการใช้งาน

ทรัพยากร

ESTsoft Inc. 15770 Laguna Canyon Rd #250, เออร์ไวน์, รัฐแคลิฟอร์เนีย 92618

ผลิตภัณฑ์

กรณีการใช้งาน

ทรัพยากร

ESTsoft Inc. 15770 Laguna Canyon Rd #250, เออร์ไวน์, รัฐแคลิฟอร์เนีย 92618