Como ensinar a IA a hesitar: computação em tempo de inferência e a arte da tradução ponderada

Última Atualização

Ir para a seção

Ir para a seção

Partilhar

Partilhar

Partilhar

Ferramenta de Tradução, Localização e Dublagem de Vídeo com IA

Experimente gratuitamente

Como Ensinar a IA a Hesitar

Há alguns dias, me deparei com um clipe do YouTube. O apresentador de notícias Sohn Suk-hee estava entrevistando a romancista Kim Ae-ran. A pergunta era "O que um humano tem que a IA não tem?", e a resposta dela foi "Hesitação."

A romancista trouxe à tona um momento de uma das antigas transmissões do apresentador. Enquanto anunciava a morte do falecido Roh Hoe-chan, um ativista trabalhista que se tornou político, ele ficou sem palavras por vinte segundos. O momento de conter as palavras, vacilar e discernir—hesitação. A IA é incapaz disso. Ainda assim, a hesitação de uma pessoa se torna consolo e cortesia.

Foi há cerca de vinte anos, quando eu estava focado no desenvolvimento de um jogo de tiro. Um colega da equipe de modelagem de personagens 3D me entregou um livro dizendo: "Um amigo meu do ensino médio é romancista; você deveria ler isto." Observações profundas entremeadas de humor. Fiquei completamente absorvido. O livro era a coletânea de contos de Kim Ae-ran Run, Daddy, Run (달려라 아비). Sou fã dela desde então.

Hesitação Requer Tempo e Menor Certeza

Kim Ae-ran disse que seus músculos de escrita se fortaleceram por meio de um cuidado meticuloso e de autoquestionamento em cada linha. Ela disse que o tempo gasto entre as frases se torna consideração pelos outros. Também sugeriu que o verdadeiro valor da literatura não está no conteúdo, mas na sua forma. Então, se a forma também importa, talvez a IA consiga imitá-la, ao menos de forma aproximada?

Do ponto de vista da física, o tempo é uma mudança no estado físico. Na física, o tempo não passou se o estado não mudou. Assim, menos mudança de estado equivale a um tempo mais lento e mais mudança equivale a um tempo mais longo. Um segundo fugaz para um humano é, para a IA, uma eternidade estendida por centenas de bilhões, até trilhões, de operações de ponto flutuante (FLOPs). Em comparação com o software do passado, as respostas recentes da IA são o produto de um trabalho árduo e prolongado. É também por isso que o setor de IA pode crescer em receita enquanto luta para obter lucro. Do ponto de vista do software legado, a IA é lenta demais para uma máquina. Até algo tão simples quanto a validação de formato JSON, quando executada por inferência de um grande modelo de linguagem, custa centenas de milhões de operações de computação em comparação com o software legado.

Os grandes modelos de linguagem (LLMs), o motor do progresso recente da IA, são programas que preveem a próxima palavra em uma frase. A IA faz circular corrente elétrica para encontrar a próxima palavra. Ela multiplica e soma repetidamente matrizes enormes. O cálculo da IA requer consumo físico de hardware. Para dotar a IA de ao menos uma forma de hesitação, o tempo de agonia humano, você a submete a um cálculo intenso. Centenas de bilhões de operações para produzir uma única próxima palavra. Outras centenas de bilhões de operações seguem para produzir a palavra depois dessa.

A maioria dos cálculos contemporâneos de deep learning envolve somas ponderadas, e os valores pré-calculados usados nessas somas são conhecidos como parâmetros.

Quando falamos do modelo 'Qwen 3.6 27B', isso significa que há 27 bilhões de parâmetros prontos para a soma ponderada, exigindo cerca de 27 bilhões de multiplicações para prever apenas um único próximo token. E isso é só o começo. Além disso, uma única multiplicação de inteiros envolve dezenas de operações lógicas e um ponto flutuante requer milhares. Dada tal complexidade, alguém poderia chamá-la de assombrosa.

Diminuir a Temperatura Aumenta o Viés

Vamos olhar mais a fundo como os LLMs funcionam. Tornou-se de conhecimento comum que o deep learning, a base dos LLMs, é uma máquina de reconhecimento de padrões que aplica padrões memorizados durante o treinamento ao uso no mundo real. Dois elementos governam esse processo de repetição: amostragem de tokens e temperatura.

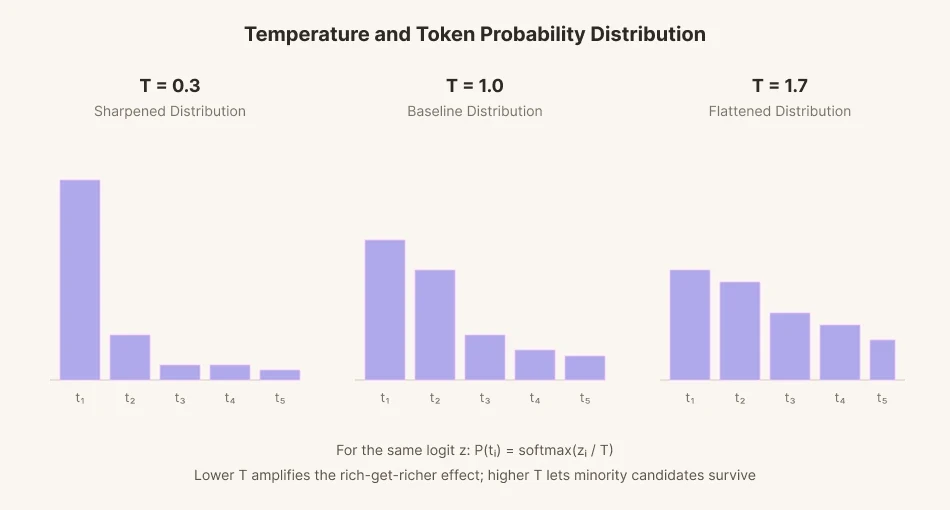

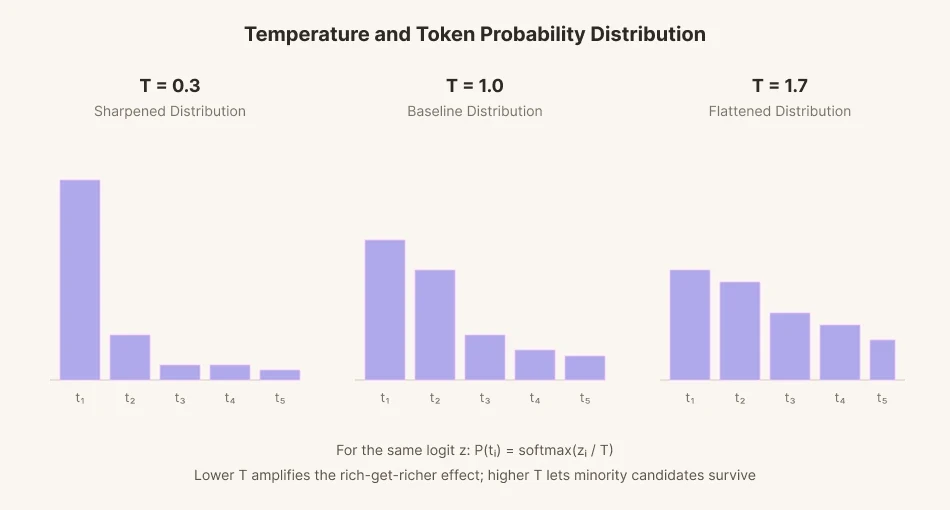

Para prever uma única próxima palavra, o modelo atribui uma pontuação (logit) a cada uma de dezenas de milhares de palavras candidatas. Essas pontuações são então convertidas em probabilidades, e uma palavra é selecionada proporcionalmente a cada probabilidade. Esse processo é chamado de amostragem.

Para adicionar variação à amostragem, foi introduzido um parâmetro matemático chamado 'temperatura'. Diminua a temperatura e a diferença entre as pontuações candidatas se estende aos extremos. Palavras com alta probabilidade são escolhidas com mais frequência do que palavras na linha de base. Palavras com baixa probabilidade são escolhidas ainda menos. É parecido com os ricos ficando mais ricos e os pobres ficando mais pobres. Por outro lado, a diferença se estreita quando a temperatura sobe. A diferença se achata e se uniformiza. Palavras de baixa probabilidade que normalmente teriam sido descartadas podem ser selecionadas com uma taxa maior quando a temperatura sobe.

A linguagem humana é semelhante a isso. O grupo e a cultura a que pertenço se refletem na distribuição de probabilidade da minha linguagem. Uma linguagem mais fria e mais nítida produz um discurso mais racional, mais otimizado e mais alinhado à maioria. Uma linguagem mais quente e mais arredondada é menos racional e menos otimizada, mas leva a minoria em conta.

Consideração é o ato de gastar energia extra para sair da distribuição de probabilidade dos próprios pensamentos. Significa perceber o que a maioria obscurece e encontrar frases que normalmente não são usadas. O que o escritor descreveu como um processo meticuloso de escrita, para a IA, deve se tornar um ato de recusar respostas baseadas apenas em treinamento enviesado e se esforçar para ir além disso.

Inquietação Mecânica

Como poderíamos ensinar a IA a ser considerada? Você não pode deixá-la despejar imediatamente a palavra de maior probabilidade. Isso apenas exporta os vieses inerentes aos dados de treinamento.

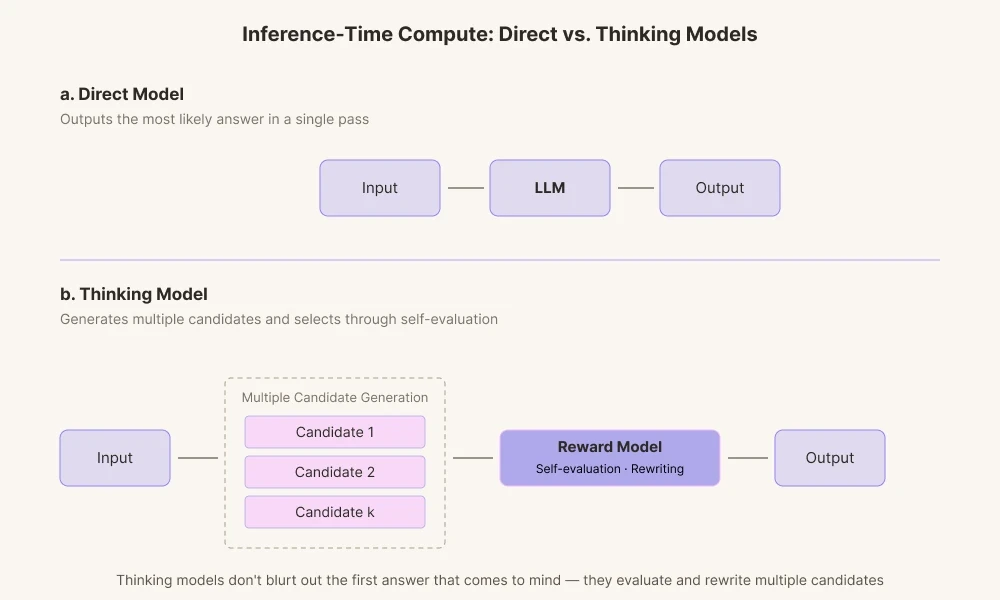

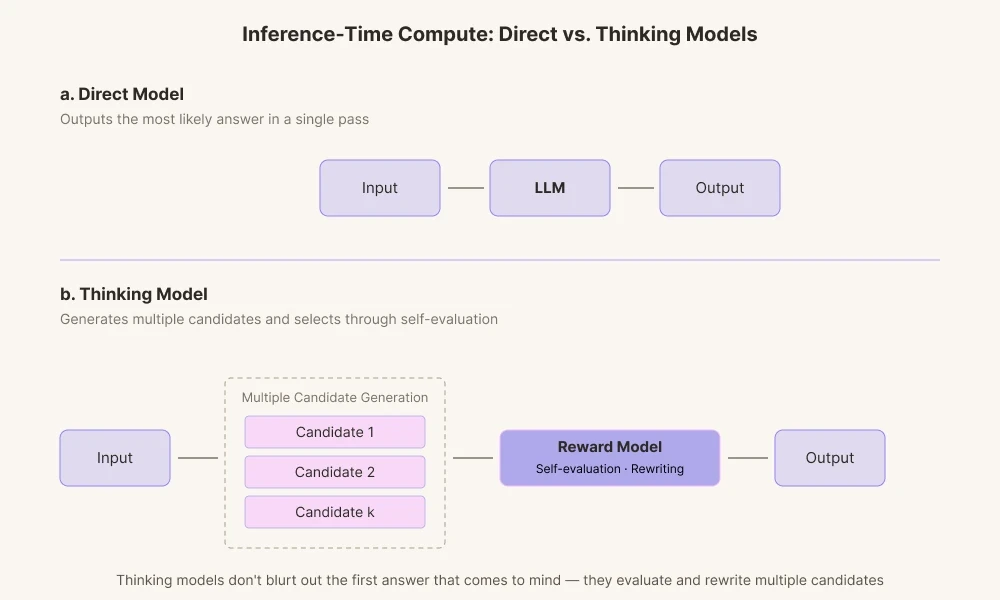

A razão pela qual os modelos de IA de hoje alcançam resultados tão impressionantes é que a área avançou na tecnologia focada em 'Inference-Time Compute'. É uma tecnologia de dar à IA mais tempo de computação antes que ela responda. Os modelos de IA do passado simplesmente produziam a primeira resposta calculada, em outras palavras, a resposta que vem primeiro à mente. Em contraste, os modelos pensantes de hoje geram múltiplos caminhos de raciocínio.

Eles produzem várias respostas candidatas e as avaliam por meio de seu modelo intrínseco de recompensa. Ele percorre o processo de verificar se as palavras se encaixam no contexto e se soam definitivas demais para ele, descartando-as internamente se necessário.

Isso é semelhante à forma como os humanos revisam frases mentalmente antes de falar. Em vez de exigir que a IA entregue uma resposta o mais precisa possível com base em distribuições de probabilidade, recursos computacionais são gastos para lhe dar tempo de revisar. Deixamos que ela vagueie do centro da massa de probabilidade para as bordas: uma espécie mecânica de inquietação.

Inquietação na Tradução de Vídeo

A tradução comum termina quando o significado se encaixa, mas a tradução de vídeo requer não apenas significado preciso, mas também que a duração e o timing dos movimentos labiais coincidam.

Se um ator na tela move a boca por 1,8 segundo e pronuncia 11 sílabas em inglês, o tradutor precisa construir uma linha em coreano que caiba dentro desses 1,8 segundos. Preserve o significado e a duração se rompe. Combine a duração e o significado fica embaçado. Quando as consoantes finais e as vogais abertas são diferentes do original, o espectador sente algo estranho no momento em que vê. As legendas trazem outra restrição: 12 a 15 caracteres por segundo de velocidade de leitura. Assim, um tradutor que trabalha com dublagem organiza cinco linhas de significado equivalente, conta sílabas, combina acentos e escolhe não a tradução mais precisa, mas a que menos perde dentro das restrições.

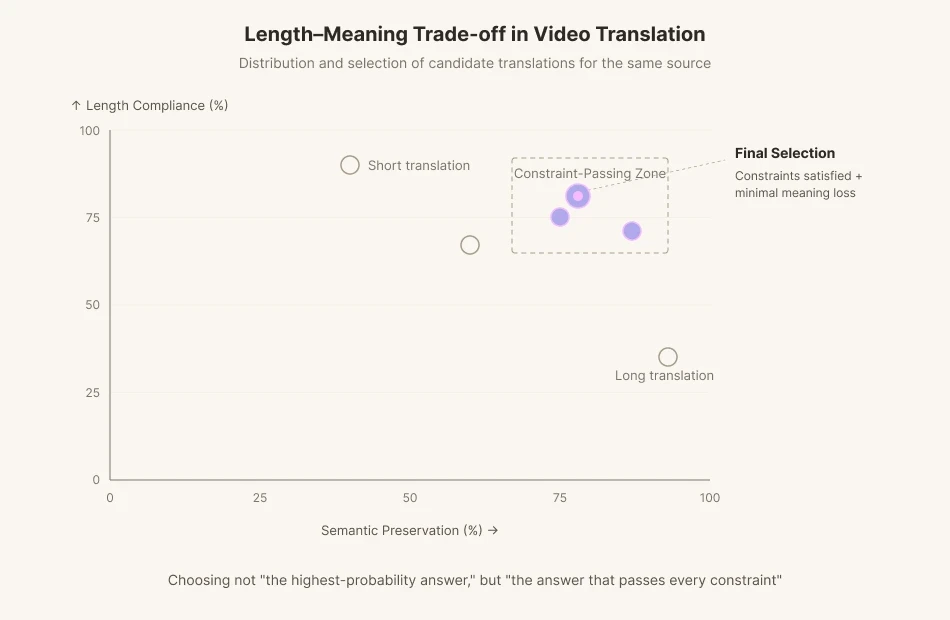

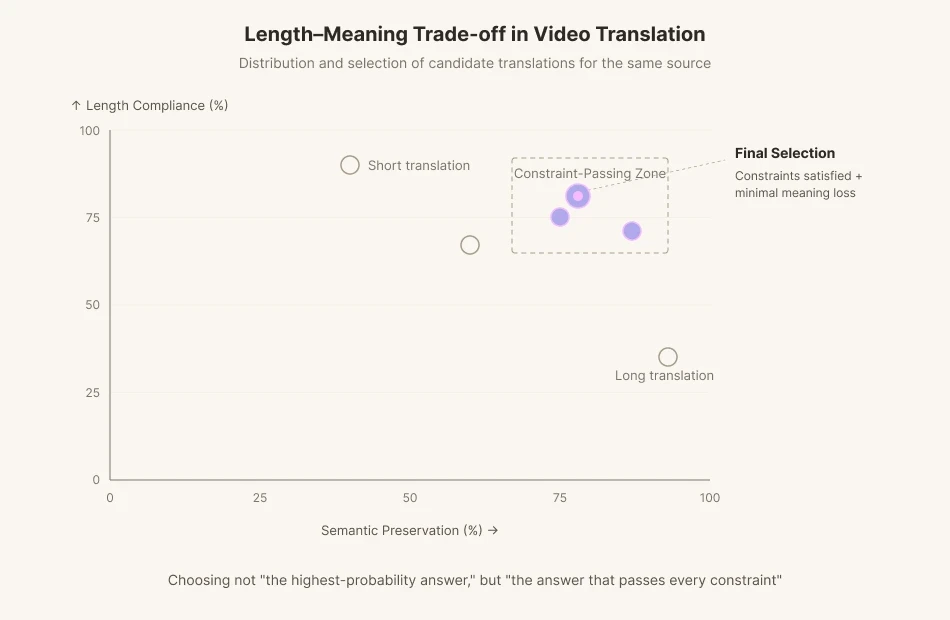

A equipe de tradução da Perso AI tem trabalhado exatamente nesse problema. A equipe publicou um artigo no EMNLP (https://aclanthology.org/2025.emnlp-demos.37) que quantifica a troca entre Isocronia (cumprimento de duração) e Alinhamento Semântico na tradução de vídeo.

EMNLP (Empirical Methods in Natural Language Processing) é um evento de primeira linha em processamento de linguagem natural. Fiel ao seu nome, valoriza a pesquisa empírica que comprova a eficácia de uma tecnologia no mundo real por meio de dados e experimentos, em vez de hipóteses puramente teóricas. Com essa característica, o artigo da equipe de pesquisa da ESTsoft enfrenta um problema difícil na tradução de vídeo, o quantifica com dados e o resolve com um algoritmo. Uma contribuição prática e real.

A questão central que o pipeline de dublagem da Perso AI leva em conta está aqui. Não caracteres, não sílabas, mas o fonema, que é a menor unidade da fala. Caracteres e sílabas são unidades na tela; fonemas correspondem ao tempo realmente gasto na boca. O algoritmo proposto no artigo, CountPhonemes, conta o número de fonemas da frase traduzida, compara-o com o número-alvo de fonemas e revisa a frase para alinhar os dois.

Os modelos existentes de tradução automática são otimizados para métricas de preservação de significado como BLEU e COMET. Eles são treinados para entregar a tradução mais plausível, o mais rápido possível. Mas a tradução de vídeo às vezes precisa rejeitar a mais plausível. Quando os fonemas ficam aquém, é preciso abrir mão de parte do significado e encontrar outra formulação. Estamos pedindo à IA não "a resposta de maior probabilidade" mas "a resposta que passa por todas as restrições."

Isso é exatamente o que o pipeline de dublagem da Perso AI resolve. Na etapa de tradução, o sistema gera muitos candidatos que satisfazem as restrições de duração e fonemas, depois escolhe o que tem a menor perda semântica. É a ideia de cálculo em tempo de inferência da seção anterior, transposta para o domínio da dublagem. Impedir que o modelo dispare a primeira resposta que lhe vem à mente. Fazê-lo reescrever. Fazê-lo verificar. Essa tradução iterativa é uma hesitação deliberada imposta à máquina. Dentro de um ciclo iterativo de feedback, o modelo persegue o ótimo entre o cumprimento da duração (Isocronia) e o alinhamento do significado (Alinhamento Semântico). É o trabalho de transplantar a agonia do tradutor de vídeo para o próprio modelo.

Em Conclusão

A hesitação não é mera imperfeição, nem mera lentidão. É o acúmulo do tempo gasto considerando os outros. Se a IA algum dia aprender a pausar por consideração, não será porque o modelo ficou mais inteligente. Será porque a projetamos para ter menos certeza, demorar mais, hesitar.

Como Ensinar a IA a Hesitar

Há alguns dias, me deparei com um clipe do YouTube. O apresentador de notícias Sohn Suk-hee estava entrevistando a romancista Kim Ae-ran. A pergunta era "O que um humano tem que a IA não tem?", e a resposta dela foi "Hesitação."

A romancista trouxe à tona um momento de uma das antigas transmissões do apresentador. Enquanto anunciava a morte do falecido Roh Hoe-chan, um ativista trabalhista que se tornou político, ele ficou sem palavras por vinte segundos. O momento de conter as palavras, vacilar e discernir—hesitação. A IA é incapaz disso. Ainda assim, a hesitação de uma pessoa se torna consolo e cortesia.

Foi há cerca de vinte anos, quando eu estava focado no desenvolvimento de um jogo de tiro. Um colega da equipe de modelagem de personagens 3D me entregou um livro dizendo: "Um amigo meu do ensino médio é romancista; você deveria ler isto." Observações profundas entremeadas de humor. Fiquei completamente absorvido. O livro era a coletânea de contos de Kim Ae-ran Run, Daddy, Run (달려라 아비). Sou fã dela desde então.

Hesitação Requer Tempo e Menor Certeza

Kim Ae-ran disse que seus músculos de escrita se fortaleceram por meio de um cuidado meticuloso e de autoquestionamento em cada linha. Ela disse que o tempo gasto entre as frases se torna consideração pelos outros. Também sugeriu que o verdadeiro valor da literatura não está no conteúdo, mas na sua forma. Então, se a forma também importa, talvez a IA consiga imitá-la, ao menos de forma aproximada?

Do ponto de vista da física, o tempo é uma mudança no estado físico. Na física, o tempo não passou se o estado não mudou. Assim, menos mudança de estado equivale a um tempo mais lento e mais mudança equivale a um tempo mais longo. Um segundo fugaz para um humano é, para a IA, uma eternidade estendida por centenas de bilhões, até trilhões, de operações de ponto flutuante (FLOPs). Em comparação com o software do passado, as respostas recentes da IA são o produto de um trabalho árduo e prolongado. É também por isso que o setor de IA pode crescer em receita enquanto luta para obter lucro. Do ponto de vista do software legado, a IA é lenta demais para uma máquina. Até algo tão simples quanto a validação de formato JSON, quando executada por inferência de um grande modelo de linguagem, custa centenas de milhões de operações de computação em comparação com o software legado.

Os grandes modelos de linguagem (LLMs), o motor do progresso recente da IA, são programas que preveem a próxima palavra em uma frase. A IA faz circular corrente elétrica para encontrar a próxima palavra. Ela multiplica e soma repetidamente matrizes enormes. O cálculo da IA requer consumo físico de hardware. Para dotar a IA de ao menos uma forma de hesitação, o tempo de agonia humano, você a submete a um cálculo intenso. Centenas de bilhões de operações para produzir uma única próxima palavra. Outras centenas de bilhões de operações seguem para produzir a palavra depois dessa.

A maioria dos cálculos contemporâneos de deep learning envolve somas ponderadas, e os valores pré-calculados usados nessas somas são conhecidos como parâmetros.

Quando falamos do modelo 'Qwen 3.6 27B', isso significa que há 27 bilhões de parâmetros prontos para a soma ponderada, exigindo cerca de 27 bilhões de multiplicações para prever apenas um único próximo token. E isso é só o começo. Além disso, uma única multiplicação de inteiros envolve dezenas de operações lógicas e um ponto flutuante requer milhares. Dada tal complexidade, alguém poderia chamá-la de assombrosa.

Diminuir a Temperatura Aumenta o Viés

Vamos olhar mais a fundo como os LLMs funcionam. Tornou-se de conhecimento comum que o deep learning, a base dos LLMs, é uma máquina de reconhecimento de padrões que aplica padrões memorizados durante o treinamento ao uso no mundo real. Dois elementos governam esse processo de repetição: amostragem de tokens e temperatura.

Para prever uma única próxima palavra, o modelo atribui uma pontuação (logit) a cada uma de dezenas de milhares de palavras candidatas. Essas pontuações são então convertidas em probabilidades, e uma palavra é selecionada proporcionalmente a cada probabilidade. Esse processo é chamado de amostragem.

Para adicionar variação à amostragem, foi introduzido um parâmetro matemático chamado 'temperatura'. Diminua a temperatura e a diferença entre as pontuações candidatas se estende aos extremos. Palavras com alta probabilidade são escolhidas com mais frequência do que palavras na linha de base. Palavras com baixa probabilidade são escolhidas ainda menos. É parecido com os ricos ficando mais ricos e os pobres ficando mais pobres. Por outro lado, a diferença se estreita quando a temperatura sobe. A diferença se achata e se uniformiza. Palavras de baixa probabilidade que normalmente teriam sido descartadas podem ser selecionadas com uma taxa maior quando a temperatura sobe.

A linguagem humana é semelhante a isso. O grupo e a cultura a que pertenço se refletem na distribuição de probabilidade da minha linguagem. Uma linguagem mais fria e mais nítida produz um discurso mais racional, mais otimizado e mais alinhado à maioria. Uma linguagem mais quente e mais arredondada é menos racional e menos otimizada, mas leva a minoria em conta.

Consideração é o ato de gastar energia extra para sair da distribuição de probabilidade dos próprios pensamentos. Significa perceber o que a maioria obscurece e encontrar frases que normalmente não são usadas. O que o escritor descreveu como um processo meticuloso de escrita, para a IA, deve se tornar um ato de recusar respostas baseadas apenas em treinamento enviesado e se esforçar para ir além disso.

Inquietação Mecânica

Como poderíamos ensinar a IA a ser considerada? Você não pode deixá-la despejar imediatamente a palavra de maior probabilidade. Isso apenas exporta os vieses inerentes aos dados de treinamento.

A razão pela qual os modelos de IA de hoje alcançam resultados tão impressionantes é que a área avançou na tecnologia focada em 'Inference-Time Compute'. É uma tecnologia de dar à IA mais tempo de computação antes que ela responda. Os modelos de IA do passado simplesmente produziam a primeira resposta calculada, em outras palavras, a resposta que vem primeiro à mente. Em contraste, os modelos pensantes de hoje geram múltiplos caminhos de raciocínio.

Eles produzem várias respostas candidatas e as avaliam por meio de seu modelo intrínseco de recompensa. Ele percorre o processo de verificar se as palavras se encaixam no contexto e se soam definitivas demais para ele, descartando-as internamente se necessário.

Isso é semelhante à forma como os humanos revisam frases mentalmente antes de falar. Em vez de exigir que a IA entregue uma resposta o mais precisa possível com base em distribuições de probabilidade, recursos computacionais são gastos para lhe dar tempo de revisar. Deixamos que ela vagueie do centro da massa de probabilidade para as bordas: uma espécie mecânica de inquietação.

Inquietação na Tradução de Vídeo

A tradução comum termina quando o significado se encaixa, mas a tradução de vídeo requer não apenas significado preciso, mas também que a duração e o timing dos movimentos labiais coincidam.

Se um ator na tela move a boca por 1,8 segundo e pronuncia 11 sílabas em inglês, o tradutor precisa construir uma linha em coreano que caiba dentro desses 1,8 segundos. Preserve o significado e a duração se rompe. Combine a duração e o significado fica embaçado. Quando as consoantes finais e as vogais abertas são diferentes do original, o espectador sente algo estranho no momento em que vê. As legendas trazem outra restrição: 12 a 15 caracteres por segundo de velocidade de leitura. Assim, um tradutor que trabalha com dublagem organiza cinco linhas de significado equivalente, conta sílabas, combina acentos e escolhe não a tradução mais precisa, mas a que menos perde dentro das restrições.

A equipe de tradução da Perso AI tem trabalhado exatamente nesse problema. A equipe publicou um artigo no EMNLP (https://aclanthology.org/2025.emnlp-demos.37) que quantifica a troca entre Isocronia (cumprimento de duração) e Alinhamento Semântico na tradução de vídeo.

EMNLP (Empirical Methods in Natural Language Processing) é um evento de primeira linha em processamento de linguagem natural. Fiel ao seu nome, valoriza a pesquisa empírica que comprova a eficácia de uma tecnologia no mundo real por meio de dados e experimentos, em vez de hipóteses puramente teóricas. Com essa característica, o artigo da equipe de pesquisa da ESTsoft enfrenta um problema difícil na tradução de vídeo, o quantifica com dados e o resolve com um algoritmo. Uma contribuição prática e real.

A questão central que o pipeline de dublagem da Perso AI leva em conta está aqui. Não caracteres, não sílabas, mas o fonema, que é a menor unidade da fala. Caracteres e sílabas são unidades na tela; fonemas correspondem ao tempo realmente gasto na boca. O algoritmo proposto no artigo, CountPhonemes, conta o número de fonemas da frase traduzida, compara-o com o número-alvo de fonemas e revisa a frase para alinhar os dois.

Os modelos existentes de tradução automática são otimizados para métricas de preservação de significado como BLEU e COMET. Eles são treinados para entregar a tradução mais plausível, o mais rápido possível. Mas a tradução de vídeo às vezes precisa rejeitar a mais plausível. Quando os fonemas ficam aquém, é preciso abrir mão de parte do significado e encontrar outra formulação. Estamos pedindo à IA não "a resposta de maior probabilidade" mas "a resposta que passa por todas as restrições."

Isso é exatamente o que o pipeline de dublagem da Perso AI resolve. Na etapa de tradução, o sistema gera muitos candidatos que satisfazem as restrições de duração e fonemas, depois escolhe o que tem a menor perda semântica. É a ideia de cálculo em tempo de inferência da seção anterior, transposta para o domínio da dublagem. Impedir que o modelo dispare a primeira resposta que lhe vem à mente. Fazê-lo reescrever. Fazê-lo verificar. Essa tradução iterativa é uma hesitação deliberada imposta à máquina. Dentro de um ciclo iterativo de feedback, o modelo persegue o ótimo entre o cumprimento da duração (Isocronia) e o alinhamento do significado (Alinhamento Semântico). É o trabalho de transplantar a agonia do tradutor de vídeo para o próprio modelo.

Em Conclusão

A hesitação não é mera imperfeição, nem mera lentidão. É o acúmulo do tempo gasto considerando os outros. Se a IA algum dia aprender a pausar por consideração, não será porque o modelo ficou mais inteligente. Será porque a projetamos para ter menos certeza, demorar mais, hesitar.

Continue lendo

Navegar por todos

PRODUTO

CASO DE USO

RECURSO

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618

PRODUTO

CASO DE USO

RECURSO

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618

PRODUTO

CASO DE USO

RECURSO

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618