KI-Lippensynchronisation für Realismus nach der Synchronisation in jeder Sprache

Jump to section

Jump to section

Teilen

Teilen

Teilen

AI Video-Übersetzer, Lokalisierung und Synchronisationswerkzeug

Probieren Sie es kostenlos aus

Ihr Team hat ein ausgefeiltes On-Camera-Video. Der Sprecher ist selbstbewusst, das Tempo ist sauber und die Botschaft kommt an. Sie schicken es zur Synchronisation für eine spanische Veröffentlichung. Die Übersetzung ist genau und die Stimme klingt professionell. Dann schauen Sie sich die Nahaufnahmen an.

Die Mundbewegungen stimmen nicht mit dem neuen Audio überein. An einigen Stellen wirken die Worte verspätet. Einige Konsonanten sehen falsch aus. Zuschauer wissen vielleicht nicht, was nicht stimmt, aber sie können es fühlen.

Dort spielt die AI Lip Sync eine Rolle. AI Lip Sync passt die übersetzte Tonspur an die sichtbaren Mundbewegungen nach dem Dubbing an, sodass das Ergebnis natürlich genug aussieht, um es real zu veröffentlichen und nicht nur intern zu überprüfen. In diesem Leitfaden erfahren Sie, was die Realitätsnähe beim Lippen-Synchronisieren ausmacht, wie Sie sie mit einer wiederholbaren Checkliste verbessern können und wo sie in einen modernen Übersetzungs- und Synchronisations-Workflow passt.

Dieser Artikel richtet sich an Vermarkter, Kreative und Produktteams, die Talking-Head-Inhalte, Testimonials und videos von Gründern veröffentlichen.

Die Realitätsnähe von AI Lip Sync beginnt mit Timing, nicht mit Magie

AI Lip Sync wird oft als letzter Polierschritt behandelt, aber die Realitätsnähe ergibt sich aus den Eingaben. Die meisten Probleme beim Lippen-Synchronisieren sind Timing-Probleme, die früher im Workflow entstehen.

Wenn die übersetzte Zeile zu lang ist, wird die Stimme gedrängt und der Mund passt nicht. Wenn die übersetzte Zeile zu kurz ist, kann die Stimme frühzeitig enden, während der Mund weiter bewegt wird. Wenn die Segmentierung unordentlich ist, driften die Übergänge zwischen den Zeilen.

Ein Workflow, der Synchronisation, Übersetzung und Synchronisierung an einem Ort kombiniert, kann diese Timing-Lücken reduzieren. Deshalb verwenden viele Teams Perso AI für mehrsprachige Lokalisierung und behandeln Lippen-Synchronisierung in der gleichen Kette wie Transkription, Skriptbearbeitungen und Stimmausgabe.

Wann ist AI Lip Sync wirklich den Aufwand wert?

Einige Formate verdecken Synchronisationsprobleme. Andere zeigen sie sofort. Sie erhalten den größten Wert von AI Lip Sync, wenn der Zuschauer das Gesicht des Sprechers sieht.

Talking-Head und Testimonials: Nahaufnahmen machen jedes Missverhältnis sichtbar, insbesondere bei starken Konsonanten und schnellen Silben.

Von Gründern geführte Produktankündigungen: Vertrauen ist an den Sprecher gebunden. Wenn Mund und Audio nicht übereinstimmen, kann das Video weniger glaubwürdig wirken.

UGC-Stil-Anzeigen und kurze Clips: Schnelle Schnitte und die direkte Kameraführung machen Zuschauer empfindlicher gegenüber allem, was sich falsch anfühlt.

Für kreative Workflows, die mit internationalem Wachstum beginnen, beginnt die mehrsprachige Veröffentlichung oft mit YouTube-Inhalten, weshalb viele Teams ihren Prozess auf YouTube-Ersteller, die global mit synchronisierten Videos expandieren ausrichten, bevor sie auf andere Kanäle skalieren.

Die Teile des Dubbing, die den Mund-Realismus am meisten beeinflussen

Lippen-Synchronisierung ist nicht nur ein visuelles Merkmal. Es ist das Ergebnis mehrerer vorgelagerter Schritte, die Timing und Mundhinweise formen.

Skriptlänge und Sprechbarkeit

Eine Übersetzung kann korrekt, aber nicht sprechbar sein. Wenn sie sich wie geschriebener Text liest, klingt die Stimme unnatürlich und der Mund passt nicht gut.

Segmentierung und Zeilenumbrüche

Wenn ein Satz an der falschen Stelle geteilt wird, pausiert die Stimme, wo der Mund es nicht tut. Saubere Segmentierung hält den Sprachrhythmus näher am Original.

Audio-Timing und Atempausen

Natürliche Sprache enthält Mikro-Pausen. Wenn die Stimmausgabe sie entfernt, kann der Mund aussehen, als bewege er sich in einem anderen Rhythmus.

Deshalb ist die Skriptkontrolle im Video-Lokalisierung wichtig. Viele Teams verwenden einen Leitfaden wie AI-Video-Übersetzer-Workflows, die Lippen-Synchronisierung beinhalten um zu verstehen, wie Transkription, Übersetzung, Bearbeitung und Synchronisation zusammenhängen.

Stimmenklon und AI Lip Sync funktionieren am besten zusammen

Für On-Camera-Inhalte beeinflusst die Stimmwahl den Realismus. Wenn die Stimme nicht zum Gesicht passt, wirkt die beste Synchronisation immer noch seltsam. Stimmenklon kann helfen, Identitätsmerkmale wie Ton, Tempo und Energie zu bewahren.

Stimmenklon hilft auch, wenn derselbe Sprecher in mehreren Videos erscheint. Es reduziert Variationen und lässt Ihre lokalisierte Bibliothek konsistent erscheinen, besonders wenn Sie mehrere Sprachen mit einem Video-Übersetzer-Workflow veröffentlichen.

Wenn Sie Stimmenklon verwenden, konzentrieren Sie sich auf:

konsistentes Tempo über Szenen hinweg

stabile Aussprache von Namen und Produktbegriffen

natürliche Betonung, wo der Sprecher Schlüsselstellen hervorhebt

AI Lip Sync vs. automatisierte Dialogersetzung

Teams vergleichen manchmal AI Lip Sync mit automatisierter Dialogersetzung. Sie lösen unterschiedliche Probleme.

Automatisierte Dialogersetzung konzentriert sich darauf, Audio nach der Aufnahme zu ersetzen, oft um Leistung oder Klarheit zu verbessern. AI Lip Sync konzentriert sich darauf, neue Sprach-Audio mit den bestehenden Gesichtsausdrücken nach der Synchronisierung in Einklang zu bringen.

Wenn Ihr Problem eine übersetzte Zeile ist, die verspätet oder zu früh aussieht, ist die Lippen-Synchronisierung normalerweise das relevante Werkzeug. Wenn Ihr Problem die ursprüngliche Aufnahmequalität ist, kann die Dialogersetzung Teil der Produktion sein, nicht der Lokalisierung.

Praktische Checkliste, um Mundbewegungen natürlicher wirken zu lassen

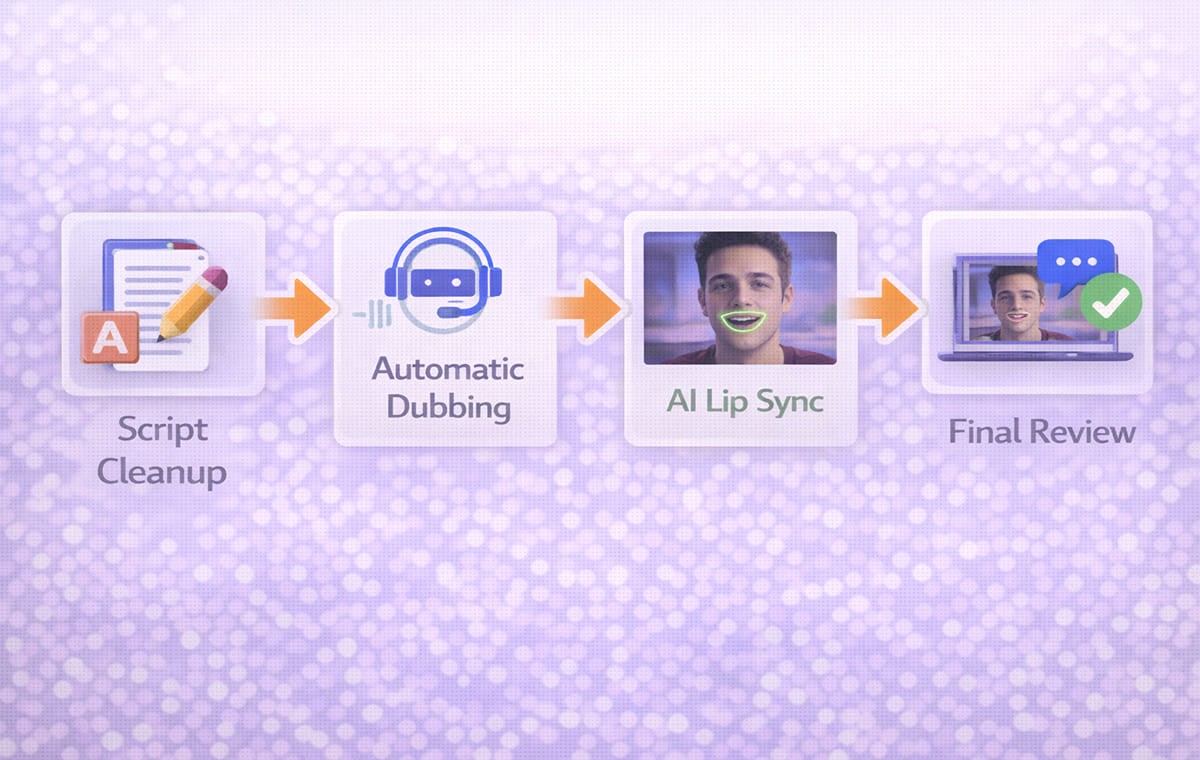

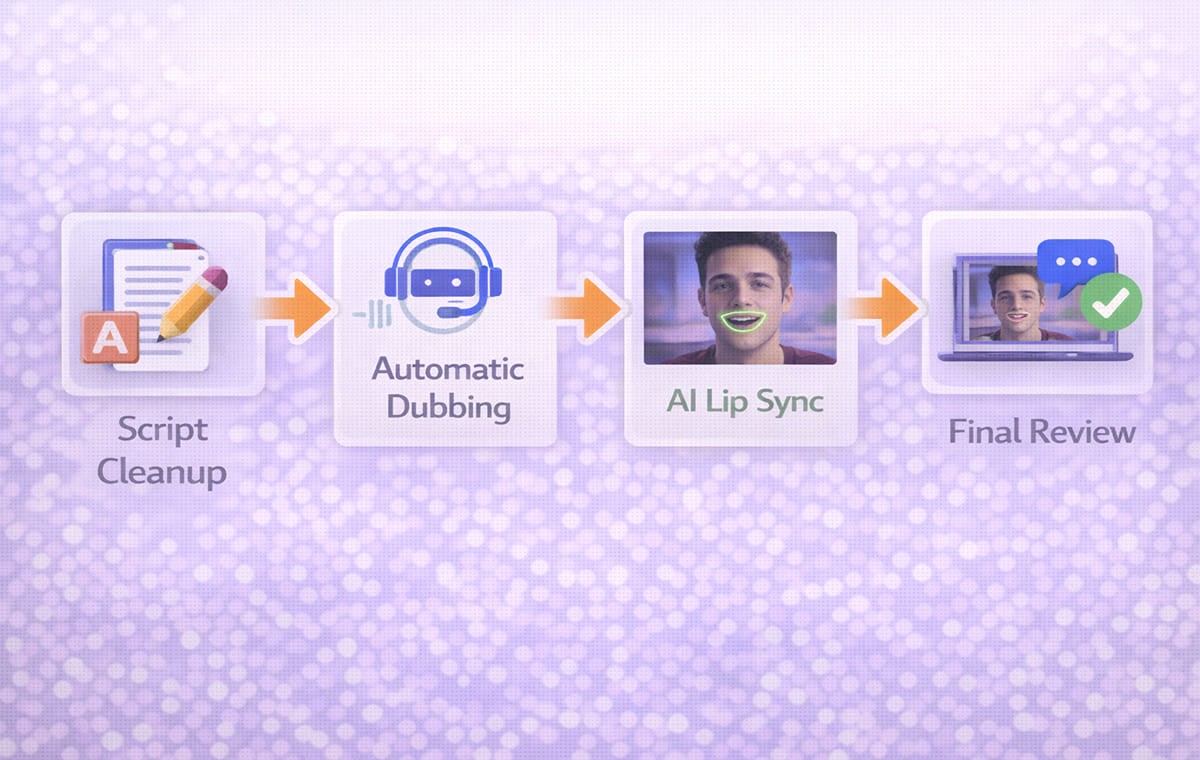

Verwenden Sie diese Checkliste vor dem Export der endgültigen Versionen. Teams, die Perso AI verwenden, führen sie oft als schnellen Überprüfungszyklus durch: Skriptanpassung → 10–20 Sekunden Vorschau → Nahaufnahmeprüfung → Export.

Beginnen Sie mit den schwierigsten Szenen: Überprüfen Sie zuerst die Nahaufnahmen. Wenn diese Szenen natürlich aussehen, folgen die Weitwinkelaufnahmen normalerweise.

Korrigieren Sie die Sprechbarkeit, bevor Sie die Synchronisation korrigieren: Wenn eine Zeile steif wirkt, verkürzen Sie sie. Ersetzen Sie wörtliche Ausdrücke durch natürlich gesprochene Formulierungen. Dies reduziert das gedrängte Timing.

Richten Sie die Segmentierung an sichtbaren Pausen aus: Teilen Sie Zeilen, wo der Mund des Sprechers natürlich pausiert. Vermeiden Sie es, eine Phrase mitten im Gedanken zu brechen.

Beobachten Sie Konsonantenmomente: Achten Sie auf Plosive und enge Mundformen. Diese Momente offenbaren Missverhältnisse am schnellsten.

Überprüfen Sie Übergänge zwischen Sprechenden: Stellen Sie bei Inhalten mit mehreren Sprechern sicher, dass die Übergabe sauber ist. Überlappungen können sofort zur Realitätsverlust führen.

Halten Sie einen konsistenten Überprüfungszyklus: Führen Sie kleine Anpassungen durch, sehen Sie die gleichen 10 bis 20 Sekunden Vorschau an und wiederholen Sie. Große Änderungen erhöhen das Risiko von Abweichungen.

Schnelle Auswertungstabelle für die AI Lip Sync-Qualität

Was Sie überprüfen | Wie gutes aussieht | Was zuerst angepasst werden sollte |

Mundtiming in Nahaufnahmen | Worte landen auf sichtbaren Mundaussagen | Phrasierung verkürzen, Segmentierung anpassen |

Schnelle Sprachabschnitte | Kein Gedränge oder nachlaufendes Audio | Sprechbarkeit bearbeiten, Satzlänge reduzieren |

Übergänge zwischen Sprechern | Saubere Übergaben, keine Überlappungen | Segmentierung und Zeitfenster anpassen |

Emotionale Betonung | Der Ton passt zum Gesichtsausdruck | Skript verfeinern, Liefergeschwindigkeit anpassen |

Mehrsprachige Konsistenz | Ähnlicher Rhythmus über Sprachen hinweg | Terminologie und Formulierung standardisieren |

Diese Tabelle hilft, Bewertungen objektiv zu halten, besonders wenn mehrere Teammitglieder lokalisierte Versionen genehmigen.

Wie passt automatisches Dubbing ohne Realitätsverlust?

Automatisches Dubbing ist nützlich für Geschwindigkeit, aber der Realismus verbessert sich, wenn man dennoch leichte Kontrolle ausübt.

Ein ausgewogener Ansatz:

verwenden Sie automatisierten Output für den ersten Durchgang

überprüfen Sie Sprechbarkeit und Segmentierung

anpassen von AI Lip Sync auf die Szenen, in denen Gesichter sichtbar sind

exportieren nach kurzem fokussierten Review

Dies hält die Produktion in Bewegung, während die Momente geschützt werden, die Zuschauer am meisten bemerken.

Häufig gestellte Fragen

Ist AI Lip Sync für jedes Video wichtig?

Nein. Es ist am wichtigsten, wenn der Zuschauer den Mund des Sprechers deutlich sehen kann. Bildschirmaufnahmen und Folienbasierte Videos verlassen sich oft mehr auf die Skriptqualität.

Kann AI Lip Sync ein schlecht übersetztes Skript korrigieren?

Es kann die Ausrichtung verbessern, aber unnatürliche Formulierungen nicht natürlich klingen lassen. Sprechbarkeit zuerst verbessern für bessere Ergebnisse.

Wie beeinflusst Dubbing den Realismus der Lippen-Synchronisation?

Dubbing verändert das Timing, da sich Sprachen in Länge und Rhythmus unterscheiden. Je mehr das übersetzte Skript zum Original-Timing passt, desto natürlicher sehen die Mundbewegungen aus.

Reicht ein Video-Übersetzer allein aus?

Ein Video-Übersetzer kann starke Ergebnisse erzielen, aber der Realismus hängt von Überprüfungsschritten ab, wie Sprechbarkeitsbearbeitungen und Synchronisationsüberprüfungen.

Fazit

AI Lip Sync ist die Funktion, die den Realismus schützt, wenn Sie synchronisierte, On-Camera-Inhalte veröffentlichen. Die natürlichsten Ergebnisse entstehen durch sauberes Timing, sprechbare Übersetzungen, starke Segmentierung und einen wiederholbaren Überprüfungszyklus. Wenn Sie die Lippen-Synchronisation als Teil des gesamten Workflows betrachten, mit Transkription, Skriptkontrolle und Timing-Überprüfungen, bleiben Ihre lokalisierten Videos konsistent über Märkte hinweg und skalieren einfacher. Hier passt Perso AI natürlich: Teams nutzen es, um Skriptbearbeitungen, Lippen-Synchronisation und Exporte in einem wiederholbaren Prozess zu halten, sodass die Qualität nicht abdriftet, wenn das Volumen zunimmt.

Ihr Team hat ein ausgefeiltes On-Camera-Video. Der Sprecher ist selbstbewusst, das Tempo ist sauber und die Botschaft kommt an. Sie schicken es zur Synchronisation für eine spanische Veröffentlichung. Die Übersetzung ist genau und die Stimme klingt professionell. Dann schauen Sie sich die Nahaufnahmen an.

Die Mundbewegungen stimmen nicht mit dem neuen Audio überein. An einigen Stellen wirken die Worte verspätet. Einige Konsonanten sehen falsch aus. Zuschauer wissen vielleicht nicht, was nicht stimmt, aber sie können es fühlen.

Dort spielt die AI Lip Sync eine Rolle. AI Lip Sync passt die übersetzte Tonspur an die sichtbaren Mundbewegungen nach dem Dubbing an, sodass das Ergebnis natürlich genug aussieht, um es real zu veröffentlichen und nicht nur intern zu überprüfen. In diesem Leitfaden erfahren Sie, was die Realitätsnähe beim Lippen-Synchronisieren ausmacht, wie Sie sie mit einer wiederholbaren Checkliste verbessern können und wo sie in einen modernen Übersetzungs- und Synchronisations-Workflow passt.

Dieser Artikel richtet sich an Vermarkter, Kreative und Produktteams, die Talking-Head-Inhalte, Testimonials und videos von Gründern veröffentlichen.

Die Realitätsnähe von AI Lip Sync beginnt mit Timing, nicht mit Magie

AI Lip Sync wird oft als letzter Polierschritt behandelt, aber die Realitätsnähe ergibt sich aus den Eingaben. Die meisten Probleme beim Lippen-Synchronisieren sind Timing-Probleme, die früher im Workflow entstehen.

Wenn die übersetzte Zeile zu lang ist, wird die Stimme gedrängt und der Mund passt nicht. Wenn die übersetzte Zeile zu kurz ist, kann die Stimme frühzeitig enden, während der Mund weiter bewegt wird. Wenn die Segmentierung unordentlich ist, driften die Übergänge zwischen den Zeilen.

Ein Workflow, der Synchronisation, Übersetzung und Synchronisierung an einem Ort kombiniert, kann diese Timing-Lücken reduzieren. Deshalb verwenden viele Teams Perso AI für mehrsprachige Lokalisierung und behandeln Lippen-Synchronisierung in der gleichen Kette wie Transkription, Skriptbearbeitungen und Stimmausgabe.

Wann ist AI Lip Sync wirklich den Aufwand wert?

Einige Formate verdecken Synchronisationsprobleme. Andere zeigen sie sofort. Sie erhalten den größten Wert von AI Lip Sync, wenn der Zuschauer das Gesicht des Sprechers sieht.

Talking-Head und Testimonials: Nahaufnahmen machen jedes Missverhältnis sichtbar, insbesondere bei starken Konsonanten und schnellen Silben.

Von Gründern geführte Produktankündigungen: Vertrauen ist an den Sprecher gebunden. Wenn Mund und Audio nicht übereinstimmen, kann das Video weniger glaubwürdig wirken.

UGC-Stil-Anzeigen und kurze Clips: Schnelle Schnitte und die direkte Kameraführung machen Zuschauer empfindlicher gegenüber allem, was sich falsch anfühlt.

Für kreative Workflows, die mit internationalem Wachstum beginnen, beginnt die mehrsprachige Veröffentlichung oft mit YouTube-Inhalten, weshalb viele Teams ihren Prozess auf YouTube-Ersteller, die global mit synchronisierten Videos expandieren ausrichten, bevor sie auf andere Kanäle skalieren.

Die Teile des Dubbing, die den Mund-Realismus am meisten beeinflussen

Lippen-Synchronisierung ist nicht nur ein visuelles Merkmal. Es ist das Ergebnis mehrerer vorgelagerter Schritte, die Timing und Mundhinweise formen.

Skriptlänge und Sprechbarkeit

Eine Übersetzung kann korrekt, aber nicht sprechbar sein. Wenn sie sich wie geschriebener Text liest, klingt die Stimme unnatürlich und der Mund passt nicht gut.

Segmentierung und Zeilenumbrüche

Wenn ein Satz an der falschen Stelle geteilt wird, pausiert die Stimme, wo der Mund es nicht tut. Saubere Segmentierung hält den Sprachrhythmus näher am Original.

Audio-Timing und Atempausen

Natürliche Sprache enthält Mikro-Pausen. Wenn die Stimmausgabe sie entfernt, kann der Mund aussehen, als bewege er sich in einem anderen Rhythmus.

Deshalb ist die Skriptkontrolle im Video-Lokalisierung wichtig. Viele Teams verwenden einen Leitfaden wie AI-Video-Übersetzer-Workflows, die Lippen-Synchronisierung beinhalten um zu verstehen, wie Transkription, Übersetzung, Bearbeitung und Synchronisation zusammenhängen.

Stimmenklon und AI Lip Sync funktionieren am besten zusammen

Für On-Camera-Inhalte beeinflusst die Stimmwahl den Realismus. Wenn die Stimme nicht zum Gesicht passt, wirkt die beste Synchronisation immer noch seltsam. Stimmenklon kann helfen, Identitätsmerkmale wie Ton, Tempo und Energie zu bewahren.

Stimmenklon hilft auch, wenn derselbe Sprecher in mehreren Videos erscheint. Es reduziert Variationen und lässt Ihre lokalisierte Bibliothek konsistent erscheinen, besonders wenn Sie mehrere Sprachen mit einem Video-Übersetzer-Workflow veröffentlichen.

Wenn Sie Stimmenklon verwenden, konzentrieren Sie sich auf:

konsistentes Tempo über Szenen hinweg

stabile Aussprache von Namen und Produktbegriffen

natürliche Betonung, wo der Sprecher Schlüsselstellen hervorhebt

AI Lip Sync vs. automatisierte Dialogersetzung

Teams vergleichen manchmal AI Lip Sync mit automatisierter Dialogersetzung. Sie lösen unterschiedliche Probleme.

Automatisierte Dialogersetzung konzentriert sich darauf, Audio nach der Aufnahme zu ersetzen, oft um Leistung oder Klarheit zu verbessern. AI Lip Sync konzentriert sich darauf, neue Sprach-Audio mit den bestehenden Gesichtsausdrücken nach der Synchronisierung in Einklang zu bringen.

Wenn Ihr Problem eine übersetzte Zeile ist, die verspätet oder zu früh aussieht, ist die Lippen-Synchronisierung normalerweise das relevante Werkzeug. Wenn Ihr Problem die ursprüngliche Aufnahmequalität ist, kann die Dialogersetzung Teil der Produktion sein, nicht der Lokalisierung.

Praktische Checkliste, um Mundbewegungen natürlicher wirken zu lassen

Verwenden Sie diese Checkliste vor dem Export der endgültigen Versionen. Teams, die Perso AI verwenden, führen sie oft als schnellen Überprüfungszyklus durch: Skriptanpassung → 10–20 Sekunden Vorschau → Nahaufnahmeprüfung → Export.

Beginnen Sie mit den schwierigsten Szenen: Überprüfen Sie zuerst die Nahaufnahmen. Wenn diese Szenen natürlich aussehen, folgen die Weitwinkelaufnahmen normalerweise.

Korrigieren Sie die Sprechbarkeit, bevor Sie die Synchronisation korrigieren: Wenn eine Zeile steif wirkt, verkürzen Sie sie. Ersetzen Sie wörtliche Ausdrücke durch natürlich gesprochene Formulierungen. Dies reduziert das gedrängte Timing.

Richten Sie die Segmentierung an sichtbaren Pausen aus: Teilen Sie Zeilen, wo der Mund des Sprechers natürlich pausiert. Vermeiden Sie es, eine Phrase mitten im Gedanken zu brechen.

Beobachten Sie Konsonantenmomente: Achten Sie auf Plosive und enge Mundformen. Diese Momente offenbaren Missverhältnisse am schnellsten.

Überprüfen Sie Übergänge zwischen Sprechenden: Stellen Sie bei Inhalten mit mehreren Sprechern sicher, dass die Übergabe sauber ist. Überlappungen können sofort zur Realitätsverlust führen.

Halten Sie einen konsistenten Überprüfungszyklus: Führen Sie kleine Anpassungen durch, sehen Sie die gleichen 10 bis 20 Sekunden Vorschau an und wiederholen Sie. Große Änderungen erhöhen das Risiko von Abweichungen.

Schnelle Auswertungstabelle für die AI Lip Sync-Qualität

Was Sie überprüfen | Wie gutes aussieht | Was zuerst angepasst werden sollte |

Mundtiming in Nahaufnahmen | Worte landen auf sichtbaren Mundaussagen | Phrasierung verkürzen, Segmentierung anpassen |

Schnelle Sprachabschnitte | Kein Gedränge oder nachlaufendes Audio | Sprechbarkeit bearbeiten, Satzlänge reduzieren |

Übergänge zwischen Sprechern | Saubere Übergaben, keine Überlappungen | Segmentierung und Zeitfenster anpassen |

Emotionale Betonung | Der Ton passt zum Gesichtsausdruck | Skript verfeinern, Liefergeschwindigkeit anpassen |

Mehrsprachige Konsistenz | Ähnlicher Rhythmus über Sprachen hinweg | Terminologie und Formulierung standardisieren |

Diese Tabelle hilft, Bewertungen objektiv zu halten, besonders wenn mehrere Teammitglieder lokalisierte Versionen genehmigen.

Wie passt automatisches Dubbing ohne Realitätsverlust?

Automatisches Dubbing ist nützlich für Geschwindigkeit, aber der Realismus verbessert sich, wenn man dennoch leichte Kontrolle ausübt.

Ein ausgewogener Ansatz:

verwenden Sie automatisierten Output für den ersten Durchgang

überprüfen Sie Sprechbarkeit und Segmentierung

anpassen von AI Lip Sync auf die Szenen, in denen Gesichter sichtbar sind

exportieren nach kurzem fokussierten Review

Dies hält die Produktion in Bewegung, während die Momente geschützt werden, die Zuschauer am meisten bemerken.

Häufig gestellte Fragen

Ist AI Lip Sync für jedes Video wichtig?

Nein. Es ist am wichtigsten, wenn der Zuschauer den Mund des Sprechers deutlich sehen kann. Bildschirmaufnahmen und Folienbasierte Videos verlassen sich oft mehr auf die Skriptqualität.

Kann AI Lip Sync ein schlecht übersetztes Skript korrigieren?

Es kann die Ausrichtung verbessern, aber unnatürliche Formulierungen nicht natürlich klingen lassen. Sprechbarkeit zuerst verbessern für bessere Ergebnisse.

Wie beeinflusst Dubbing den Realismus der Lippen-Synchronisation?

Dubbing verändert das Timing, da sich Sprachen in Länge und Rhythmus unterscheiden. Je mehr das übersetzte Skript zum Original-Timing passt, desto natürlicher sehen die Mundbewegungen aus.

Reicht ein Video-Übersetzer allein aus?

Ein Video-Übersetzer kann starke Ergebnisse erzielen, aber der Realismus hängt von Überprüfungsschritten ab, wie Sprechbarkeitsbearbeitungen und Synchronisationsüberprüfungen.

Fazit

AI Lip Sync ist die Funktion, die den Realismus schützt, wenn Sie synchronisierte, On-Camera-Inhalte veröffentlichen. Die natürlichsten Ergebnisse entstehen durch sauberes Timing, sprechbare Übersetzungen, starke Segmentierung und einen wiederholbaren Überprüfungszyklus. Wenn Sie die Lippen-Synchronisation als Teil des gesamten Workflows betrachten, mit Transkription, Skriptkontrolle und Timing-Überprüfungen, bleiben Ihre lokalisierten Videos konsistent über Märkte hinweg und skalieren einfacher. Hier passt Perso AI natürlich: Teams nutzen es, um Skriptbearbeitungen, Lippen-Synchronisation und Exporte in einem wiederholbaren Prozess zu halten, sodass die Qualität nicht abdriftet, wenn das Volumen zunimmt.

Weiterlesen

Alle durchsuchen

PRODUKT

ANWENDUNGSFALL

RESSOURCE

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618

PRODUKT

ANWENDUNGSFALL

RESSOURCE

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618

PRODUKT

ANWENDUNGSFALL

RESSOURCE

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618