KI-Lippensynchronisation: Wann Sie sie benötigen und warum sie im Jahr 2026 wichtig ist

Jump to section

Jump to section

Teilen

Teilen

Teilen

AI Video-Übersetzer, Lokalisierung und Synchronisationswerkzeug

Probieren Sie es kostenlos aus

Ihr Marketingteam hat gerade die Aufnahme einer Produktankündigung abgeschlossen. Der CEO hat sie vor der Kamera gehalten. Der Ton fühlt sich selbstbewusst an. Das Tempo ist natürlich.

Jetzt benötigen Sie Versionen in Spanisch, Deutsch und Japanisch für die weltweite Veröffentlichung nächste Woche.

Sie führen das Video durch ein Synchronisations-Tool. Die Übersetzung ist genau. Die neue Stimme klingt klar. Aber etwas fühlt sich falsch an. Die Bewegungen des Mundes des Sprechers stimmen nicht mit den Worten überein.

Hier wird AI-Lip-Sync entscheidend. Die meisten Vermarkter, Kreativen und Produktteams verwenden einen AI Videoübersetzer mit AI-Lip-Sync, um Inhalte in mehrere Sprachen zu skalieren, ohne jedes Video von Grund auf neu zu erstellen.

AI-Lip-Sync gleicht übersetzte Sprachuntertitel mit den Mundbewegungen des Sprechers ab, sodass das Video in der Zielsprache natürlich aussieht. Wir erklären, wann Lip-Sync es wert ist, wann nicht und wie man einen zuverlässigen Lokalisierungs-Workflow erstellt, ohne jedes Video übermäßig zu bearbeiten.

Der einfache Grund, warum Zuschauer auf Lip-Sync achten

Die meisten Zuschauer verzeihen kleine Untertitel-Timing-Probleme. Sie verzeihen selten ein Gesicht, das eindeutig nicht den Worten entspricht.

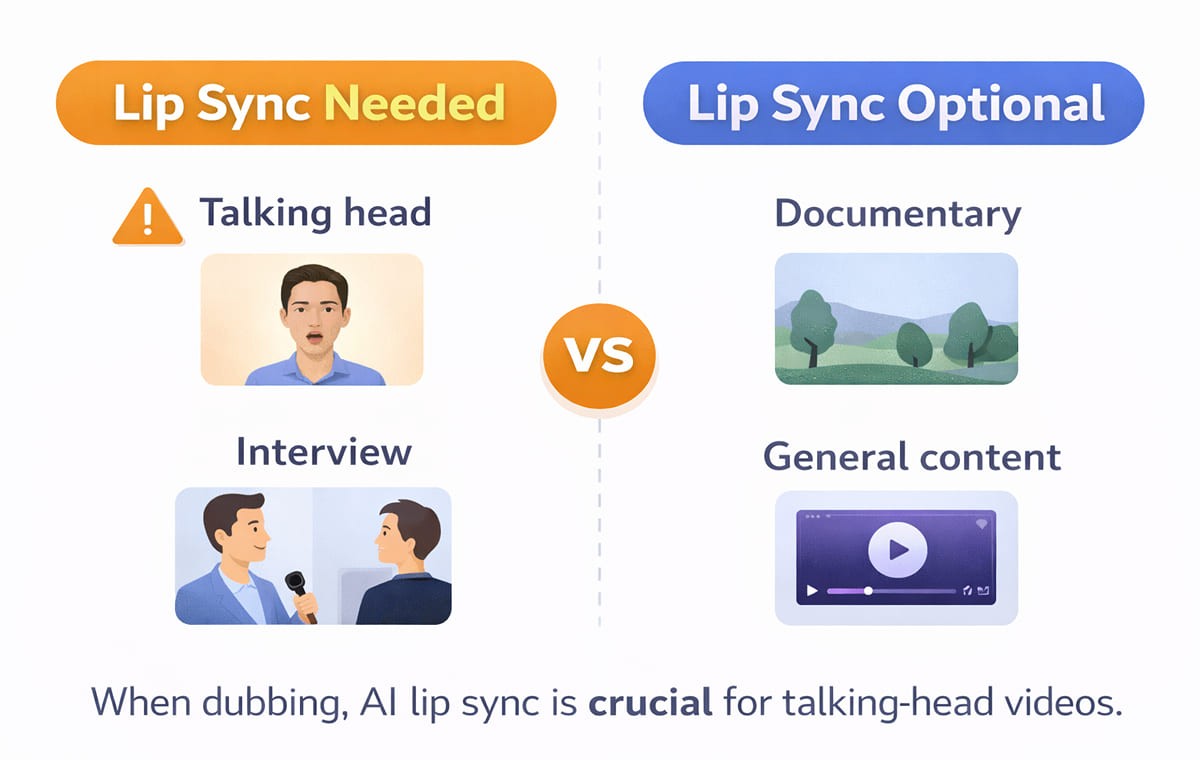

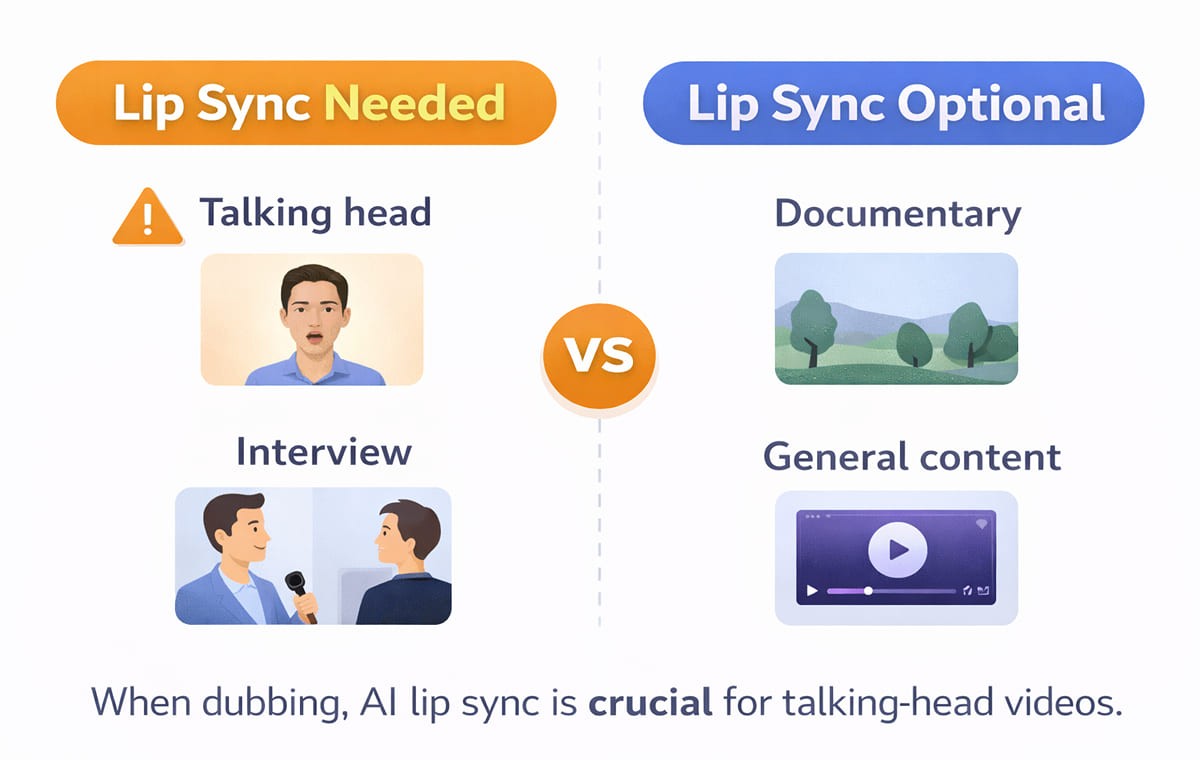

AI-Lip-Sync ist wichtig, weil es die Reaktion „etwas fühlt sich falsch an“ reduziert, die auftritt, wenn Audio und Mundbewegungen nicht übereinstimmen. Diese Reaktion ist stärker bei:

Talking-Head-Videos

Nahaufnahmen-Interviews

Gründergeführten Ankündigungen

Testimonial-Inhalten

UGC-Stil-Anzeigen

Wenn Ihr Inhalt auf Vertrauen, Klarheit oder Persönlichkeit beruht, ist AI-Lip-Sync oft der Unterschied zwischen „das fühlt sich lokal an“ und „das fühlt sich synchronisiert an“.

Wann ist AI-Lip-Sync ein Muss?

Wenn Sie entscheiden, wo Sie Aufwand investieren, beginnen Sie hier. Lip-Sync ist es wert, priorisiert zu werden, wenn Ihr Video eines oder mehrere dieser Merkmale aufweist.

On-Camera-Sprechen ist das Hauptformat

Wenn das Gesicht des Sprechers lange Zeit auf dem Bildschirm sichtbar ist, sind Unterschiede offensichtlich. Dies ist das häufigste „Muss“-Szenario für AI-Lip-Sync.

Ihre Markenstimme ist an eine reale Person gebunden

Wenn der Sprecher der CEO der Marke, Schöpfer, Trainer oder Sprecher ist, unterstützt Lip-Sync die Glaubwürdigkeit. Dies passt natürlich zu Voice Cloning, wenn Sie eine konsistente Wiedergabe über Sprachen hinweg wünschen.

Sie führen performance-orientierte Kreativität durch

Für Videoanzeigen sind kleine Vertrauenssignale entscheidend. Wenn die Stimme nicht mit dem Mund übereinstimmt, können Zuschauer schneller weiter scrollen. Für Kampagnen priorisieren Use-Case-Workflows oft Realismus über „gut genug“.

Sie haben mehrere Sprecher

Panels und Interviews sind schwieriger als Einzel-Narration. Wenn Ihr Tool mehrere Sprecher handhaben kann, hilft Lip-Sync, dass sich jede Person nach dem Sprachwechsel konsistent anfühlt.

Wann können Sie auf Lip-Sync verzichten, ohne es zu bereuen?

Sie benötigen nicht für jedes Projekt AI-Lip-Sync. In diesen Formaten kann es optional sein.

Bildschirmaufzeichnungen und Produktdemos

Wenn der Sprecher hauptsächlich außerhalb der Kamera ist und der Inhalt UI-fokussiert ist, sind Ihre Qualitätsfaktoren Klarheit, Terminologie und Tempo. Lip-Sync ist immer noch ein Bonus, aber nicht immer wesentlich.

Folien, Animationen oder Voiceover-lastige Inhalte

Wenn keine sichtbare Mundbewegung vorhanden ist, gibt es nichts zu synchronisieren. In diesen Fällen sind ein sauberer Video-Übersetzungs-Workflow und die Skriptedition wichtiger.

Internal-First-Inhalte mit geringer visueller Prüfung

Einige interne Updates können zuerst Geschwindigkeit und Abdeckung priorisieren. Sie können später für extern zugängliche Versionen aufrüsten.

Was lässt AI-Lip-Sync natürlich wirken?

Die Qualität des Lip-Sync hängt nicht nur vom Mund ab. „Natürlich“ kommt meist aus einer Kombination von Timing, Stimmenrealismus und Skriptpassung.

Timing, das die Sprache widerspiegelt

Verschiedene Sprachen erweitern oder komprimieren die Bedeutung. Gute Tools helfen, das Tempo zu vereinbaren, damit die synchronisierte Stimme nicht gehetzt oder gestreckt wirkt.

Skript, das wie ein Muttersprachler klingt

Wenn die Übersetzung wörtlich ist, kann sie sich auch bei perfektem Sync unnatürlich anhören. Daher ist ein Untertitel- und Skripteditor vor dem endgültigen Export wichtig.

Stimmenqualität, die zum Sprecher passt

Wenn die Stimme für die Person auf dem Bildschirm falsch klingt, bemerken die Zuschauer dies sofort. Hier können Voice Cloning oder gut abgestimmte Stimmen helfen, die Wiedergabe glaubwürdig zu halten.

Ein schneller Entscheidungstisch

Verwenden Sie diesen Tisch als einfachen „Brauchen wir es“-Filter.

Videoart | Benötigen Sie AI-Lip-Sync | Warum es wichtig ist |

Talking-Head, Interviews, Testimonials | Üblicherweise ja | Mund-Missmatch ist sofort sichtbar |

UGC-Stil Videoanzeigen | Oft ja | Vertrauen und Authentizität treiben Leistung an |

Webinare und Panels | Oft ja | Mehrere Sprecher verstärken das Missmatch-Risiko |

Produktdemos (meistens Bildschirm) | Manchmal | Klarheit und Skriptpassung sind wichtiger |

Animationen und Folien | Nein | Keine sichtbare Mundbewegung zum Synchronisieren |

Was Sie vor der Veröffentlichung synchronisierter Videos prüfen sollten

Wenn Sie in eine andere Sprache synchronisieren, verhindern diese Kontrollen die meisten „offensichtlich synchronisierten“ Ergebnisse.

Prüfen Sie Lip-Sync zuerst bei Nahaufnahmen

Urteilen Sie nicht über Weitwinkelaufnahmen. Überprüfen Sie die Momente, in denen der Sprecher den Rahmen füllt.

Bestätigen Sie, dass das Skript zu dem passt, was der Mund „verkaufen“ kann

Einige Phrasen sehen auf dem Mund in bestimmten Sprachen ungeschickt aus. Kleine Skriptbearbeitungen können das visuelle Gefühl natürlicher machen.

Achten Sie auf Aussprache und Markennamen

Wenn Sie Produktnamen, Abkürzungen oder markenbezogene Phrasen verwenden, verwenden Sie einen Workflow, der die konsistente Handhabung unterstützt. Viele Teams kombinieren ein Glossar mit der Skriptüberprüfung vor dem Export.

Validieren Sie den Workflow auf Ihren realen Verteilungsformaten

Testen Sie den synchronisierten Export auf Ihren tatsächlichen Kanälen. Anzeigen, YouTube und Landing-Pages können Probleme unterschiedlich aufdecken.

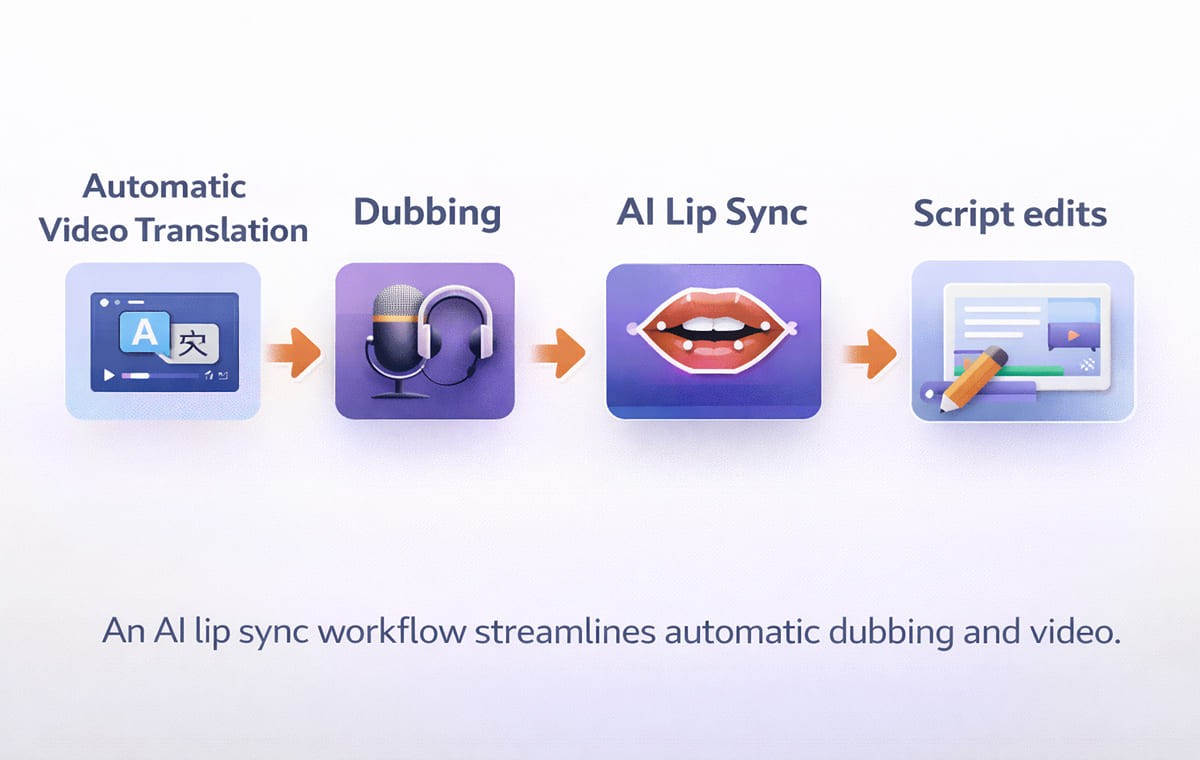

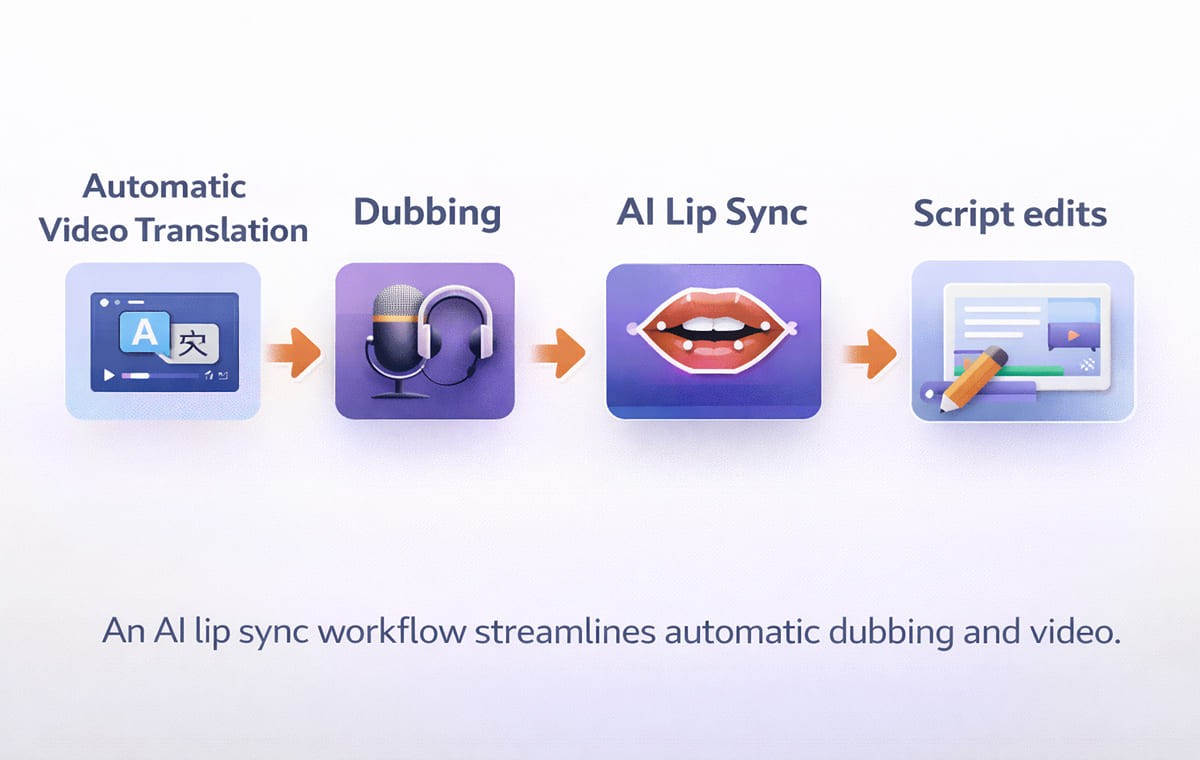

Wo AI-Lip-Sync in einen modernen Synchronisations-Workflow passt

Die meisten Teams behandeln AI-Lip-Sync als einen Teil eines größeren Systems:

Video transkribieren

Skript übersetzen

Synchronisierte Sprachuntertitel generieren

Lip-Sync anwenden

Zeilen bearbeiten, die sich nicht wie Muttersprache anfühlen

Exportieren und veröffentlichen

Wenn Sie versuchen, Automatische Synchronisation über mehrere Videos pro Woche zu skalieren, ist das Ziel Wiederholbarkeit. Eine Plattform, die Synchronisation, Übersetzung und Bearbeitung in einem Workflow kombiniert, reduziert das Hin-und-Her.

Häufig gestellte Fragen

1. Ist AI-Lip-Sync für jede Sprache wichtig?

Nicht immer. Es ist am wichtigsten, wenn das Gesicht des Sprechers sichtbar ist und das Publikum natürliche Wiedergabe erwartet. Für reine Voiceover-Inhalte ist es weniger relevant.

2. Kann ich AI-Lip-Sync ohne Voice Cloning verwenden?

Ja. Lip-Sync gleicht die Darstellung mit dem Audio ab. Voice Cloning bezieht sich darauf, die Identität oder den Ton des Sprechers über Sprachen hinweg zu bewahren.

3. Was ist der Unterschied zwischen Untertiteln und AI-Lip-Sync?

Untertitel helfen Menschen beim Lesen. AI-Lip-Sync hilft Menschen das Glauben, dass die synchronisierte Stimme dem auf dem Bildschirm sichtbaren Sprecher gehört. Viele Teams verwenden je nach Kanal beides.

4. Ist AI-Lip-Sync hauptsächlich für Schöpfer oder Unternehmen?

Beides. YouTube-Schöpfer verwenden automatische Synchronisation für AI-Videoübersetzung, um globale Zielgruppen zu erreichen. Unternehmen nutzen es, um Anzeigen, Schulungen und Produktmarketing zu lokalisieren, ohne Inhalte neu zu erstellen.

5. Wie entscheide ich, ob ein Videoübersetzer gut genug ist?

Testen Sie ein echtes Video, nicht eine Demo. Überprüfen Sie Nahaufnahmen, prüfen Sie die Steuerung der Skriptbearbeitung und bestätigen Sie, dass Ihre Terminologie bei allen Exporten konsistent bleibt.

Fazit

AI-Lip-Sync ist wichtig, wenn Ihr Inhalt von Kamera-Vertrauen, Talking-Heads, Testimonials, Schöpfervideos und kreativen Werbeanzeigen abhängt. Wenn Sie ein vorwiegend Bildschirm- oder animiertes Format haben, können Sie jedoch normalerweise zuerst an der Skriptqualität und der Klarheit der Synchronisation arbeiten und dann an Lip-Sync, wenn die Bildsprache dies erfordert.

Für US-erst-Teams, die weltweit skalieren, ist der beste Ansatz einfach: Perso AI-Lip-Sync anwenden, wo der Zuschauer den Mund sehen kann und wo Glaubwürdigkeit Ergebnissen beeinflusst, und halten Sie Ihren Synchronisations, Videoübersetzer und Automatische Synchronisation-Workflow konsistent mit wiederholbaren Überprüfungen vor der Veröffentlichung.

Ihr Marketingteam hat gerade die Aufnahme einer Produktankündigung abgeschlossen. Der CEO hat sie vor der Kamera gehalten. Der Ton fühlt sich selbstbewusst an. Das Tempo ist natürlich.

Jetzt benötigen Sie Versionen in Spanisch, Deutsch und Japanisch für die weltweite Veröffentlichung nächste Woche.

Sie führen das Video durch ein Synchronisations-Tool. Die Übersetzung ist genau. Die neue Stimme klingt klar. Aber etwas fühlt sich falsch an. Die Bewegungen des Mundes des Sprechers stimmen nicht mit den Worten überein.

Hier wird AI-Lip-Sync entscheidend. Die meisten Vermarkter, Kreativen und Produktteams verwenden einen AI Videoübersetzer mit AI-Lip-Sync, um Inhalte in mehrere Sprachen zu skalieren, ohne jedes Video von Grund auf neu zu erstellen.

AI-Lip-Sync gleicht übersetzte Sprachuntertitel mit den Mundbewegungen des Sprechers ab, sodass das Video in der Zielsprache natürlich aussieht. Wir erklären, wann Lip-Sync es wert ist, wann nicht und wie man einen zuverlässigen Lokalisierungs-Workflow erstellt, ohne jedes Video übermäßig zu bearbeiten.

Der einfache Grund, warum Zuschauer auf Lip-Sync achten

Die meisten Zuschauer verzeihen kleine Untertitel-Timing-Probleme. Sie verzeihen selten ein Gesicht, das eindeutig nicht den Worten entspricht.

AI-Lip-Sync ist wichtig, weil es die Reaktion „etwas fühlt sich falsch an“ reduziert, die auftritt, wenn Audio und Mundbewegungen nicht übereinstimmen. Diese Reaktion ist stärker bei:

Talking-Head-Videos

Nahaufnahmen-Interviews

Gründergeführten Ankündigungen

Testimonial-Inhalten

UGC-Stil-Anzeigen

Wenn Ihr Inhalt auf Vertrauen, Klarheit oder Persönlichkeit beruht, ist AI-Lip-Sync oft der Unterschied zwischen „das fühlt sich lokal an“ und „das fühlt sich synchronisiert an“.

Wann ist AI-Lip-Sync ein Muss?

Wenn Sie entscheiden, wo Sie Aufwand investieren, beginnen Sie hier. Lip-Sync ist es wert, priorisiert zu werden, wenn Ihr Video eines oder mehrere dieser Merkmale aufweist.

On-Camera-Sprechen ist das Hauptformat

Wenn das Gesicht des Sprechers lange Zeit auf dem Bildschirm sichtbar ist, sind Unterschiede offensichtlich. Dies ist das häufigste „Muss“-Szenario für AI-Lip-Sync.

Ihre Markenstimme ist an eine reale Person gebunden

Wenn der Sprecher der CEO der Marke, Schöpfer, Trainer oder Sprecher ist, unterstützt Lip-Sync die Glaubwürdigkeit. Dies passt natürlich zu Voice Cloning, wenn Sie eine konsistente Wiedergabe über Sprachen hinweg wünschen.

Sie führen performance-orientierte Kreativität durch

Für Videoanzeigen sind kleine Vertrauenssignale entscheidend. Wenn die Stimme nicht mit dem Mund übereinstimmt, können Zuschauer schneller weiter scrollen. Für Kampagnen priorisieren Use-Case-Workflows oft Realismus über „gut genug“.

Sie haben mehrere Sprecher

Panels und Interviews sind schwieriger als Einzel-Narration. Wenn Ihr Tool mehrere Sprecher handhaben kann, hilft Lip-Sync, dass sich jede Person nach dem Sprachwechsel konsistent anfühlt.

Wann können Sie auf Lip-Sync verzichten, ohne es zu bereuen?

Sie benötigen nicht für jedes Projekt AI-Lip-Sync. In diesen Formaten kann es optional sein.

Bildschirmaufzeichnungen und Produktdemos

Wenn der Sprecher hauptsächlich außerhalb der Kamera ist und der Inhalt UI-fokussiert ist, sind Ihre Qualitätsfaktoren Klarheit, Terminologie und Tempo. Lip-Sync ist immer noch ein Bonus, aber nicht immer wesentlich.

Folien, Animationen oder Voiceover-lastige Inhalte

Wenn keine sichtbare Mundbewegung vorhanden ist, gibt es nichts zu synchronisieren. In diesen Fällen sind ein sauberer Video-Übersetzungs-Workflow und die Skriptedition wichtiger.

Internal-First-Inhalte mit geringer visueller Prüfung

Einige interne Updates können zuerst Geschwindigkeit und Abdeckung priorisieren. Sie können später für extern zugängliche Versionen aufrüsten.

Was lässt AI-Lip-Sync natürlich wirken?

Die Qualität des Lip-Sync hängt nicht nur vom Mund ab. „Natürlich“ kommt meist aus einer Kombination von Timing, Stimmenrealismus und Skriptpassung.

Timing, das die Sprache widerspiegelt

Verschiedene Sprachen erweitern oder komprimieren die Bedeutung. Gute Tools helfen, das Tempo zu vereinbaren, damit die synchronisierte Stimme nicht gehetzt oder gestreckt wirkt.

Skript, das wie ein Muttersprachler klingt

Wenn die Übersetzung wörtlich ist, kann sie sich auch bei perfektem Sync unnatürlich anhören. Daher ist ein Untertitel- und Skripteditor vor dem endgültigen Export wichtig.

Stimmenqualität, die zum Sprecher passt

Wenn die Stimme für die Person auf dem Bildschirm falsch klingt, bemerken die Zuschauer dies sofort. Hier können Voice Cloning oder gut abgestimmte Stimmen helfen, die Wiedergabe glaubwürdig zu halten.

Ein schneller Entscheidungstisch

Verwenden Sie diesen Tisch als einfachen „Brauchen wir es“-Filter.

Videoart | Benötigen Sie AI-Lip-Sync | Warum es wichtig ist |

Talking-Head, Interviews, Testimonials | Üblicherweise ja | Mund-Missmatch ist sofort sichtbar |

UGC-Stil Videoanzeigen | Oft ja | Vertrauen und Authentizität treiben Leistung an |

Webinare und Panels | Oft ja | Mehrere Sprecher verstärken das Missmatch-Risiko |

Produktdemos (meistens Bildschirm) | Manchmal | Klarheit und Skriptpassung sind wichtiger |

Animationen und Folien | Nein | Keine sichtbare Mundbewegung zum Synchronisieren |

Was Sie vor der Veröffentlichung synchronisierter Videos prüfen sollten

Wenn Sie in eine andere Sprache synchronisieren, verhindern diese Kontrollen die meisten „offensichtlich synchronisierten“ Ergebnisse.

Prüfen Sie Lip-Sync zuerst bei Nahaufnahmen

Urteilen Sie nicht über Weitwinkelaufnahmen. Überprüfen Sie die Momente, in denen der Sprecher den Rahmen füllt.

Bestätigen Sie, dass das Skript zu dem passt, was der Mund „verkaufen“ kann

Einige Phrasen sehen auf dem Mund in bestimmten Sprachen ungeschickt aus. Kleine Skriptbearbeitungen können das visuelle Gefühl natürlicher machen.

Achten Sie auf Aussprache und Markennamen

Wenn Sie Produktnamen, Abkürzungen oder markenbezogene Phrasen verwenden, verwenden Sie einen Workflow, der die konsistente Handhabung unterstützt. Viele Teams kombinieren ein Glossar mit der Skriptüberprüfung vor dem Export.

Validieren Sie den Workflow auf Ihren realen Verteilungsformaten

Testen Sie den synchronisierten Export auf Ihren tatsächlichen Kanälen. Anzeigen, YouTube und Landing-Pages können Probleme unterschiedlich aufdecken.

Wo AI-Lip-Sync in einen modernen Synchronisations-Workflow passt

Die meisten Teams behandeln AI-Lip-Sync als einen Teil eines größeren Systems:

Video transkribieren

Skript übersetzen

Synchronisierte Sprachuntertitel generieren

Lip-Sync anwenden

Zeilen bearbeiten, die sich nicht wie Muttersprache anfühlen

Exportieren und veröffentlichen

Wenn Sie versuchen, Automatische Synchronisation über mehrere Videos pro Woche zu skalieren, ist das Ziel Wiederholbarkeit. Eine Plattform, die Synchronisation, Übersetzung und Bearbeitung in einem Workflow kombiniert, reduziert das Hin-und-Her.

Häufig gestellte Fragen

1. Ist AI-Lip-Sync für jede Sprache wichtig?

Nicht immer. Es ist am wichtigsten, wenn das Gesicht des Sprechers sichtbar ist und das Publikum natürliche Wiedergabe erwartet. Für reine Voiceover-Inhalte ist es weniger relevant.

2. Kann ich AI-Lip-Sync ohne Voice Cloning verwenden?

Ja. Lip-Sync gleicht die Darstellung mit dem Audio ab. Voice Cloning bezieht sich darauf, die Identität oder den Ton des Sprechers über Sprachen hinweg zu bewahren.

3. Was ist der Unterschied zwischen Untertiteln und AI-Lip-Sync?

Untertitel helfen Menschen beim Lesen. AI-Lip-Sync hilft Menschen das Glauben, dass die synchronisierte Stimme dem auf dem Bildschirm sichtbaren Sprecher gehört. Viele Teams verwenden je nach Kanal beides.

4. Ist AI-Lip-Sync hauptsächlich für Schöpfer oder Unternehmen?

Beides. YouTube-Schöpfer verwenden automatische Synchronisation für AI-Videoübersetzung, um globale Zielgruppen zu erreichen. Unternehmen nutzen es, um Anzeigen, Schulungen und Produktmarketing zu lokalisieren, ohne Inhalte neu zu erstellen.

5. Wie entscheide ich, ob ein Videoübersetzer gut genug ist?

Testen Sie ein echtes Video, nicht eine Demo. Überprüfen Sie Nahaufnahmen, prüfen Sie die Steuerung der Skriptbearbeitung und bestätigen Sie, dass Ihre Terminologie bei allen Exporten konsistent bleibt.

Fazit

AI-Lip-Sync ist wichtig, wenn Ihr Inhalt von Kamera-Vertrauen, Talking-Heads, Testimonials, Schöpfervideos und kreativen Werbeanzeigen abhängt. Wenn Sie ein vorwiegend Bildschirm- oder animiertes Format haben, können Sie jedoch normalerweise zuerst an der Skriptqualität und der Klarheit der Synchronisation arbeiten und dann an Lip-Sync, wenn die Bildsprache dies erfordert.

Für US-erst-Teams, die weltweit skalieren, ist der beste Ansatz einfach: Perso AI-Lip-Sync anwenden, wo der Zuschauer den Mund sehen kann und wo Glaubwürdigkeit Ergebnissen beeinflusst, und halten Sie Ihren Synchronisations, Videoübersetzer und Automatische Synchronisation-Workflow konsistent mit wiederholbaren Überprüfungen vor der Veröffentlichung.

Weiterlesen

Alle durchsuchen

PRODUKT

ANWENDUNGSFALL

RESSOURCE

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618

PRODUKT

ANWENDUNGSFALL

RESSOURCE

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618

PRODUKT

ANWENDUNGSFALL

RESSOURCE

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618