Video-Transkription für nahtloses Multi-Speaker-Dubbing

Jump to section

Jump to section

Teilen

Teilen

Teilen

AI Video-Übersetzer, Lokalisierung und Synchronisationswerkzeug

Probieren Sie es kostenlos aus

Ihr Team hat gerade eine Roundtable-Diskussion aufgenommen. Ein Produktmanager erklärt die Roadmap. Ein Vertriebsleiter teilt Kundeninformationen. Ein Gastexperte fügt technische Tiefe hinzu. Das Gespräch fließt natürlich auf Englisch.

Jetzt müssen Sie Versionen in Spanisch, Deutsch und Japanisch veröffentlichen. Die Übersetzung ist genau. Die Stimmen sind klar. Aber während der Wiedergabe fühlt sich etwas instabil an. Eine Zeile überlappt sich. Eine Stimme klingt, als würde sie antworten, bevor der vorherige Sprecher endet.

Inhalte mit mehreren Sprechern entlarven Schwächen in der Transkription und im Timing mehr als jedes andere Format.

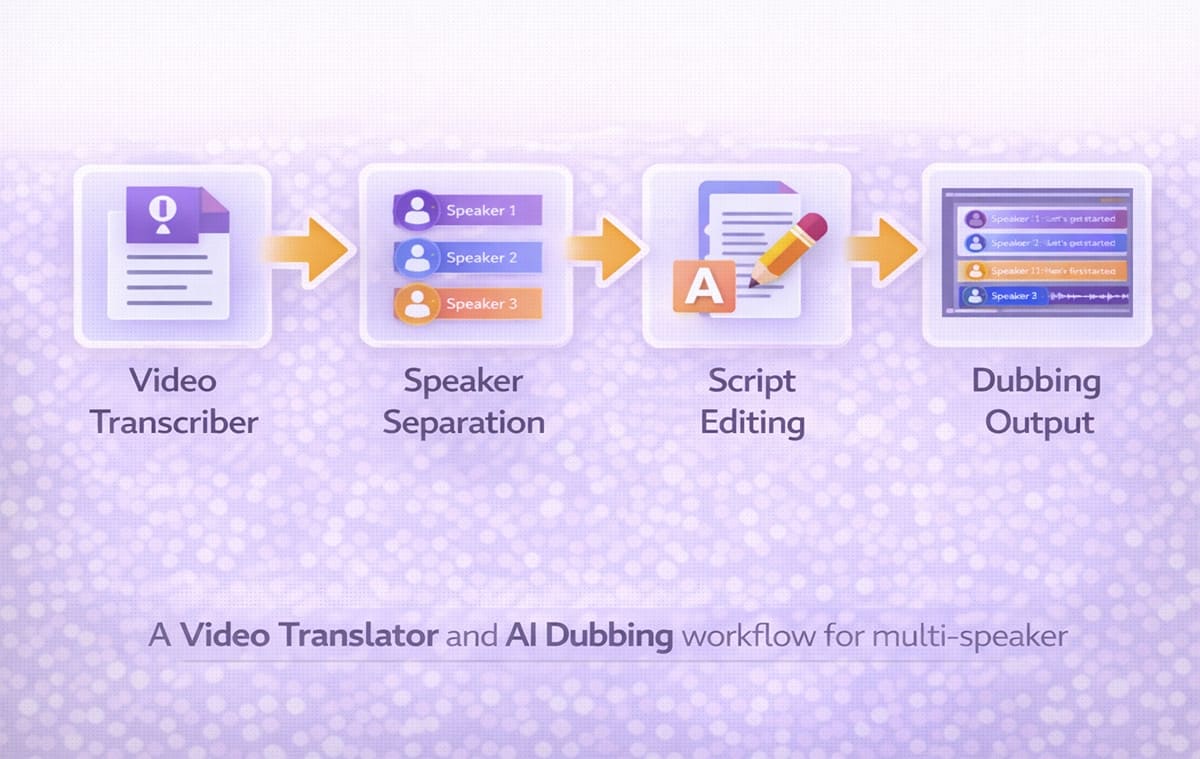

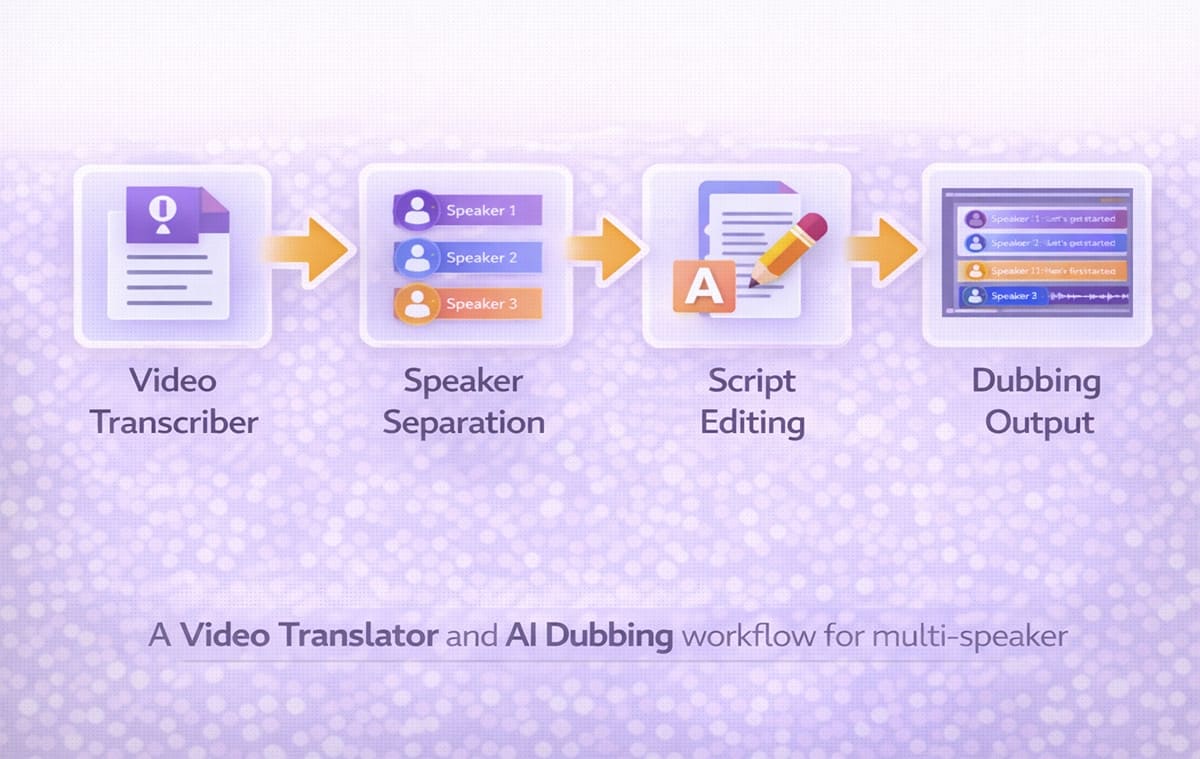

Hier wird ein starker Videotranskribierer unverzichtbar, und genau an diesem Punkt setzen Teams oft auf Perso AI, um Sprecherwechsel sauber zu halten, bevor sie synchronisierte Audios erzeugen. Ein Videotranskribierer tut mehr, als Sprache in Text umzuwandeln. In Perso AI wird es als der grundlegende Schritt behandelt, der Sprecher und Timing organisiert, damit alles nachgelagerte stabil bleibt.

Es strukturiert Sprecherwechsel, stabilisiert Zeitstempel und bereitet eine saubere Skript-Grundlage für Synchronisation, automatische Synchronisation und Videoübersetzungs-Workflows vor. In diesem Leitfaden werden wir die Funktionen untersuchen, die das Synchronisieren von Inhalten mit mehreren Sprechern nahtlos machen und wie Schöpfer und Teams ihren Workflow für zuverlässige Ergebnisse strukturieren können.

Dieser Artikel richtet sich an Schöpfer, Podcast-Hosts, SaaS-Marketing-Teams und Schulungsabteilungen, die Interviews, Webinare und diskussionsartige Inhalte produzieren.

Warum bricht Mehrsprecher-Synchronisation ohne saubere Transkription zusammen?

Einzelsprecher-Erzählungen sind vorhersehbar. Mehrsprecher-Inhalte sind es nicht. Unterbrechungen, sich überlappende Phrasen und schnelle Schlagabtausche machen das Timing komplex.

Wenn das Transkript Stimmen falsch zusammenführt, wird die Synchronisation instabil. Typische Probleme umfassen:

Sprecherzeilen, die der falschen Person zugewiesen sind

Früh/spät wirkender Sprecherwechsel

Überlappungen, die gestapelte Audios erzeugen

Übersetzungsfehler, die durch einen gebrochenen Kontext verursacht werden

Saubere Sprechererkennung hält die Gesprächsstruktur intakt, bevor die Übersetzung beginnt. In Perso AI machen Teams normalerweise einen schnellen Durchgang, um die Sprecherkennzeichnungen in den ersten 2–3 Minuten zu bestätigen, da sich kleine Fehler dort meist über die gesamte Episode hinweg wiederholen.

Für Teams, die wiederholbare Workflows aufbauen, ist die Transkriptionsqualität entscheidend dafür, dass mehrsprachige Synchronisation stabil bleibt, und Perso AI ist hier nützlich, da es die Sprecherstruktur, Bearbeitungen und Exporte in einem Fluss verbunden hält. Wenn Sie einen Referenzpunkt möchten, bietet AI-Synchronisation einen nützlichen Überblick darüber, wie die Transkriptstruktur den endgültigen Output beeinflusst.

Videotranskribiererfunktionen, die die Synchronisation mit mehreren Sprechern verbessern

Bei der Bewertung von Werkzeugen für Podiumsdiskussionen, Interviews oder Podcasts sollten Sie sich auf diese Kernkompetenzen konzentrieren.

Genau getrennte Sprecher

Eine genaue Sprecherauszeichnung ist die Grundlage. Der Transkribierer sollte während schneller Wechsel zuverlässig Sprecher-Sprechwechsel kennzeichnen und eine einfache Möglichkeit bieten, Tags zu korrigieren, wenn ein Sprecher falsch erkannt wird. Kleine Fehler hier multiplizieren sich später während der Übersetzung und Stimmerzeugung.

Achten Sie auf:

Klar gekennzeichnete Sprechersegmente

Stabile Segmentierung während schneller Wechsel

Die Möglichkeit, Sprechertags bei Bedarf manuell anzupassen

Diese Grundlage verbessert direkt die Genauigkeit der Synchronisation und reduziert Timingschwankungen.

Saubere Zeitstempelverwaltung

In inhaltsbasierten Diskussionen sind Timing-Präzision wichtiger als in einfacher Erzählung.

Der Videotranskribierer sollte:

Überlappende Untertitelblöcke vermeiden

Zielgerichtete Dialogblöcke beibehalten

Konstante Abstände zwischen Sprecherwechseln einhalten

Stabile Zeitstempel reduzieren Synchronisationsprobleme und halten den natürlichen Sprecherturn. In Perso AI erleichtern saubere Zeitstempel auch die Vorschau nur der von Ihnen geänderten Abschnitte, anstatt die vollständige Datei neu zu verarbeiten.

Bearbeitbare Skriptkontrolle

Selbst bei starker Erkennung erfordern einige Zeilen möglicherweise Verfeinerung. Eine saubere Bearbeitungsschicht verhindert eine vollständige Neuerstellung.

Ein Untertitel & Skript-Editor ermöglicht es Teams:

Segmentierung anzupassen

Formulierungen zu korrigieren

Dialogübergänge zu stabilisieren

Beim Bearbeiten schützen Sie den Ton und die Sprecheridentität, insbesondere in dialoglastigen Videos, bei denen kleine Wortänderungen beeinflussen, wie sich eine Stimme anfühlt. In Perso AI standardisieren Teams häufig einige wiederkehrende Phrasen (Intros, Segmentübergänge, Sponsorlesungen), damit jede Sprachversion konsistent bleibt. Für ein tieferes Beispiel, was zu standardisieren ist, siehe konsistente Markenstimme.

Wie hängen Videoübersetzungs-Workflows von der Sprecherstruktur ab?

Ein strukturierter Videoübersetzungs-Workflow folgt oft dieser Kette:

Transkribierung mehrsprachiger Inhalte

Übersetzung der Zeilen jedes Sprechers

Generierung von Sprachoutput pro Sprecher

Synchronisation überprüfen

Export der finalen mehrsprachigen Versionen

Wenn der anfängliche Videotranskribierer die Sprecher falsch zusammenführt, multiplizieren sich Übersetzungsfehler. Der Voice Cloning-Output kann unpassend klingen. Der Dialogrhythmus wird unnatürlich.

Ein praktisches Beispiel: Ein Team führt eine 30–45 Minuten lange Roundtable-Diskussion durch Perso AI, bestätigt die Sprecherkennzeichen für den Gastgeber + Gäste, behebt einige Überlappungssegmente und erzeugt dann lokalisierte Versionen. Die meiste Zeit wird mit dem ersten Durchgang (Sprechertags + Timing) verbracht, nicht mit der Neuproduktion von Audio.

Für globale Teams ist es hilfreich, wenn Transkription, Bearbeitung und Synchronisation an einem Ort zusammengeführt werden, sodass Sprecher-Timing, Terminologie und Exporte konsistent bleiben. Eine Videoübersetzungsplattform ist eine Option, um sie mit Ihrer Checkliste zu vergleichen.

Automatische Synchronisation vs. kontrollierte Synchronisation in Mehrsprecher-Videos

Automatische Synchronisation kann effektiv sein, wenn Sprecherwechsel strukturiert und minimal sind. Ungeskriptete Gespräche erfordern jedoch mehr Überprüfung.

Wann funktioniert automatische Synchronisation gut?

Moderierte Webinare mit klaren Sprecherwechseln

Interviewformate mit minimalen Überlappungen

Strukturierte Q&A-Sitzungen

Wann ist kontrollierte Synchronisation sicherer?

Podcast-ähnliche Gespräche

Emotionale oder schnelllebige Debatten

Multi-Gast-Panels

Live-Event-Aufzeichnungen

In diesen Fällen reduziert eine raffinierte Segmentierung vor dem finalen Export Verwirrung und schützt das Timing.

Rolle des Voice Cloning in der Mehrsprecher-Lokalisierung

Voice Cloning wird besonders nützlich in Interviews oder Panels, wo jede Stimme eine eigene Persönlichkeit hat.

Anstatt einen einzelnen generischen Erzähler zu verwenden, hilft Voice Cloning, Folgendes zu bewahren:

Individuelle Sprechstile

Autoritätsunterschiede zwischen Gastgebern und Gästen

Emotionale Tonlage während des Geschichtenerzählens

In Kombination mit einer genauen Sprechererkennung des Videotranskribierers lässt Voice Cloning mehrsprachige Synchronisation authentischer wirken.

Vergleichstabelle des Workflows für mehrere Sprecher

Workflow-Phase | Ohne strukturierte Transkription | Mit starkem Videotranskribierer |

Sprechererkennung | Zeilen werden falsch zusammengeführt | Sprecher klar getrennt |

Timing-Ausrichtung | Überlappende Segmente | Saubere Zeitstempel-Abstände |

Übersetzungsklarheit | Kontextverwirrung | Strukturierter Dialogfluss |

Stimmerzeugung | Nicht übereinstimmende Sprachentöne | Stabile Stimmzuweisungen |

Bearbeitungskontrolle | Erfordert vollständige Neuprozessierung | Nur kleinere Anpassungen |

Dieser Vergleich zeigt, warum die Videotranskribierer-Phase die Qualität von allem, was folgt, bestimmt.

Untertitel & Skript-Editor in Projekten mit mehreren Sprechern

Nach der Transkription sind in der Regel nur kleine Bereiche der Bearbeitung erforderlich. Ein Untertitel & Skript-Editor ermöglicht es Teams, kleinere Probleme schnell zu korrigieren.

Er unterstützt:

Neuzuordnung von Sprecherkennzeichen

Aufteilen langer Dialogblöcke

Anpassen des Übergangstiming

Verfeinern übersetzter Formulierungen

Dieser Schritt stärkt die Stabilität der Videoübersetzung und bereitet das Projekt für eine reibungslose automatische Synchronisation vor.

Wenn Sie Roundtables oder Interviews auf YouTube veröffentlichen, ist es entscheidend, die Sprecher über verschiedene Sprachen hinweg konsistent zu halten, ohne Stunden mit Korrekturen zu verbringen. YouTube-Synchronisation zeigt einen Workflow, den Schöpfer häufig verwenden.

Häufige Probleme bei der Synchronisation mit mehreren Sprechern

Selbst erfahrene Teams stehen vor wiederkehrenden Problemen.

Überlappendes Audio während der Übersetzung: Wenn sich zwei Sprecher gegenseitig unterbrechen, führt schlechte Segmentierung zu gestapeltem Audio im finalen Dub.

Falscher emotionaler Ton: Wenn die Übersetzung den Kontext verliert, könnte der Voice Cloning-Output flach oder unpassend klingen.

Drift zwischen den Sprechern: Kleinere Timing-Verschiebungen summieren sich und lassen Dialogantworten verzögert wirken.

Überlastung bei manueller Korrektur: Ohne saubere Transkription verbringen Teams übermäßig viel Zeit damit, einzelne Segmente zu korrigieren, anstatt Inhalte zu verfeinern.

Wie baut man einen stabilen Mehrsprecher-Videotranslator-Workflow auf?

Ein wiederholbares System reduziert die Komplexität:

Transkript mit Sprecherkennung erzeugen

Segmentierung überprüfen und korrigieren

Dialogblöcke klar übersetzen

Geeignete Stimmen zuweisen

Synchronisationsausgabe durchführen

Schnelle Synchronisationsüberprüfung durchführen

Wenn die Transkription sauber ist, wird die automatische Synchronisation deutlich vorhersehbarer und skalierbarer.

Häufig gestellte Fragen

Warum ist ein Videotranskribierer für die Mehrsprecher-Synchronisation entscheidend?

Inhalte mit mehreren Sprechern erhöhen die Timing-Komplexität. Ein strukturierter Videotranskribierer stabilisiert den Dialogfluss, bevor die Übersetzung und Stimmerzeugung stattfinden.

Bewältigt automatische Synchronisation Podiumsdiskussionen gut?

Je nachdem, es kann strukturierte Gespräche bewältigen, aber schnelllebige oder sich überlappende Dialoge profitieren oft von einer zusätzlichen Skriptüberprüfung.

Wie hilft Voice Cloning bei Interviews?

Es bewahrt die individuelle Identität und den Sprachstil über verschiedene Sprachen hinweg und verbessert die Authentizität.

Ist Skriptbearbeitung immer erforderlich?

Nicht immer, aber die meisten Projekte mit mehreren Sprechern profitieren vor dem finalen Export von kleinen Verfeinerungen.

Fazit

Inhalte mit mehreren Sprechern bringen eine Timing- und Strukturkomplexität mit sich, die einfache Erzählungen nicht aufweisen. Ein starker Videotranskribierer schützt den Dialogfluss, unterstützt saubere Segmentierung und stärkt die gesamte Synchronisationspipeline. In Kombination mit strukturierten Videoübersetzungs-Workflows und kontrollierter automatischer Synchronisation können Teams Interviews, Webinare und Podiumsdiskussionen in mehrere Sprachen skalieren, ohne Klarheit oder Sprecheridentität zu verlieren.

Ihr Team hat gerade eine Roundtable-Diskussion aufgenommen. Ein Produktmanager erklärt die Roadmap. Ein Vertriebsleiter teilt Kundeninformationen. Ein Gastexperte fügt technische Tiefe hinzu. Das Gespräch fließt natürlich auf Englisch.

Jetzt müssen Sie Versionen in Spanisch, Deutsch und Japanisch veröffentlichen. Die Übersetzung ist genau. Die Stimmen sind klar. Aber während der Wiedergabe fühlt sich etwas instabil an. Eine Zeile überlappt sich. Eine Stimme klingt, als würde sie antworten, bevor der vorherige Sprecher endet.

Inhalte mit mehreren Sprechern entlarven Schwächen in der Transkription und im Timing mehr als jedes andere Format.

Hier wird ein starker Videotranskribierer unverzichtbar, und genau an diesem Punkt setzen Teams oft auf Perso AI, um Sprecherwechsel sauber zu halten, bevor sie synchronisierte Audios erzeugen. Ein Videotranskribierer tut mehr, als Sprache in Text umzuwandeln. In Perso AI wird es als der grundlegende Schritt behandelt, der Sprecher und Timing organisiert, damit alles nachgelagerte stabil bleibt.

Es strukturiert Sprecherwechsel, stabilisiert Zeitstempel und bereitet eine saubere Skript-Grundlage für Synchronisation, automatische Synchronisation und Videoübersetzungs-Workflows vor. In diesem Leitfaden werden wir die Funktionen untersuchen, die das Synchronisieren von Inhalten mit mehreren Sprechern nahtlos machen und wie Schöpfer und Teams ihren Workflow für zuverlässige Ergebnisse strukturieren können.

Dieser Artikel richtet sich an Schöpfer, Podcast-Hosts, SaaS-Marketing-Teams und Schulungsabteilungen, die Interviews, Webinare und diskussionsartige Inhalte produzieren.

Warum bricht Mehrsprecher-Synchronisation ohne saubere Transkription zusammen?

Einzelsprecher-Erzählungen sind vorhersehbar. Mehrsprecher-Inhalte sind es nicht. Unterbrechungen, sich überlappende Phrasen und schnelle Schlagabtausche machen das Timing komplex.

Wenn das Transkript Stimmen falsch zusammenführt, wird die Synchronisation instabil. Typische Probleme umfassen:

Sprecherzeilen, die der falschen Person zugewiesen sind

Früh/spät wirkender Sprecherwechsel

Überlappungen, die gestapelte Audios erzeugen

Übersetzungsfehler, die durch einen gebrochenen Kontext verursacht werden

Saubere Sprechererkennung hält die Gesprächsstruktur intakt, bevor die Übersetzung beginnt. In Perso AI machen Teams normalerweise einen schnellen Durchgang, um die Sprecherkennzeichnungen in den ersten 2–3 Minuten zu bestätigen, da sich kleine Fehler dort meist über die gesamte Episode hinweg wiederholen.

Für Teams, die wiederholbare Workflows aufbauen, ist die Transkriptionsqualität entscheidend dafür, dass mehrsprachige Synchronisation stabil bleibt, und Perso AI ist hier nützlich, da es die Sprecherstruktur, Bearbeitungen und Exporte in einem Fluss verbunden hält. Wenn Sie einen Referenzpunkt möchten, bietet AI-Synchronisation einen nützlichen Überblick darüber, wie die Transkriptstruktur den endgültigen Output beeinflusst.

Videotranskribiererfunktionen, die die Synchronisation mit mehreren Sprechern verbessern

Bei der Bewertung von Werkzeugen für Podiumsdiskussionen, Interviews oder Podcasts sollten Sie sich auf diese Kernkompetenzen konzentrieren.

Genau getrennte Sprecher

Eine genaue Sprecherauszeichnung ist die Grundlage. Der Transkribierer sollte während schneller Wechsel zuverlässig Sprecher-Sprechwechsel kennzeichnen und eine einfache Möglichkeit bieten, Tags zu korrigieren, wenn ein Sprecher falsch erkannt wird. Kleine Fehler hier multiplizieren sich später während der Übersetzung und Stimmerzeugung.

Achten Sie auf:

Klar gekennzeichnete Sprechersegmente

Stabile Segmentierung während schneller Wechsel

Die Möglichkeit, Sprechertags bei Bedarf manuell anzupassen

Diese Grundlage verbessert direkt die Genauigkeit der Synchronisation und reduziert Timingschwankungen.

Saubere Zeitstempelverwaltung

In inhaltsbasierten Diskussionen sind Timing-Präzision wichtiger als in einfacher Erzählung.

Der Videotranskribierer sollte:

Überlappende Untertitelblöcke vermeiden

Zielgerichtete Dialogblöcke beibehalten

Konstante Abstände zwischen Sprecherwechseln einhalten

Stabile Zeitstempel reduzieren Synchronisationsprobleme und halten den natürlichen Sprecherturn. In Perso AI erleichtern saubere Zeitstempel auch die Vorschau nur der von Ihnen geänderten Abschnitte, anstatt die vollständige Datei neu zu verarbeiten.

Bearbeitbare Skriptkontrolle

Selbst bei starker Erkennung erfordern einige Zeilen möglicherweise Verfeinerung. Eine saubere Bearbeitungsschicht verhindert eine vollständige Neuerstellung.

Ein Untertitel & Skript-Editor ermöglicht es Teams:

Segmentierung anzupassen

Formulierungen zu korrigieren

Dialogübergänge zu stabilisieren

Beim Bearbeiten schützen Sie den Ton und die Sprecheridentität, insbesondere in dialoglastigen Videos, bei denen kleine Wortänderungen beeinflussen, wie sich eine Stimme anfühlt. In Perso AI standardisieren Teams häufig einige wiederkehrende Phrasen (Intros, Segmentübergänge, Sponsorlesungen), damit jede Sprachversion konsistent bleibt. Für ein tieferes Beispiel, was zu standardisieren ist, siehe konsistente Markenstimme.

Wie hängen Videoübersetzungs-Workflows von der Sprecherstruktur ab?

Ein strukturierter Videoübersetzungs-Workflow folgt oft dieser Kette:

Transkribierung mehrsprachiger Inhalte

Übersetzung der Zeilen jedes Sprechers

Generierung von Sprachoutput pro Sprecher

Synchronisation überprüfen

Export der finalen mehrsprachigen Versionen

Wenn der anfängliche Videotranskribierer die Sprecher falsch zusammenführt, multiplizieren sich Übersetzungsfehler. Der Voice Cloning-Output kann unpassend klingen. Der Dialogrhythmus wird unnatürlich.

Ein praktisches Beispiel: Ein Team führt eine 30–45 Minuten lange Roundtable-Diskussion durch Perso AI, bestätigt die Sprecherkennzeichen für den Gastgeber + Gäste, behebt einige Überlappungssegmente und erzeugt dann lokalisierte Versionen. Die meiste Zeit wird mit dem ersten Durchgang (Sprechertags + Timing) verbracht, nicht mit der Neuproduktion von Audio.

Für globale Teams ist es hilfreich, wenn Transkription, Bearbeitung und Synchronisation an einem Ort zusammengeführt werden, sodass Sprecher-Timing, Terminologie und Exporte konsistent bleiben. Eine Videoübersetzungsplattform ist eine Option, um sie mit Ihrer Checkliste zu vergleichen.

Automatische Synchronisation vs. kontrollierte Synchronisation in Mehrsprecher-Videos

Automatische Synchronisation kann effektiv sein, wenn Sprecherwechsel strukturiert und minimal sind. Ungeskriptete Gespräche erfordern jedoch mehr Überprüfung.

Wann funktioniert automatische Synchronisation gut?

Moderierte Webinare mit klaren Sprecherwechseln

Interviewformate mit minimalen Überlappungen

Strukturierte Q&A-Sitzungen

Wann ist kontrollierte Synchronisation sicherer?

Podcast-ähnliche Gespräche

Emotionale oder schnelllebige Debatten

Multi-Gast-Panels

Live-Event-Aufzeichnungen

In diesen Fällen reduziert eine raffinierte Segmentierung vor dem finalen Export Verwirrung und schützt das Timing.

Rolle des Voice Cloning in der Mehrsprecher-Lokalisierung

Voice Cloning wird besonders nützlich in Interviews oder Panels, wo jede Stimme eine eigene Persönlichkeit hat.

Anstatt einen einzelnen generischen Erzähler zu verwenden, hilft Voice Cloning, Folgendes zu bewahren:

Individuelle Sprechstile

Autoritätsunterschiede zwischen Gastgebern und Gästen

Emotionale Tonlage während des Geschichtenerzählens

In Kombination mit einer genauen Sprechererkennung des Videotranskribierers lässt Voice Cloning mehrsprachige Synchronisation authentischer wirken.

Vergleichstabelle des Workflows für mehrere Sprecher

Workflow-Phase | Ohne strukturierte Transkription | Mit starkem Videotranskribierer |

Sprechererkennung | Zeilen werden falsch zusammengeführt | Sprecher klar getrennt |

Timing-Ausrichtung | Überlappende Segmente | Saubere Zeitstempel-Abstände |

Übersetzungsklarheit | Kontextverwirrung | Strukturierter Dialogfluss |

Stimmerzeugung | Nicht übereinstimmende Sprachentöne | Stabile Stimmzuweisungen |

Bearbeitungskontrolle | Erfordert vollständige Neuprozessierung | Nur kleinere Anpassungen |

Dieser Vergleich zeigt, warum die Videotranskribierer-Phase die Qualität von allem, was folgt, bestimmt.

Untertitel & Skript-Editor in Projekten mit mehreren Sprechern

Nach der Transkription sind in der Regel nur kleine Bereiche der Bearbeitung erforderlich. Ein Untertitel & Skript-Editor ermöglicht es Teams, kleinere Probleme schnell zu korrigieren.

Er unterstützt:

Neuzuordnung von Sprecherkennzeichen

Aufteilen langer Dialogblöcke

Anpassen des Übergangstiming

Verfeinern übersetzter Formulierungen

Dieser Schritt stärkt die Stabilität der Videoübersetzung und bereitet das Projekt für eine reibungslose automatische Synchronisation vor.

Wenn Sie Roundtables oder Interviews auf YouTube veröffentlichen, ist es entscheidend, die Sprecher über verschiedene Sprachen hinweg konsistent zu halten, ohne Stunden mit Korrekturen zu verbringen. YouTube-Synchronisation zeigt einen Workflow, den Schöpfer häufig verwenden.

Häufige Probleme bei der Synchronisation mit mehreren Sprechern

Selbst erfahrene Teams stehen vor wiederkehrenden Problemen.

Überlappendes Audio während der Übersetzung: Wenn sich zwei Sprecher gegenseitig unterbrechen, führt schlechte Segmentierung zu gestapeltem Audio im finalen Dub.

Falscher emotionaler Ton: Wenn die Übersetzung den Kontext verliert, könnte der Voice Cloning-Output flach oder unpassend klingen.

Drift zwischen den Sprechern: Kleinere Timing-Verschiebungen summieren sich und lassen Dialogantworten verzögert wirken.

Überlastung bei manueller Korrektur: Ohne saubere Transkription verbringen Teams übermäßig viel Zeit damit, einzelne Segmente zu korrigieren, anstatt Inhalte zu verfeinern.

Wie baut man einen stabilen Mehrsprecher-Videotranslator-Workflow auf?

Ein wiederholbares System reduziert die Komplexität:

Transkript mit Sprecherkennung erzeugen

Segmentierung überprüfen und korrigieren

Dialogblöcke klar übersetzen

Geeignete Stimmen zuweisen

Synchronisationsausgabe durchführen

Schnelle Synchronisationsüberprüfung durchführen

Wenn die Transkription sauber ist, wird die automatische Synchronisation deutlich vorhersehbarer und skalierbarer.

Häufig gestellte Fragen

Warum ist ein Videotranskribierer für die Mehrsprecher-Synchronisation entscheidend?

Inhalte mit mehreren Sprechern erhöhen die Timing-Komplexität. Ein strukturierter Videotranskribierer stabilisiert den Dialogfluss, bevor die Übersetzung und Stimmerzeugung stattfinden.

Bewältigt automatische Synchronisation Podiumsdiskussionen gut?

Je nachdem, es kann strukturierte Gespräche bewältigen, aber schnelllebige oder sich überlappende Dialoge profitieren oft von einer zusätzlichen Skriptüberprüfung.

Wie hilft Voice Cloning bei Interviews?

Es bewahrt die individuelle Identität und den Sprachstil über verschiedene Sprachen hinweg und verbessert die Authentizität.

Ist Skriptbearbeitung immer erforderlich?

Nicht immer, aber die meisten Projekte mit mehreren Sprechern profitieren vor dem finalen Export von kleinen Verfeinerungen.

Fazit

Inhalte mit mehreren Sprechern bringen eine Timing- und Strukturkomplexität mit sich, die einfache Erzählungen nicht aufweisen. Ein starker Videotranskribierer schützt den Dialogfluss, unterstützt saubere Segmentierung und stärkt die gesamte Synchronisationspipeline. In Kombination mit strukturierten Videoübersetzungs-Workflows und kontrollierter automatischer Synchronisation können Teams Interviews, Webinare und Podiumsdiskussionen in mehrere Sprachen skalieren, ohne Klarheit oder Sprecheridentität zu verlieren.

Weiterlesen

Alle durchsuchen

PRODUKT

Live & Interaktiv

LÖSUNGEN

Nach Mission

RESSOURCE

Lernen

UNTERNEHMEN

Lösungen

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618

PRODUKT

Live & Interaktiv

LÖSUNGEN

Nach Mission

RESSOURCE

Lernen

UNTERNEHMEN

Lösungen

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618