Wie man KI das Zögern beibringt: Inferenzzeit-Computing und die Kunst der wohlüberlegten Übersetzung

Jump to section

Jump to section

Teilen

Teilen

Teilen

AI Video-Übersetzer, Lokalisierung und Synchronisationswerkzeug

Probieren Sie es kostenlos aus

Wie man KI das Zögern beibringt

Vor ein paar Tagen stieß ich auf einen YouTube-Clip. Der Nachrichtensprecher Sohn Suk-hee interviewte die Romanautorin Kim Ae-ran. Die Frage lautete „Was hat ein Mensch, was KI nicht hat?“, und ihre Antwort war „Zögern.“

Die Schriftstellerin erinnerte an einen Moment aus einer alten Sendung des Moderators. Als er die Nachricht vom Tod des verstorbenen Roh Hoe-chan, eines Gewerkschaftsaktivisten, der Politiker wurde, verlas, rang er zwanzig Sekunden lang um Worte. Der Moment des Zurückhaltens, Schwankens und Abwägens — Zögern. KI ist dazu nicht fähig. Doch das Zögern eines Menschen wird zu Trost und Höflichkeit.

Es war vor etwa zwanzig Jahren, als ich mich gerade auf die Entwicklung eines Shoot-'em-up-Spiels konzentrierte. Ein Teamkollege aus dem Bereich 3D-Charaktermodellierung drückte mir ein Buch in die Hand und sagte: „Ein Freund von mir aus der Oberschule ist Romanautor; das solltest du lesen.“ Tiefe Beobachtungen, gewürzt mit Witz. Ich war völlig gefesselt. Das Buch war Kim Ae-rans Kurzgeschichtensammlung Run, Daddy, Run (달려라 아비). Seitdem bin ich ein Fan von ihr.

Zögern braucht Zeit und geringere Gewissheit

Kim Ae-ran sagte, ihre Schreibmuskeln hätten sich durch sorgfältigste Aufmerksamkeit und Selbstbefragung bei jeder einzelnen Zeile gestärkt. Sie sagte, die Zeit zwischen den Sätzen werde zu Rücksichtnahme auf die anderen. Sie deutete außerdem an, dass der wahre Wert der Literatur nicht im Inhalt, sondern in ihrer Form liege. Wenn also auch die Form zählt, kann KI sie vielleicht zumindest grob nachahmen?

Aus physikalischer Sicht ist Zeit eine Veränderung des physikalischen Zustands. In der Physik ist die Zeit nicht vergangen, wenn sich der Zustand nicht verändert hat. Daher bedeutet weniger Zustandsänderung langsamere Zeit und mehr Veränderung längere Zeit. Eine flüchtige Sekunde für einen Menschen ist für KI eine Ewigkeit, die sich über Hunderte von Milliarden, ja Billionen von Gleitkommaoperationen (FLOPs) erstreckt. Im Vergleich zu früherer Software sind die Antworten heutiger KI das Ergebnis langer, qualvoller Schwerstarbeit. Deshalb kann die KI-Branche beim Umsatz wachsen und zugleich beim Gewinn kämpfen. Aus Sicht klassischer Software ist KI für eine Maschine viel zu langsam. Selbst etwas so Einfaches wie die JSON-Format-Validierung kostet, wenn es durch Inferenz mit großen Sprachmodellen läuft, im Vergleich zu klassischer Software Hunderte Millionen an Rechenaufwand.

Große Sprachmodelle (LLMs), der Motor des jüngsten Fortschritts der KI, sind Programme, die das nächste Wort in einem Satz vorhersagen. KI schickt elektrischen Strom auf die Suche nach dem nächsten Wort. Sie multipliziert und addiert wiederholt gewaltige Matrizen. Die Berechnung der KI erfordert den physischen Verbrauch von Hardware. Um KI mit zumindest einer Form von Zögern, der Zeit menschlicher Qual, zu beladen, setzt man sie intensiver Berechnung aus. Hunderte Milliarden Operationen, um ein einziges nächstes Wort zu erzeugen. Weitere Hunderte Milliarden Operationen folgen, um das Wort danach zu erzeugen.

Die meisten heutigen Deep-Learning-Berechnungen bestehen aus gewichteten Summen, und die vorab berechneten Werte, die in diesen Summen verwendet werden, nennt man Parameter.

Wenn wir vom Modell „Qwen 3.6 27B“ sprechen, bedeutet das, dass 27 Milliarden Parameter für die gewichtete Summierung bereitstehen, was etwa 27 Milliarden Multiplikationen erfordert, um nur ein einziges nächstes Token vorherzusagen. Und das ist erst der Anfang. Außerdem umfasst eine einzelne Ganzzahlmultiplikation Dutzende logischer Operationen, und eine Gleitkommazahl erfordert Tausende. Bei solcher Komplexität darf man das durchaus atemberaubend nennen.

Das Senken der Temperatur schärft die Voreingenommenheit

Werfen wir einen genaueren Blick darauf, wie LLMs funktionieren. Es ist mittlerweile Allgemeinwissen, dass Deep Learning, die Grundlage von LLMs, eine Mustererkennungsmaschine ist, die während des Trainings gelernte Muster auf die reale Anwendung überträgt. Zwei Dinge steuern diesen Prozess des Wiederkäuens: Token-Sampling und Temperatur.

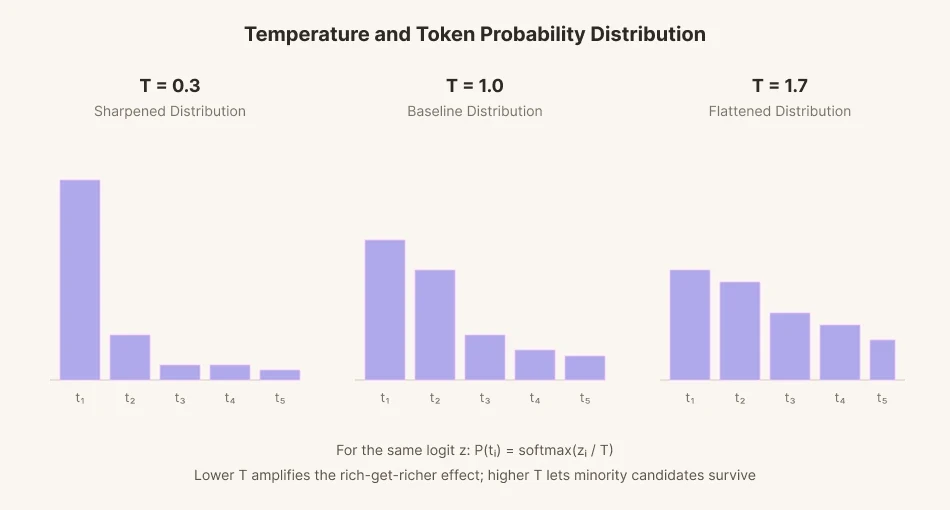

Um ein einziges nächstes Wort vorherzusagen, weist das Modell jedem von zehntausenden Kandidatenwörtern einen Wert (Logit) zu. Diese Werte werden dann in Wahrscheinlichkeiten umgewandelt, und ein Wort wird entsprechend seiner Wahrscheinlichkeit ausgewählt. Dieser Prozess heißt Sampling.

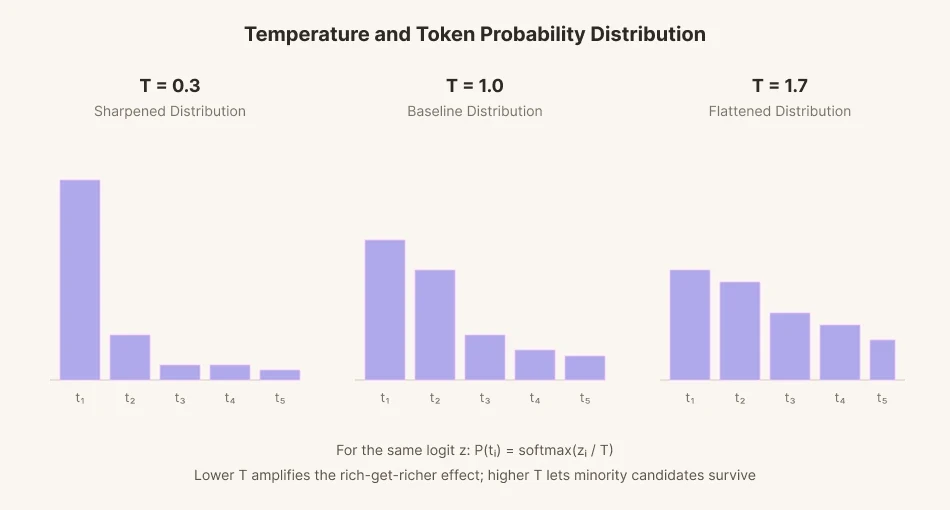

Um dem Sampling mehr Variation zu geben, wurde ein mathematischer Parameter namens „Temperatur“ eingeführt. Senkt man die Temperatur, dehnt sich die Kluft zwischen den Kandidatenwerten bis ins Extreme. Wörter mit hoher Wahrscheinlichkeit werden häufiger ausgewählt als Wörter auf dem Grundniveau. Wörter mit niedriger Wahrscheinlichkeit werden noch seltener gewählt. Das ist ähnlich wie bei den Reichen, die reicher, und den Armen, die ärmer werden. Steigt dagegen die Temperatur, verengt sich die Kluft. Sie wird flacher und gleicht sich aus. Niedrigwahrscheinliche Wörter, die normalerweise übergangen würden, können bei höherer Temperatur häufiger ausgewählt werden.

Die menschliche Sprache ist ähnlich. Die Gruppe und Kultur, zu der ich gehöre, spiegeln sich in der Wahrscheinlichkeitsverteilung meiner Sprache wider. Kältere, schärfere Sprache erzeugt eine Rede, die rationaler, stärker optimiert und stärker auf die Mehrheit ausgerichtet ist. Wärmere, rundere Sprache ist weniger rational und weniger optimiert, berücksichtigt aber die Minderheit.

Rücksichtnahme ist der Akt, zusätzliche Energie aufzuwenden, um die Wahrscheinlichkeitsverteilung der eigenen Gedanken zu verlassen. Es bedeutet, das wahrzunehmen, was die Mehrheit verdeckt, und Sätze zu finden, die normalerweise nicht verwendet werden. Was die Autorin als mühsamen Schreibprozess beschrieb, sollte für KI zu einem Akt werden, Antworten zu verweigern, die allein auf verzerrtem Training beruhen, und sich Mühe zu geben, darüber hinauszugehen.

Mechanisches Grübeln

Wie könnten wir KI beibringen, rücksichtsvoll zu sein? Man kann sie nicht einfach sofort das wahrscheinlichste Wort ausspucken lassen. Das exportiert nur die im Trainingsdatenmaterial verankerten Verzerrungen.

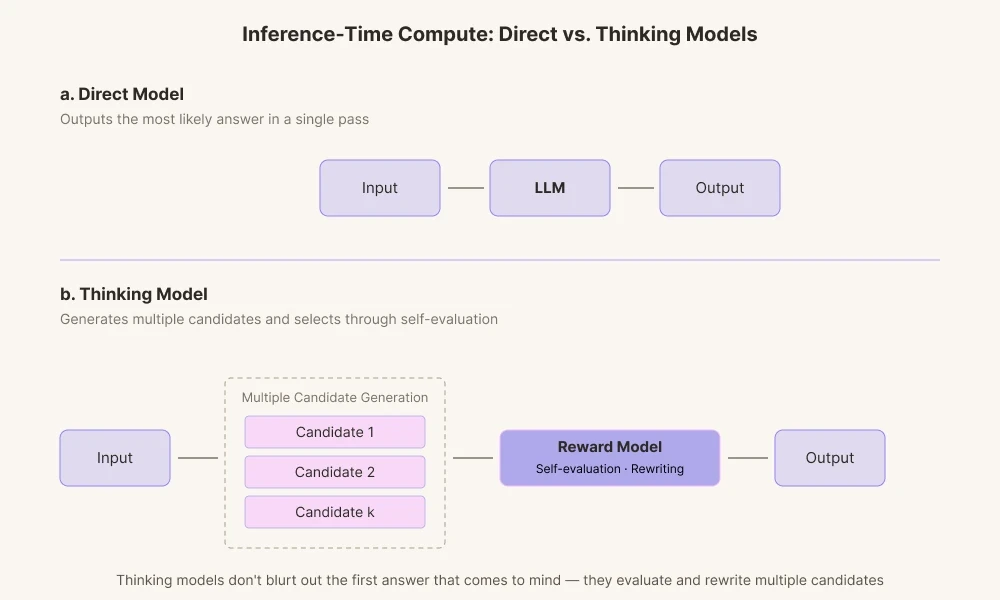

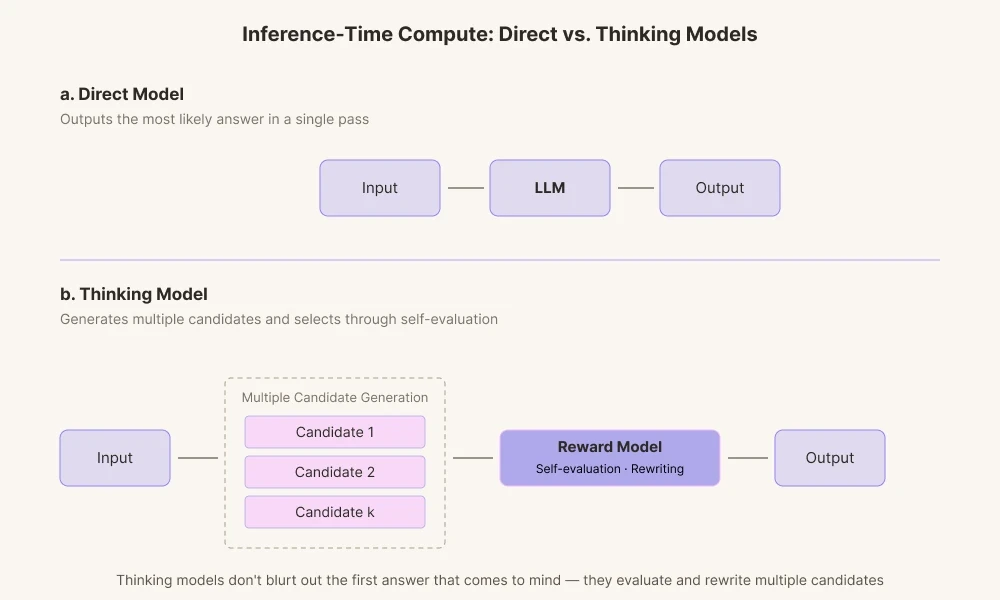

Der Grund, warum heutige KI-Modelle so beeindruckende Ergebnisse erzielen, ist, dass das Feld eine fortgeschrittene Technologie entwickelt hat, die sich auf „Inference-Time Compute“ konzentriert. Es ist eine Technologie, die der KI mehr Rechenzeit gibt, bevor sie antwortet. Frühere KI-Modelle gaben einfach die zuerst berechnete Antwort aus, also die Antwort, die ihnen zuerst in den Sinn kam. Heutige Denkmodelle hingegen erzeugen mehrere Denkpfade.

Sie erzeugen verschiedene Kandidatenantworten und bewerten sie über ihr internes Belohnungsmodell. Dabei wird geprüft, ob die Wörter zum Kontext passen und ob sie zu endgültig wirken; falls nötig werden sie intern verworfen.

Das ähnelt dem, wie Menschen Sätze im Kopf überarbeiten, bevor sie sprechen. Anstatt von KI zu verlangen, auf Grundlage von Wahrscheinlichkeitsverteilungen eine möglichst genaue Antwort zu liefern, werden Rechenressourcen darauf verwendet, ihr Zeit zum Überarbeiten zu geben. Wir lassen sie aus dem Zentrum der Wahrscheinlichkeitsmasse zu den Rändern wandern: eine mechanische Art des Grübelns.

Grübeln in der Videoübersetzung

Eine gewöhnliche Übersetzung ist beendet, sobald der Sinn passt, doch bei der Videoübersetzung müssen nicht nur die Bedeutung stimmen, sondern auch die Länge und das Timing der Lippenbewegungen übereinstimmen.

Wenn ein Schauspieler auf dem Bildschirm 1,8 Sekunden lang den Mund bewegt und 11 englische Silben spricht, muss der Übersetzer eine koreanische Zeile konstruieren, die in diese 1,8 Sekunden passt. Bewahrt man die Bedeutung, bricht die Länge auseinander. Passt man die Länge an, verschwimmt die Bedeutung. Wenn die Schlusskonsonanten und offenen Vokale sich vom Original unterscheiden, spürt der Zuschauer im selben Moment, dass etwas nicht stimmt. Untertitel bringen eine weitere Einschränkung mit sich: eine Lesegeschwindigkeit von 12 bis 15 Zeichen pro Sekunde. Deshalb legt ein Übersetzer, der für Synchronisation arbeitet, fünf Zeilen mit äquivalenter Bedeutung an, zählt Silben, gleicht Betonungen ab und wählt nicht die präziseste Übersetzung, sondern diejenige, die unter den Bedingungen am wenigsten verliert.

Das Übersetzungsteam von Perso AI arbeitet genau an diesem Problem. Das Team veröffentlichte auf der EMNLP einen Beitrag (https://aclanthology.org/2025.emnlp-demos.37), der den Zielkonflikt zwischen Isochrony (Längeneinhaltung) und Semantic Alignment in der Videoübersetzung quantifiziert.

EMNLP (Empirical Methods in Natural Language Processing) ist eine erstklassige Fachkonferenz im Bereich der natürlichen Sprachverarbeitung. Getreu seinem Namen schätzt sie empirische Forschung, die die Wirksamkeit einer Technologie in der Praxis durch Daten und Experimente belegt, statt sich auf rein theoretische Hypothesen zu stützen. Ganz in diesem Sinne nimmt sich die Arbeit des ESTsoft-Forschungsteams eines harten Problems der Videoübersetzung an, quantifiziert es mit Daten und löst es mit einem Algorithmus. Ein praktischer Beitrag für die reale Welt.

Die entscheidende Frage, die die Perso AI-Synchronisationspipeline berücksichtigt, liegt hier. Nicht Zeichen, nicht Silben, sondern das Phonem, die kleinste Einheit der Sprache. Zeichen und Silben sind Einheiten auf dem Bildschirm; Phoneme entsprechen der tatsächlich im Mund verbrachten Zeit. Der im Beitrag vorgeschlagene Algorithmus CountPhonemes zählt die Phonemanzahl des übersetzten Satzes, vergleicht sie mit der Ziel-Phonemanzahl und überarbeitet den Satz, um beide in Einklang zu bringen.

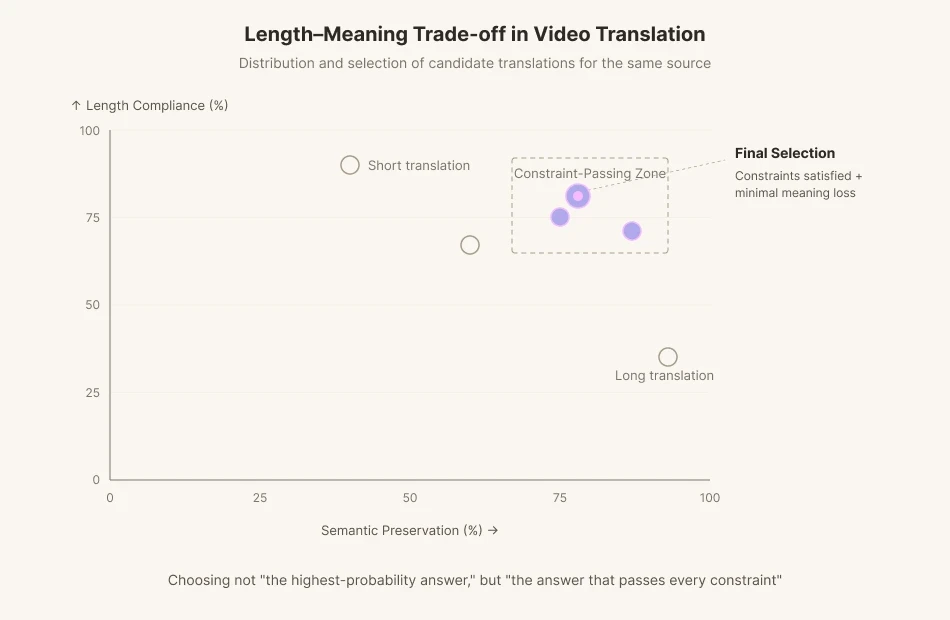

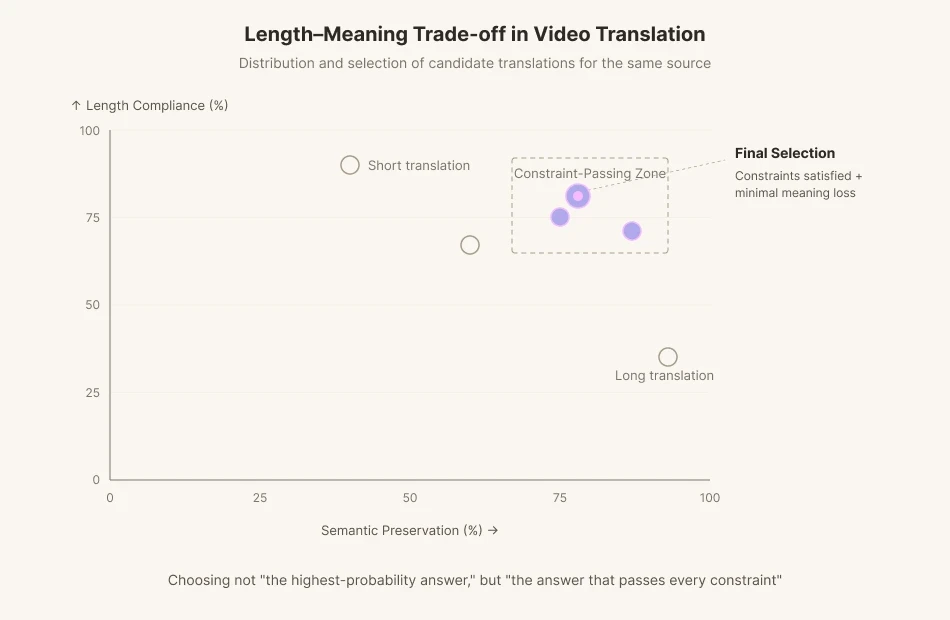

Bestehende maschinelle Übersetzungsmodelle sind auf Metriken zur Bedeutungsbewahrung wie BLEU und COMET optimiert. Sie werden darauf trainiert, die plausibelste Übersetzung so schnell wie möglich zu liefern. Doch bei der Videoübersetzung muss manchmal gerade die plausibelste Variante abgelehnt werden. Wenn die Phoneme nicht ausreichen, muss man auf einen Teil der Bedeutung verzichten und eine andere Formulierung finden. Wir verlangen von KI nicht „die Antwort mit der höchsten Wahrscheinlichkeit“, sondern „die Antwort, die jede Einschränkung besteht“.

Genau das löst die Synchronisationspipeline von Perso AI. Im Übersetzungsschritt erzeugt das System viele Kandidaten, die die Längen- und Phonemvorgaben erfüllen, und wählt dann denjenigen mit dem geringsten Bedeutungsverlust. Es ist die im vorherigen Abschnitt beschriebene Inference-Time-Compute-Idee, übertragen auf den Synchronisationsbereich. Verhindern Sie, dass das Modell die erste Antwort, die ihm in den Sinn kommt, herausplatzt. Lassen Sie es überarbeiten. Lassen Sie es prüfen. Diese iterative Übersetzung ist ein absichtlich auferlegtes Zögern für die Maschine. In einer iterativen Rückkopplungsschleife jagt das Modell dem Optimum zwischen Längeneinhaltung (Isochrony) und Bedeutungsabgleich (Semantic Alignment) hinterher. Es ist die Arbeit, das quälende Abwägen des Videoübersetzers in das Modell selbst zu verpflanzen.

Zum Schluss

Zögern ist nicht bloß Unvollkommenheit, nicht bloß Verlangsamung. Es ist die Ansammlung von Zeit, die man damit verbringt, an andere zu denken. Wenn KI jemals lernt, aus Rücksicht innezuhalten, dann nicht, weil das Modell klüger geworden ist. Es wird daran liegen, dass wir es so gestaltet haben, dass es weniger sicher ist, länger verweilt und zögert.

Wie man KI das Zögern beibringt

Vor ein paar Tagen stieß ich auf einen YouTube-Clip. Der Nachrichtensprecher Sohn Suk-hee interviewte die Romanautorin Kim Ae-ran. Die Frage lautete „Was hat ein Mensch, was KI nicht hat?“, und ihre Antwort war „Zögern.“

Die Schriftstellerin erinnerte an einen Moment aus einer alten Sendung des Moderators. Als er die Nachricht vom Tod des verstorbenen Roh Hoe-chan, eines Gewerkschaftsaktivisten, der Politiker wurde, verlas, rang er zwanzig Sekunden lang um Worte. Der Moment des Zurückhaltens, Schwankens und Abwägens — Zögern. KI ist dazu nicht fähig. Doch das Zögern eines Menschen wird zu Trost und Höflichkeit.

Es war vor etwa zwanzig Jahren, als ich mich gerade auf die Entwicklung eines Shoot-'em-up-Spiels konzentrierte. Ein Teamkollege aus dem Bereich 3D-Charaktermodellierung drückte mir ein Buch in die Hand und sagte: „Ein Freund von mir aus der Oberschule ist Romanautor; das solltest du lesen.“ Tiefe Beobachtungen, gewürzt mit Witz. Ich war völlig gefesselt. Das Buch war Kim Ae-rans Kurzgeschichtensammlung Run, Daddy, Run (달려라 아비). Seitdem bin ich ein Fan von ihr.

Zögern braucht Zeit und geringere Gewissheit

Kim Ae-ran sagte, ihre Schreibmuskeln hätten sich durch sorgfältigste Aufmerksamkeit und Selbstbefragung bei jeder einzelnen Zeile gestärkt. Sie sagte, die Zeit zwischen den Sätzen werde zu Rücksichtnahme auf die anderen. Sie deutete außerdem an, dass der wahre Wert der Literatur nicht im Inhalt, sondern in ihrer Form liege. Wenn also auch die Form zählt, kann KI sie vielleicht zumindest grob nachahmen?

Aus physikalischer Sicht ist Zeit eine Veränderung des physikalischen Zustands. In der Physik ist die Zeit nicht vergangen, wenn sich der Zustand nicht verändert hat. Daher bedeutet weniger Zustandsänderung langsamere Zeit und mehr Veränderung längere Zeit. Eine flüchtige Sekunde für einen Menschen ist für KI eine Ewigkeit, die sich über Hunderte von Milliarden, ja Billionen von Gleitkommaoperationen (FLOPs) erstreckt. Im Vergleich zu früherer Software sind die Antworten heutiger KI das Ergebnis langer, qualvoller Schwerstarbeit. Deshalb kann die KI-Branche beim Umsatz wachsen und zugleich beim Gewinn kämpfen. Aus Sicht klassischer Software ist KI für eine Maschine viel zu langsam. Selbst etwas so Einfaches wie die JSON-Format-Validierung kostet, wenn es durch Inferenz mit großen Sprachmodellen läuft, im Vergleich zu klassischer Software Hunderte Millionen an Rechenaufwand.

Große Sprachmodelle (LLMs), der Motor des jüngsten Fortschritts der KI, sind Programme, die das nächste Wort in einem Satz vorhersagen. KI schickt elektrischen Strom auf die Suche nach dem nächsten Wort. Sie multipliziert und addiert wiederholt gewaltige Matrizen. Die Berechnung der KI erfordert den physischen Verbrauch von Hardware. Um KI mit zumindest einer Form von Zögern, der Zeit menschlicher Qual, zu beladen, setzt man sie intensiver Berechnung aus. Hunderte Milliarden Operationen, um ein einziges nächstes Wort zu erzeugen. Weitere Hunderte Milliarden Operationen folgen, um das Wort danach zu erzeugen.

Die meisten heutigen Deep-Learning-Berechnungen bestehen aus gewichteten Summen, und die vorab berechneten Werte, die in diesen Summen verwendet werden, nennt man Parameter.

Wenn wir vom Modell „Qwen 3.6 27B“ sprechen, bedeutet das, dass 27 Milliarden Parameter für die gewichtete Summierung bereitstehen, was etwa 27 Milliarden Multiplikationen erfordert, um nur ein einziges nächstes Token vorherzusagen. Und das ist erst der Anfang. Außerdem umfasst eine einzelne Ganzzahlmultiplikation Dutzende logischer Operationen, und eine Gleitkommazahl erfordert Tausende. Bei solcher Komplexität darf man das durchaus atemberaubend nennen.

Das Senken der Temperatur schärft die Voreingenommenheit

Werfen wir einen genaueren Blick darauf, wie LLMs funktionieren. Es ist mittlerweile Allgemeinwissen, dass Deep Learning, die Grundlage von LLMs, eine Mustererkennungsmaschine ist, die während des Trainings gelernte Muster auf die reale Anwendung überträgt. Zwei Dinge steuern diesen Prozess des Wiederkäuens: Token-Sampling und Temperatur.

Um ein einziges nächstes Wort vorherzusagen, weist das Modell jedem von zehntausenden Kandidatenwörtern einen Wert (Logit) zu. Diese Werte werden dann in Wahrscheinlichkeiten umgewandelt, und ein Wort wird entsprechend seiner Wahrscheinlichkeit ausgewählt. Dieser Prozess heißt Sampling.

Um dem Sampling mehr Variation zu geben, wurde ein mathematischer Parameter namens „Temperatur“ eingeführt. Senkt man die Temperatur, dehnt sich die Kluft zwischen den Kandidatenwerten bis ins Extreme. Wörter mit hoher Wahrscheinlichkeit werden häufiger ausgewählt als Wörter auf dem Grundniveau. Wörter mit niedriger Wahrscheinlichkeit werden noch seltener gewählt. Das ist ähnlich wie bei den Reichen, die reicher, und den Armen, die ärmer werden. Steigt dagegen die Temperatur, verengt sich die Kluft. Sie wird flacher und gleicht sich aus. Niedrigwahrscheinliche Wörter, die normalerweise übergangen würden, können bei höherer Temperatur häufiger ausgewählt werden.

Die menschliche Sprache ist ähnlich. Die Gruppe und Kultur, zu der ich gehöre, spiegeln sich in der Wahrscheinlichkeitsverteilung meiner Sprache wider. Kältere, schärfere Sprache erzeugt eine Rede, die rationaler, stärker optimiert und stärker auf die Mehrheit ausgerichtet ist. Wärmere, rundere Sprache ist weniger rational und weniger optimiert, berücksichtigt aber die Minderheit.

Rücksichtnahme ist der Akt, zusätzliche Energie aufzuwenden, um die Wahrscheinlichkeitsverteilung der eigenen Gedanken zu verlassen. Es bedeutet, das wahrzunehmen, was die Mehrheit verdeckt, und Sätze zu finden, die normalerweise nicht verwendet werden. Was die Autorin als mühsamen Schreibprozess beschrieb, sollte für KI zu einem Akt werden, Antworten zu verweigern, die allein auf verzerrtem Training beruhen, und sich Mühe zu geben, darüber hinauszugehen.

Mechanisches Grübeln

Wie könnten wir KI beibringen, rücksichtsvoll zu sein? Man kann sie nicht einfach sofort das wahrscheinlichste Wort ausspucken lassen. Das exportiert nur die im Trainingsdatenmaterial verankerten Verzerrungen.

Der Grund, warum heutige KI-Modelle so beeindruckende Ergebnisse erzielen, ist, dass das Feld eine fortgeschrittene Technologie entwickelt hat, die sich auf „Inference-Time Compute“ konzentriert. Es ist eine Technologie, die der KI mehr Rechenzeit gibt, bevor sie antwortet. Frühere KI-Modelle gaben einfach die zuerst berechnete Antwort aus, also die Antwort, die ihnen zuerst in den Sinn kam. Heutige Denkmodelle hingegen erzeugen mehrere Denkpfade.

Sie erzeugen verschiedene Kandidatenantworten und bewerten sie über ihr internes Belohnungsmodell. Dabei wird geprüft, ob die Wörter zum Kontext passen und ob sie zu endgültig wirken; falls nötig werden sie intern verworfen.

Das ähnelt dem, wie Menschen Sätze im Kopf überarbeiten, bevor sie sprechen. Anstatt von KI zu verlangen, auf Grundlage von Wahrscheinlichkeitsverteilungen eine möglichst genaue Antwort zu liefern, werden Rechenressourcen darauf verwendet, ihr Zeit zum Überarbeiten zu geben. Wir lassen sie aus dem Zentrum der Wahrscheinlichkeitsmasse zu den Rändern wandern: eine mechanische Art des Grübelns.

Grübeln in der Videoübersetzung

Eine gewöhnliche Übersetzung ist beendet, sobald der Sinn passt, doch bei der Videoübersetzung müssen nicht nur die Bedeutung stimmen, sondern auch die Länge und das Timing der Lippenbewegungen übereinstimmen.

Wenn ein Schauspieler auf dem Bildschirm 1,8 Sekunden lang den Mund bewegt und 11 englische Silben spricht, muss der Übersetzer eine koreanische Zeile konstruieren, die in diese 1,8 Sekunden passt. Bewahrt man die Bedeutung, bricht die Länge auseinander. Passt man die Länge an, verschwimmt die Bedeutung. Wenn die Schlusskonsonanten und offenen Vokale sich vom Original unterscheiden, spürt der Zuschauer im selben Moment, dass etwas nicht stimmt. Untertitel bringen eine weitere Einschränkung mit sich: eine Lesegeschwindigkeit von 12 bis 15 Zeichen pro Sekunde. Deshalb legt ein Übersetzer, der für Synchronisation arbeitet, fünf Zeilen mit äquivalenter Bedeutung an, zählt Silben, gleicht Betonungen ab und wählt nicht die präziseste Übersetzung, sondern diejenige, die unter den Bedingungen am wenigsten verliert.

Das Übersetzungsteam von Perso AI arbeitet genau an diesem Problem. Das Team veröffentlichte auf der EMNLP einen Beitrag (https://aclanthology.org/2025.emnlp-demos.37), der den Zielkonflikt zwischen Isochrony (Längeneinhaltung) und Semantic Alignment in der Videoübersetzung quantifiziert.

EMNLP (Empirical Methods in Natural Language Processing) ist eine erstklassige Fachkonferenz im Bereich der natürlichen Sprachverarbeitung. Getreu seinem Namen schätzt sie empirische Forschung, die die Wirksamkeit einer Technologie in der Praxis durch Daten und Experimente belegt, statt sich auf rein theoretische Hypothesen zu stützen. Ganz in diesem Sinne nimmt sich die Arbeit des ESTsoft-Forschungsteams eines harten Problems der Videoübersetzung an, quantifiziert es mit Daten und löst es mit einem Algorithmus. Ein praktischer Beitrag für die reale Welt.

Die entscheidende Frage, die die Perso AI-Synchronisationspipeline berücksichtigt, liegt hier. Nicht Zeichen, nicht Silben, sondern das Phonem, die kleinste Einheit der Sprache. Zeichen und Silben sind Einheiten auf dem Bildschirm; Phoneme entsprechen der tatsächlich im Mund verbrachten Zeit. Der im Beitrag vorgeschlagene Algorithmus CountPhonemes zählt die Phonemanzahl des übersetzten Satzes, vergleicht sie mit der Ziel-Phonemanzahl und überarbeitet den Satz, um beide in Einklang zu bringen.

Bestehende maschinelle Übersetzungsmodelle sind auf Metriken zur Bedeutungsbewahrung wie BLEU und COMET optimiert. Sie werden darauf trainiert, die plausibelste Übersetzung so schnell wie möglich zu liefern. Doch bei der Videoübersetzung muss manchmal gerade die plausibelste Variante abgelehnt werden. Wenn die Phoneme nicht ausreichen, muss man auf einen Teil der Bedeutung verzichten und eine andere Formulierung finden. Wir verlangen von KI nicht „die Antwort mit der höchsten Wahrscheinlichkeit“, sondern „die Antwort, die jede Einschränkung besteht“.

Genau das löst die Synchronisationspipeline von Perso AI. Im Übersetzungsschritt erzeugt das System viele Kandidaten, die die Längen- und Phonemvorgaben erfüllen, und wählt dann denjenigen mit dem geringsten Bedeutungsverlust. Es ist die im vorherigen Abschnitt beschriebene Inference-Time-Compute-Idee, übertragen auf den Synchronisationsbereich. Verhindern Sie, dass das Modell die erste Antwort, die ihm in den Sinn kommt, herausplatzt. Lassen Sie es überarbeiten. Lassen Sie es prüfen. Diese iterative Übersetzung ist ein absichtlich auferlegtes Zögern für die Maschine. In einer iterativen Rückkopplungsschleife jagt das Modell dem Optimum zwischen Längeneinhaltung (Isochrony) und Bedeutungsabgleich (Semantic Alignment) hinterher. Es ist die Arbeit, das quälende Abwägen des Videoübersetzers in das Modell selbst zu verpflanzen.

Zum Schluss

Zögern ist nicht bloß Unvollkommenheit, nicht bloß Verlangsamung. Es ist die Ansammlung von Zeit, die man damit verbringt, an andere zu denken. Wenn KI jemals lernt, aus Rücksicht innezuhalten, dann nicht, weil das Modell klüger geworden ist. Es wird daran liegen, dass wir es so gestaltet haben, dass es weniger sicher ist, länger verweilt und zögert.

Weiterlesen

Alle durchsuchen

PRODUKT

ANWENDUNGSFALL

RESSOURCE

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618

PRODUKT

ANWENDUNGSFALL

RESSOURCE

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618

PRODUKT

ANWENDUNGSFALL

RESSOURCE

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618