Funktionen des Video-Transcribers: So erzielen Sie perfektes Timing für besseres Dubbing

Jump to section

Jump to section

Teilen

Teilen

Teilen

AI Video-Übersetzer, Lokalisierung und Synchronisationswerkzeug

Probieren Sie es kostenlos aus

Ihr Team hat gerade eine 20-minütige Produktdemonstration aufgenommen. Sie benötigen Untertitel für Barrierefreiheit, ein sauberes Skript für die Übersetzung und mehrsprachige Versionen für die internationale Veröffentlichung.

Sie exportieren das Transkript. Die Wörter sind größtenteils korrekt. Aber die Zeitstempel sind chaotisch. Einige Zeilen beginnen spät. Andere enden zu früh. Einige Segmente sind zu lang, um bequem gelesen zu werden.

Wenn Sie zum Synchronisieren übergehen, wird alles schwieriger. Die Stimme wirkt gehetzt. Das Tempo klingt unnatürlich. Die Bearbeitung dauert länger als erwartet.

Hier macht sich ein starker Video-Transkriptor bemerkbar.

Ein Video-Transkriptor wandelt Sprache in zeitlich abgestimmten Text um, aber der eigentliche Wert liegt in der sauberen Segmentierung, den genauen Zeitstempeln und den bearbeitbaren Skripten. In diesem Artikel werden wir die wichtigsten Funktionen aufschlüsseln, die das Timing verbessern, und erklären, wie eine bessere Transkription die Workflows für Automatisches Synchronisieren, Videoübersetzung und Videotranslator stärkt.

Video-Transkriptor-Funktionen, die sauberes Timing für das Synchronisieren schaffen

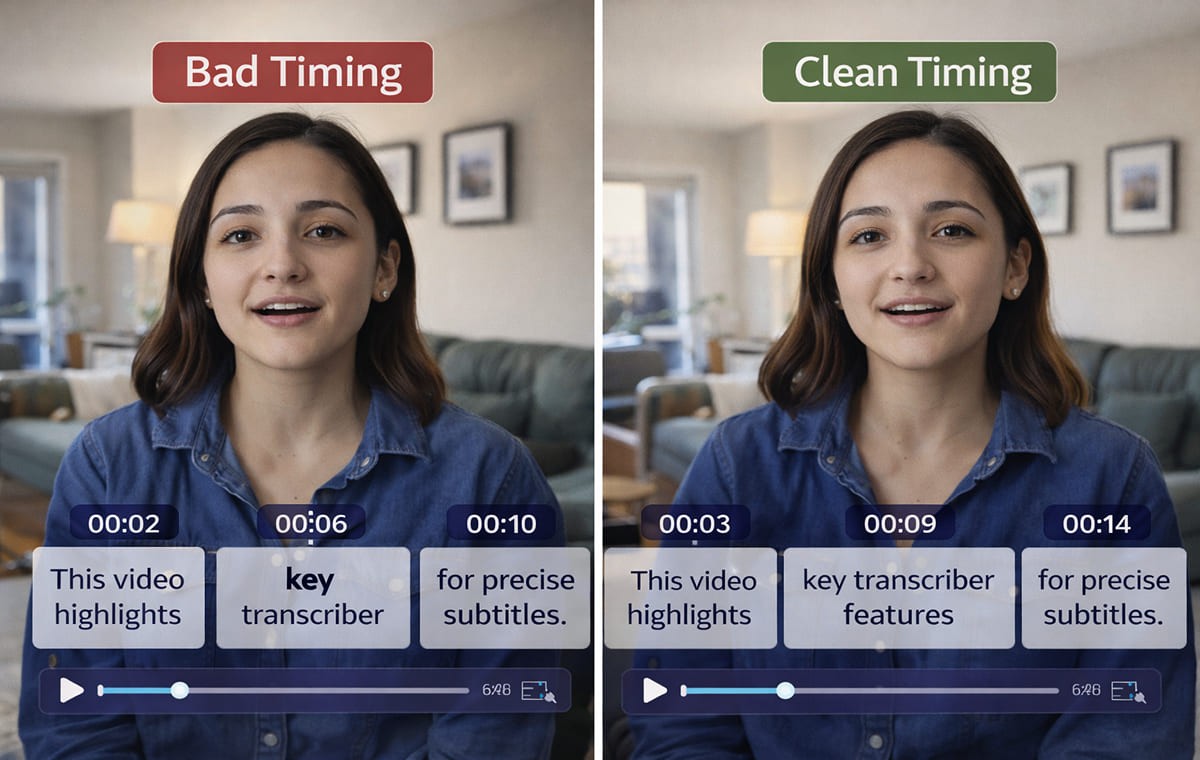

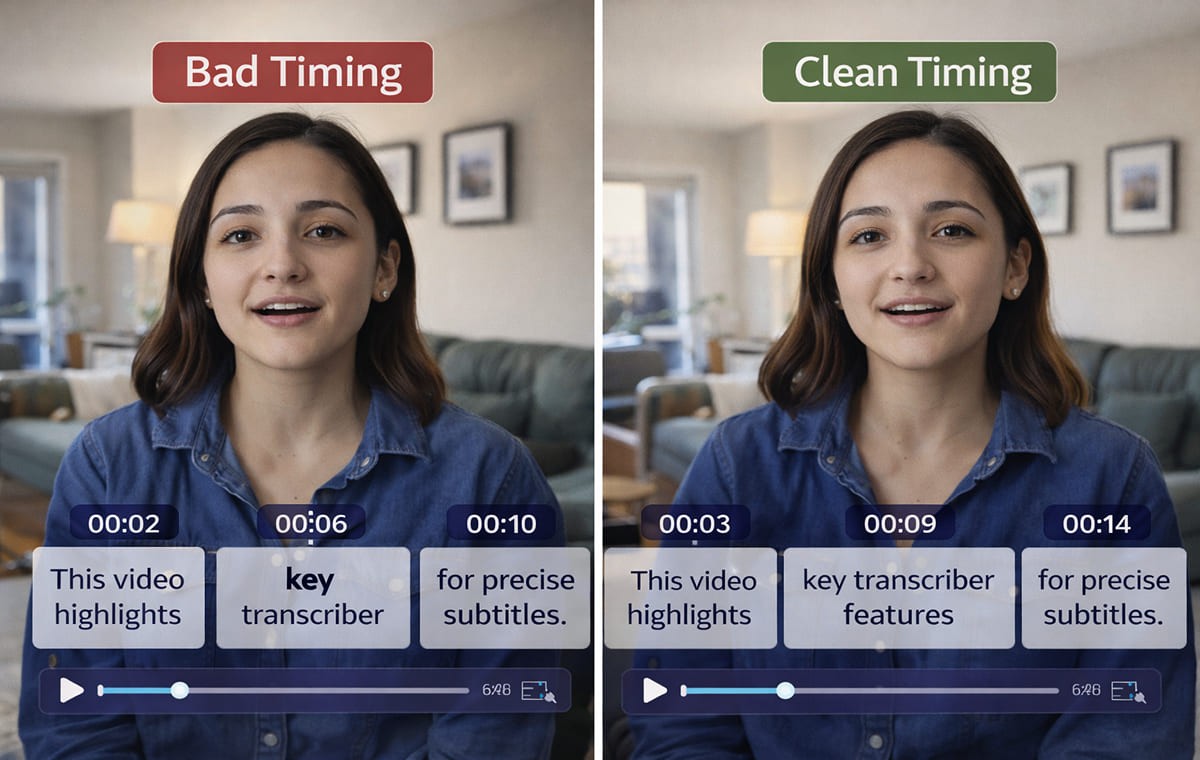

Nicht alle Transkriptoren sind „schlecht“, wenn das Timing nicht stimmt; die meisten Probleme entstehen durch fehlende Steuerungsmöglichkeiten. Ein starker Video-Transkriptor bietet Ihnen Werkzeuge, um das Timing zu bereinigen, bevor Sie jemals ein SRT exportieren.

Hier sind die Funktionen, die den größten Unterschied machen:

Erkennung des Sprechers, die Zeilen stabil hält

Wenn Ihr Video mehr als eine Stimme hat, spielt die Sprecherverwaltung eine Rolle. Wenn ein Transkriptor Sprecher sauber trennt, vermeiden Sie gemischte Zeilen und seltsame Timing-Sprünge, die den Synchronisationsfluss ruinieren.

Für Inhalte mit mehreren Sprechern beginnen Sie mit einem Werkzeug, das speziell für diesen Workflow entwickelt wurde, wie einem AI-Video-Transkriptor, der jedes Wort mit sauberem Timing erfasst.

Smarte Segmentierung, die „Ein riesiges Untertitel“ verhindert

Sauberes Timing hängt teilweise davon ab, wie der Text in Absätze unterteilt wird:

Zeilen sollten bei natürlichen Phrasen brechen

Untertitel sollten nicht zu lang sein.

Segmente sollten nicht zu schnell blitzen, um gelesen zu werden.

Wenn Ihr Output Ihnen riesige Blöcke oder schnell geschossene Fragmente liefert, werden Sie es sofort spüren, wenn Sie versuchen zu synchronisieren.

Bearbeitbare Zeitstempel (Die wirkliche „Timing-Kontrolle“)

Selbst gute Transkriptionen benötigen winzige Timing-Anpassungen:

Ein Segment, das spät beginnt, straffen

Ein Segment, das zu früh endet, verlängern

Eine Zeile teilen, wenn der Satz lang läuft

Hierbei spielt der Editor eine größere Rolle als das rohe Transkript.

Warum sauberes SRT-Timing die Qualität des automatischen Synchronisierens verbessert?

Hier ist die einfache Wahrheit: Synchronisierqualität hängt nicht nur von der Stimme ab. Es geht auch um Timing-Logik.

Wenn Ihre Video-zu-SRT-Datei sauber ist:

Ihr synchronisierter Ton passt sich natürlicher an

Das Tempo fühlt sich näher am ursprünglichen Sprecher an

weniger Zeilen müssen neu geschrieben werden, nur um die Mundbewegungen zu „passen“

Bearbeitungen führen nicht zu Kaskaden in andere Szenen

Darum behandeln Teams, die automatische Videoübersetzung mit Synchronisation und synchronisiertem Output durchführen, die Transkriptionstiming- als Grundlage, nicht als Nachgedanke.

Wie ein Videoübersetzer-Workflow von einem guten Transkript abhängt

Ein Videoübersetzer-Workflow folgt oft einer vorhersehbaren Kette: transkripieren → übersetzen → Stimme generieren → synchronisieren → verfeinern.

Wenn das Transkript chaotisch ist, wird alles, was folgt, schwieriger:

Die Übersetzung wird schwierig, weil Sätze schlecht gebrochen sind

Die Sprachausgabe klingt unnatürlich, weil die Phrasierung falsch ist

Lippensynchronisation wird schwieriger, weil die Zeitfenster nicht dem Sprachrhythmus entsprechen

Wenn Sie einen zuverlässigen Workflow aufbauen, verbinden Sie Ihre Transkriptionsstufe mit einem end-to-end Ansatz wie AI-Videoübersetzer für Synchronisation und mehrsprachige Video-Lokalisierung, damit Ihr Prozess von Skript bis Export konsistent bleibt.

Video-zu-Text-Skript-Setup, das Synchronisationsnacharbeit reduziert

Ein sauberes Video-zu-Text-Skript ist mehr als „präzise Worte“. Es ist auch:

lesbare Sätze

einheitliche Terminologie

Zeilen, die dem natürlichen Sprachrhythmus entsprechen

Wenn Ihr Skript nicht stimmt, werden Sie damit enden, das „Timing zu reparieren“, indem Sie Zeilen neu schreiben, was langsam und riskant ist.

Wenn Sie eine durchsuchbare Skriptausgabe benötigen, die hierfür gebaut ist, ein Video-zu-Text-Skript, das Video in ein bearbeitbares Skript umwandelt, ist die Art von Seite, die Sie in einer Workflow-Checkliste referenzieren würden.

Schnellüberprüfungs-Checkliste für Skriptreinigung

Bevor Sie zum Synchronisieren exportieren:

Produktnamen und Akronyme einmal beheben

Füllwörter entfernen, die das Tempo brechen

abgehackte Fragmente zu natürlichen Phrasen kombinieren

konstante Begriffe im gesamten Video beibehalten

Hier tendieren auch AI-Synchronisation und Voice Cloning-Ergebnisse dazu sich zu verbessern, weil das Modell „sauberere Sprache“ liest.

Untertitel- & Skripteditor-Tools, die Timing ohne Neukonfiguration des gesamten Videos beheben

Die meisten Teams müssen nicht alles neu generieren, wenn ein Abschnitt nicht stimmt. Sie benötigen einen Editor, in dem sie:

Text anpassen

Timing verbessern

Zeilen übersetzen

die Synchronisation stabil halten

Darum ist eine Editor-Schicht ein wesentlicher Bestandteil der Qualitätskontrolle. Perso AI’s Untertitel- & Skripteditor für das Bearbeiten und Synchronisieren von Untertiteln ist um diese Idee herum gebaut, transkripieren und dann in einem Schritt verfeinern.

Wann sollte der Editor statt Neu-Transkription genutzt werden?

Verwenden Sie den Editor, wenn:

nur einige Segmente fehlerhaft getimt sind

Ihr Transkript genau ist, aber die Phrasierung poliert werden muss.

Sie ein besseres Timing für Automatisches Synchronisieren möchten, ohne das gesamte Projekt zu verändern

Ein sauberer Audio-zu-SRT-Prozess, der in realen Projekten funktioniert

Wenn Sie reproduzierbare Ergebnisse möchten, zielen Sie nicht auf „Perfekt im ersten Durchgang“. Zielen Sie auf eine saubere Schleife:

Ihr Quellvideo/-audio hochladen

Das Transkript + initiale Zeitstempel generieren

Lautsprechersplits und Segmentierung überprüfen

Das Skript in einem Editor öffnen und unangenehme Zeilen korrigieren

Audio zu SRT (oder Video zu SRT) für nachgelagerte Verwendung exportieren

Zum Synchronisierungs-/ Videoübersetzungs-Output übergehen

Wenn Ihr Inhalt werbegetrieben ist, passt ein Anwendungsworkflow wie Lokalisierung von Video-Werbung mit AI-Synchronisation für mehrere Märkte zur Realität von engen Fristen und schneller Iteration.

Häufige Timing-Probleme, die Synchronisation ruinieren und wie man sie erkennt

Diese Probleme sind leicht zu übersehen, bis Sie die Synchronisation hören:

Untertitel, die nach dem Beginn des Sprechers starten: Die Synchronisation fühlt sich verspätet an, auch wenn die Wörter korrekt sind.

Zeilen, die zu früh enden: Das Gefühl ist abgeschnitten oder gehetzt, was zu „robotischem“ Tempo führt.

Über-Segmentierung: Zu viele kleine Untertitelblöcke können das Voice-over unnatürlich machen.

Unter-Segmentierung: Ein langer Untertitel kann unnatürliche Geschwindigkeit erzwingen, um in Zeitfenster zu passen.

Wenn Ihr Ziel eine bessere Automatische Videoübersetzung ist, zeigen sich diese Timing-Probleme schnell, weil Übersetzung die Satzlänge erweitert oder komprimiert.

Häufig gestellte Fragen

Welche Video-Transkriptor-Funktionen sind für das Synchronisieren am wichtigsten?

Die praktischsten sind saubere Segmentierung, bearbeitbares Timing und ein Workflow, der Ihnen erlaubt, das Skript zu verfeinern, bevor Sie SRT exportieren, insbesondere wenn Sie Automatisches Synchronisieren verwenden möchten.

Ist das Video zu SRT ausreichend oder benötige ich auch Skriptbearbeitung?

Wenn Ihr Inhalt einfach ist, mag Video zu SRT ausreichend sein. Wenn Sie extern veröffentlichen, verbessert Skriptbearbeitung normalerweise den Fluss, die Terminologie und die Timing-Stabilität, insbesondere für einen Videoübersetzer-Workflow.

Wie beeinflusst die Transkription die Ergebnisse des Voice Cloning?

Sprachmodelle leisten bessere Arbeit, wenn Skripte natürlich gelesen werden. Saubere Interpunktion, stabile Phrasierung und korrekte Terminologie helfen Voice Cloning und Synchronisation weniger „generiert“ zu klingen.

Wer profitiert am meisten von sauberem Transkriptionstiming?

Kreative, Vermarkter und Kurs-/Trainingsteams profitieren am meisten von jedem, der regelmäßig mehrsprachige Inhalte veröffentlicht. Für Kreative, YouTube-Videos für globale Zielgruppen synchronisieren mit AI-Videoübersetzung ist der typische Ausgangspunkt.

Fazit

Ein Video-Transkriptor ist nicht nur ein „Textgenerator“. Es ist die Timing-Grundlage für besseres Synchronisieren, fließendere Automatisches Synchronisieren und zuverlässigere Videoübersetzer-Workflows. Wenn Sie sich auf die Funktionen fokussieren, die Segmentierung, Sprecherverwaltung und Skriptverfeinerung steuern, werden Sie weniger Zeit mit der Reparatur von Untertiteln verbringen und mehr Zeit mit dem Veröffentlichen hochwertiger lokalisierter Videos.

Ihr Team hat gerade eine 20-minütige Produktdemonstration aufgenommen. Sie benötigen Untertitel für Barrierefreiheit, ein sauberes Skript für die Übersetzung und mehrsprachige Versionen für die internationale Veröffentlichung.

Sie exportieren das Transkript. Die Wörter sind größtenteils korrekt. Aber die Zeitstempel sind chaotisch. Einige Zeilen beginnen spät. Andere enden zu früh. Einige Segmente sind zu lang, um bequem gelesen zu werden.

Wenn Sie zum Synchronisieren übergehen, wird alles schwieriger. Die Stimme wirkt gehetzt. Das Tempo klingt unnatürlich. Die Bearbeitung dauert länger als erwartet.

Hier macht sich ein starker Video-Transkriptor bemerkbar.

Ein Video-Transkriptor wandelt Sprache in zeitlich abgestimmten Text um, aber der eigentliche Wert liegt in der sauberen Segmentierung, den genauen Zeitstempeln und den bearbeitbaren Skripten. In diesem Artikel werden wir die wichtigsten Funktionen aufschlüsseln, die das Timing verbessern, und erklären, wie eine bessere Transkription die Workflows für Automatisches Synchronisieren, Videoübersetzung und Videotranslator stärkt.

Video-Transkriptor-Funktionen, die sauberes Timing für das Synchronisieren schaffen

Nicht alle Transkriptoren sind „schlecht“, wenn das Timing nicht stimmt; die meisten Probleme entstehen durch fehlende Steuerungsmöglichkeiten. Ein starker Video-Transkriptor bietet Ihnen Werkzeuge, um das Timing zu bereinigen, bevor Sie jemals ein SRT exportieren.

Hier sind die Funktionen, die den größten Unterschied machen:

Erkennung des Sprechers, die Zeilen stabil hält

Wenn Ihr Video mehr als eine Stimme hat, spielt die Sprecherverwaltung eine Rolle. Wenn ein Transkriptor Sprecher sauber trennt, vermeiden Sie gemischte Zeilen und seltsame Timing-Sprünge, die den Synchronisationsfluss ruinieren.

Für Inhalte mit mehreren Sprechern beginnen Sie mit einem Werkzeug, das speziell für diesen Workflow entwickelt wurde, wie einem AI-Video-Transkriptor, der jedes Wort mit sauberem Timing erfasst.

Smarte Segmentierung, die „Ein riesiges Untertitel“ verhindert

Sauberes Timing hängt teilweise davon ab, wie der Text in Absätze unterteilt wird:

Zeilen sollten bei natürlichen Phrasen brechen

Untertitel sollten nicht zu lang sein.

Segmente sollten nicht zu schnell blitzen, um gelesen zu werden.

Wenn Ihr Output Ihnen riesige Blöcke oder schnell geschossene Fragmente liefert, werden Sie es sofort spüren, wenn Sie versuchen zu synchronisieren.

Bearbeitbare Zeitstempel (Die wirkliche „Timing-Kontrolle“)

Selbst gute Transkriptionen benötigen winzige Timing-Anpassungen:

Ein Segment, das spät beginnt, straffen

Ein Segment, das zu früh endet, verlängern

Eine Zeile teilen, wenn der Satz lang läuft

Hierbei spielt der Editor eine größere Rolle als das rohe Transkript.

Warum sauberes SRT-Timing die Qualität des automatischen Synchronisierens verbessert?

Hier ist die einfache Wahrheit: Synchronisierqualität hängt nicht nur von der Stimme ab. Es geht auch um Timing-Logik.

Wenn Ihre Video-zu-SRT-Datei sauber ist:

Ihr synchronisierter Ton passt sich natürlicher an

Das Tempo fühlt sich näher am ursprünglichen Sprecher an

weniger Zeilen müssen neu geschrieben werden, nur um die Mundbewegungen zu „passen“

Bearbeitungen führen nicht zu Kaskaden in andere Szenen

Darum behandeln Teams, die automatische Videoübersetzung mit Synchronisation und synchronisiertem Output durchführen, die Transkriptionstiming- als Grundlage, nicht als Nachgedanke.

Wie ein Videoübersetzer-Workflow von einem guten Transkript abhängt

Ein Videoübersetzer-Workflow folgt oft einer vorhersehbaren Kette: transkripieren → übersetzen → Stimme generieren → synchronisieren → verfeinern.

Wenn das Transkript chaotisch ist, wird alles, was folgt, schwieriger:

Die Übersetzung wird schwierig, weil Sätze schlecht gebrochen sind

Die Sprachausgabe klingt unnatürlich, weil die Phrasierung falsch ist

Lippensynchronisation wird schwieriger, weil die Zeitfenster nicht dem Sprachrhythmus entsprechen

Wenn Sie einen zuverlässigen Workflow aufbauen, verbinden Sie Ihre Transkriptionsstufe mit einem end-to-end Ansatz wie AI-Videoübersetzer für Synchronisation und mehrsprachige Video-Lokalisierung, damit Ihr Prozess von Skript bis Export konsistent bleibt.

Video-zu-Text-Skript-Setup, das Synchronisationsnacharbeit reduziert

Ein sauberes Video-zu-Text-Skript ist mehr als „präzise Worte“. Es ist auch:

lesbare Sätze

einheitliche Terminologie

Zeilen, die dem natürlichen Sprachrhythmus entsprechen

Wenn Ihr Skript nicht stimmt, werden Sie damit enden, das „Timing zu reparieren“, indem Sie Zeilen neu schreiben, was langsam und riskant ist.

Wenn Sie eine durchsuchbare Skriptausgabe benötigen, die hierfür gebaut ist, ein Video-zu-Text-Skript, das Video in ein bearbeitbares Skript umwandelt, ist die Art von Seite, die Sie in einer Workflow-Checkliste referenzieren würden.

Schnellüberprüfungs-Checkliste für Skriptreinigung

Bevor Sie zum Synchronisieren exportieren:

Produktnamen und Akronyme einmal beheben

Füllwörter entfernen, die das Tempo brechen

abgehackte Fragmente zu natürlichen Phrasen kombinieren

konstante Begriffe im gesamten Video beibehalten

Hier tendieren auch AI-Synchronisation und Voice Cloning-Ergebnisse dazu sich zu verbessern, weil das Modell „sauberere Sprache“ liest.

Untertitel- & Skripteditor-Tools, die Timing ohne Neukonfiguration des gesamten Videos beheben

Die meisten Teams müssen nicht alles neu generieren, wenn ein Abschnitt nicht stimmt. Sie benötigen einen Editor, in dem sie:

Text anpassen

Timing verbessern

Zeilen übersetzen

die Synchronisation stabil halten

Darum ist eine Editor-Schicht ein wesentlicher Bestandteil der Qualitätskontrolle. Perso AI’s Untertitel- & Skripteditor für das Bearbeiten und Synchronisieren von Untertiteln ist um diese Idee herum gebaut, transkripieren und dann in einem Schritt verfeinern.

Wann sollte der Editor statt Neu-Transkription genutzt werden?

Verwenden Sie den Editor, wenn:

nur einige Segmente fehlerhaft getimt sind

Ihr Transkript genau ist, aber die Phrasierung poliert werden muss.

Sie ein besseres Timing für Automatisches Synchronisieren möchten, ohne das gesamte Projekt zu verändern

Ein sauberer Audio-zu-SRT-Prozess, der in realen Projekten funktioniert

Wenn Sie reproduzierbare Ergebnisse möchten, zielen Sie nicht auf „Perfekt im ersten Durchgang“. Zielen Sie auf eine saubere Schleife:

Ihr Quellvideo/-audio hochladen

Das Transkript + initiale Zeitstempel generieren

Lautsprechersplits und Segmentierung überprüfen

Das Skript in einem Editor öffnen und unangenehme Zeilen korrigieren

Audio zu SRT (oder Video zu SRT) für nachgelagerte Verwendung exportieren

Zum Synchronisierungs-/ Videoübersetzungs-Output übergehen

Wenn Ihr Inhalt werbegetrieben ist, passt ein Anwendungsworkflow wie Lokalisierung von Video-Werbung mit AI-Synchronisation für mehrere Märkte zur Realität von engen Fristen und schneller Iteration.

Häufige Timing-Probleme, die Synchronisation ruinieren und wie man sie erkennt

Diese Probleme sind leicht zu übersehen, bis Sie die Synchronisation hören:

Untertitel, die nach dem Beginn des Sprechers starten: Die Synchronisation fühlt sich verspätet an, auch wenn die Wörter korrekt sind.

Zeilen, die zu früh enden: Das Gefühl ist abgeschnitten oder gehetzt, was zu „robotischem“ Tempo führt.

Über-Segmentierung: Zu viele kleine Untertitelblöcke können das Voice-over unnatürlich machen.

Unter-Segmentierung: Ein langer Untertitel kann unnatürliche Geschwindigkeit erzwingen, um in Zeitfenster zu passen.

Wenn Ihr Ziel eine bessere Automatische Videoübersetzung ist, zeigen sich diese Timing-Probleme schnell, weil Übersetzung die Satzlänge erweitert oder komprimiert.

Häufig gestellte Fragen

Welche Video-Transkriptor-Funktionen sind für das Synchronisieren am wichtigsten?

Die praktischsten sind saubere Segmentierung, bearbeitbares Timing und ein Workflow, der Ihnen erlaubt, das Skript zu verfeinern, bevor Sie SRT exportieren, insbesondere wenn Sie Automatisches Synchronisieren verwenden möchten.

Ist das Video zu SRT ausreichend oder benötige ich auch Skriptbearbeitung?

Wenn Ihr Inhalt einfach ist, mag Video zu SRT ausreichend sein. Wenn Sie extern veröffentlichen, verbessert Skriptbearbeitung normalerweise den Fluss, die Terminologie und die Timing-Stabilität, insbesondere für einen Videoübersetzer-Workflow.

Wie beeinflusst die Transkription die Ergebnisse des Voice Cloning?

Sprachmodelle leisten bessere Arbeit, wenn Skripte natürlich gelesen werden. Saubere Interpunktion, stabile Phrasierung und korrekte Terminologie helfen Voice Cloning und Synchronisation weniger „generiert“ zu klingen.

Wer profitiert am meisten von sauberem Transkriptionstiming?

Kreative, Vermarkter und Kurs-/Trainingsteams profitieren am meisten von jedem, der regelmäßig mehrsprachige Inhalte veröffentlicht. Für Kreative, YouTube-Videos für globale Zielgruppen synchronisieren mit AI-Videoübersetzung ist der typische Ausgangspunkt.

Fazit

Ein Video-Transkriptor ist nicht nur ein „Textgenerator“. Es ist die Timing-Grundlage für besseres Synchronisieren, fließendere Automatisches Synchronisieren und zuverlässigere Videoübersetzer-Workflows. Wenn Sie sich auf die Funktionen fokussieren, die Segmentierung, Sprecherverwaltung und Skriptverfeinerung steuern, werden Sie weniger Zeit mit der Reparatur von Untertiteln verbringen und mehr Zeit mit dem Veröffentlichen hochwertiger lokalisierter Videos.

Weiterlesen

Alle durchsuchen

PRODUKT

ANWENDUNGSFALL

RESSOURCE

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618

PRODUKT

ANWENDUNGSFALL

RESSOURCE

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618

PRODUKT

ANWENDUNGSFALL

RESSOURCE

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618