Как научить ИИ колебаться: вычисления во время инференса и искусство вдумчивого перевода

Последнее обновление

Перейти к разделу

Перейти к разделу

Поделиться

Поделиться

Поделиться

Инструмент для перевода видео с помощью AI, локализации и озвучки

Попробуйте бесплатно

Как научить ИИ колебаться

Несколько дней назад я наткнулся на ролик на YouTube. Телеведущий Сон Сок-хи интервьюировал писательницу Ким Эран. Вопрос был: "Что есть у человека такого, чего нет у ИИ?", и её ответ был: "Нерешительность."

Писательница упомянула момент из одной старой передачи ведущего. Во время выпуска новостей о смерти покойного Ро Хе-чана, профсоюзного активиста, ставшего политиком, он на двадцать секунд потерял дар речи. Момент сдерживания слов, колебания и различения — нерешительность. ИИ на такое неспособен. А вот нерешительность человека становится утешением и вежливостью.

Это было около двадцати лет назад, когда я занимался разработкой шутера. Один коллега по 3D-моделированию персонажей дал мне книгу со словами: "Моя приятельница со старшей школы — писательница; тебе стоит это прочитать." Глубокие наблюдения, приправленные остроумием. Я был совершенно поглощён. Это был сборник рассказов Ким Эран Run, Daddy, Run (달려라 아비). С тех пор я остаюсь её поклонником.

Нерешительность требует времени и меньшей определённости

Ким Эран говорила, что её писательские навыки укреплялись благодаря кропотливой выверке и самопроверке каждой строки. Она говорила, что время, проведённое между предложениями, становится проявлением внимания к другим. Она также утверждала, что истинная ценность литературы заключается не в содержании, а в её форме. Тогда, если важна и форма, возможно, ИИ сможет хотя бы приблизительно её имитировать?

С точки зрения физики, время — это изменение физического состояния. В физике время не прошло, если состояние не изменилось. Следовательно, меньшее изменение состояния равно более медленному времени, а большее изменение — более длительному времени. Мимолётная секунда для человека для ИИ — вечность, растянутая на сотни миллиардов и даже триллионы операций с плавающей запятой (FLOPs). По сравнению с прежним ПО, недавние ответы ИИ — результат долгой, мучительной работы. Именно поэтому индустрия ИИ может расти по выручке, испытывая при этом трудности с прибылью. С точки зрения классического ПО ИИ для машины слишком медленен. Даже такая простая вещь, как проверка JSON-формата, если прогонять её через инференс большой языковой модели, стоит сотен миллионов вычислительных операций по сравнению с классическим ПО.

Большие языковые модели (LLM), двигатель недавнего прогресса ИИ, — это программы, которые предсказывают следующее слово в предложении. ИИ прогоняет электрический ток, чтобы найти следующее слово. Он снова и снова умножает и складывает огромные матрицы. Вычисления ИИ требуют физического расхода аппаратного обеспечения. Чтобы наделить ИИ хотя бы подобием нерешительности — человеческого времени мучительного раздумья, — его подвергают интенсивным вычислениям. Сотни миллиардов операций, чтобы получить одно следующее слово. Ещё сотни миллиардов операций следуют за ним, чтобы получить слово после этого.

Большинство современных вычислений глубокого обучения связано с взвешенными суммами, а заранее вычисленные значения, используемые в этих суммах, называются параметрами.

Когда мы говорим о модели "Qwen 3.6 27B", это означает, что есть 27 миллиардов параметров, готовых к взвешенному суммированию, и нужно около 27 миллиардов умножений, чтобы предсказать всего лишь один следующий токен. И это только начало. Более того, одно целочисленное умножение включает десятки логических операций, а операция с плавающей запятой — тысячи. При такой сложности это, пожалуй, можно назвать ошеломляющим.

Снижение температуры усиливает предвзятость

Давайте глубже посмотрим, как работают LLM. Уже стало общим знанием, что глубокое обучение, лежащее в основе LLM, — это машина сопоставления шаблонов, которая применяет запомненные во время обучения шаблоны к реальному использованию. Этим процессом повторения управляют две вещи: выборка токенов и температура.

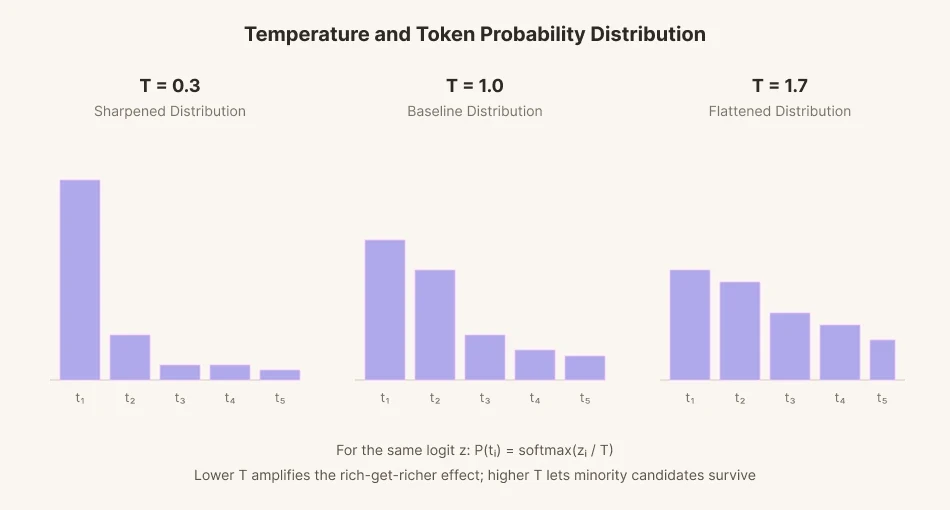

Чтобы предсказать одно следующее слово, модель присваивает оценку (logit) каждой из десятков тысяч возможных слов. Затем эти оценки преобразуются в вероятности, и слово выбирается пропорционально своей вероятности. Этот процесс называется выборкой.

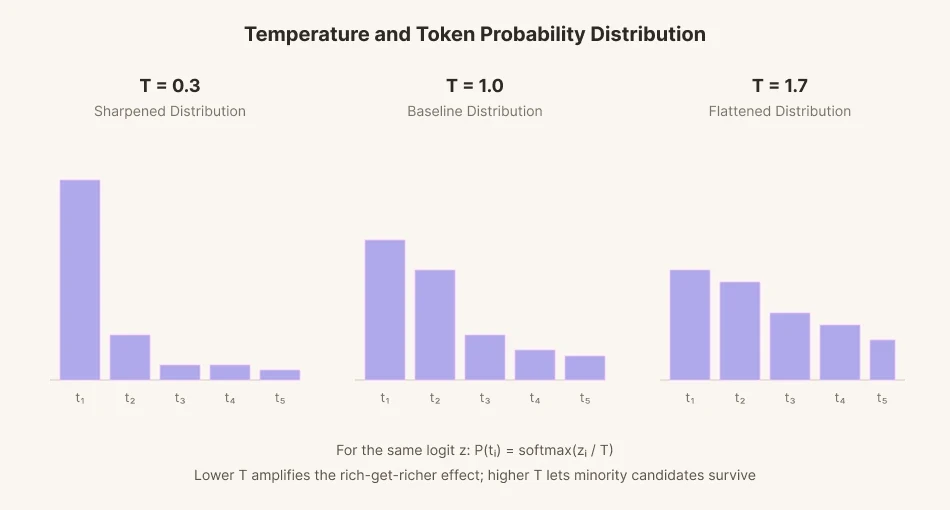

Чтобы добавить вариативности выборке, был введён математический параметр под названием "температура". Чем ниже температура, тем сильнее расходятся оценки кандидатов. Слова с высокой вероятностью выбираются чаще, чем слова на базовом уровне. Слова с низкой вероятностью выбираются ещё реже. Это похоже на то, как богатые становятся богаче, а бедные — беднее. И наоборот, когда температура повышается, разрыв сокращается. Он выравнивается и сглаживается. Слова с низкой вероятностью, которые обычно были бы проигнорированы, при более высокой температуре могут выбираться чаще.

Язык человека похож на это. Группа и культура, к которым я принадлежу, отражаются в вероятностном распределении моего языка. Более холодный и резкий язык рождает речь более рациональную, более оптимизированную и более соответствующую большинству. Более тёплый, округлый язык менее рационален и менее оптимизирован, но учитывает меньшинство.

Внимание к другим — это акт траты дополнительной энергии, чтобы выйти за пределы вероятностного распределения собственных мыслей. Это значит замечать то, что скрывает большинство, и находить предложения, которые обычно не используются. То, что писатель описывал как кропотливый процесс письма, для ИИ должно стать отказом от ответов, основанных лишь на смещённом обучении, и усилием выйти за его пределы.

Механическое беспокойство

Как можно научить ИИ быть внимательным к другим? Нельзя позволять ему сразу выплёвывать слово с наивысшей вероятностью. Это лишь переносит смещения, присущие обучающим данным.

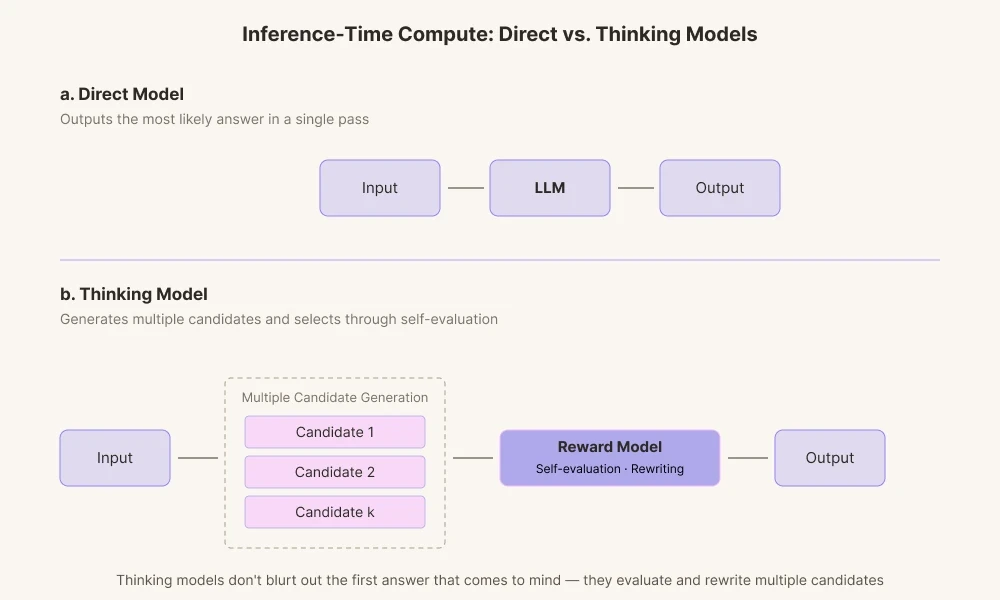

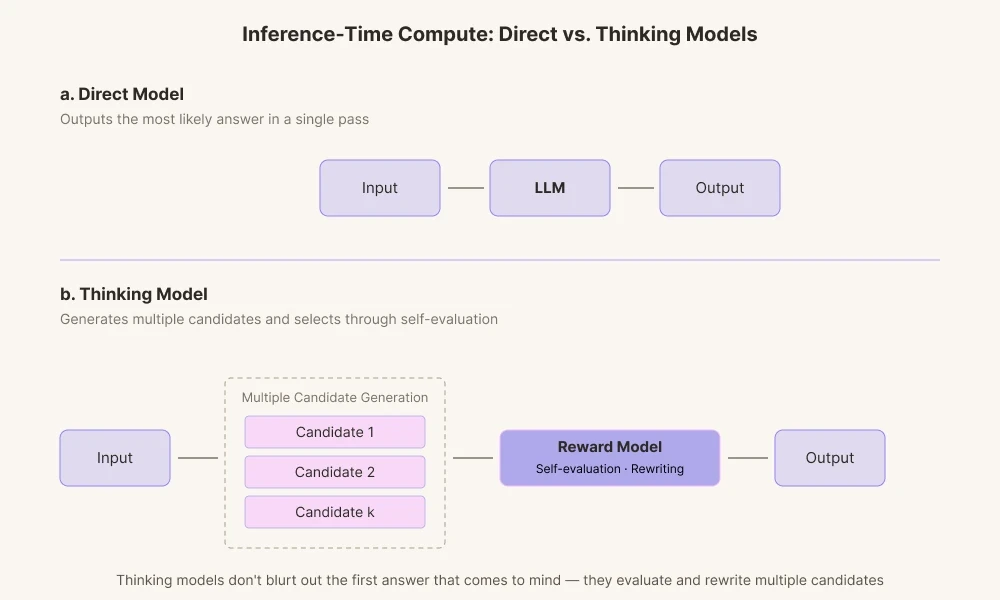

Причина, по которой сегодняшние модели ИИ достигают таких поразительных результатов, в том, что в этой области продвинулась технология, сосредоточенная на "Inference-Time Compute". Это технология, которая даёт ИИ больше времени на вычисления до того, как он ответит. Прошлые модели ИИ просто выдавали первый вычисленный ответ, другими словами — ответ, который первым приходит в голову. Напротив, сегодняшние думающие модели генерируют несколько путей рассуждения.

Они создают различные варианты ответов и оценивают их с помощью собственной модели вознаграждения. Она проходит процесс проверки того, подходят ли слова контексту и не звучат ли они для неё слишком категорично, а затем при необходимости внутренне их отбрасывает.

Это похоже на то, как люди мысленно правят предложения перед тем, как сказать их вслух. Вместо того чтобы требовать от ИИ выдать ответ как можно точнее на основе вероятностных распределений, вычислительные ресурсы тратятся на то, чтобы дать ему время на правку. Мы позволяем ему уйти от центра массы вероятностей к краям: механическая форма беспокойства.

Беспокойство при видеопереводе

Обычный перевод считается завершённым, когда смысл передан, но видеоперевод требует не только точного смысла, — длина и тайминг движения губ тоже должны совпадать.

Если актёр на экране двигает ртом 1,8 секунды и произносит 11 английских слогов, переводчик должен создать корейскую фразу, которая поместится в эти 1,8 секунды. Сохрани смысл — и нарушится длина. Подгони длину — и смысл размывается. Когда финальные согласные и открытые гласные отличаются от оригинала, зритель мгновенно чувствует, что что-то не так. Субтитры накладывают ещё одно ограничение: скорость чтения 12–15 символов в секунду. Поэтому переводчик, работающий с дубляжом, выстраивает пять строк эквивалентного смысла, считает слоги, подбирает ударения и выбирает не самый точный перевод, а тот, который теряет меньше всего в рамках ограничений.

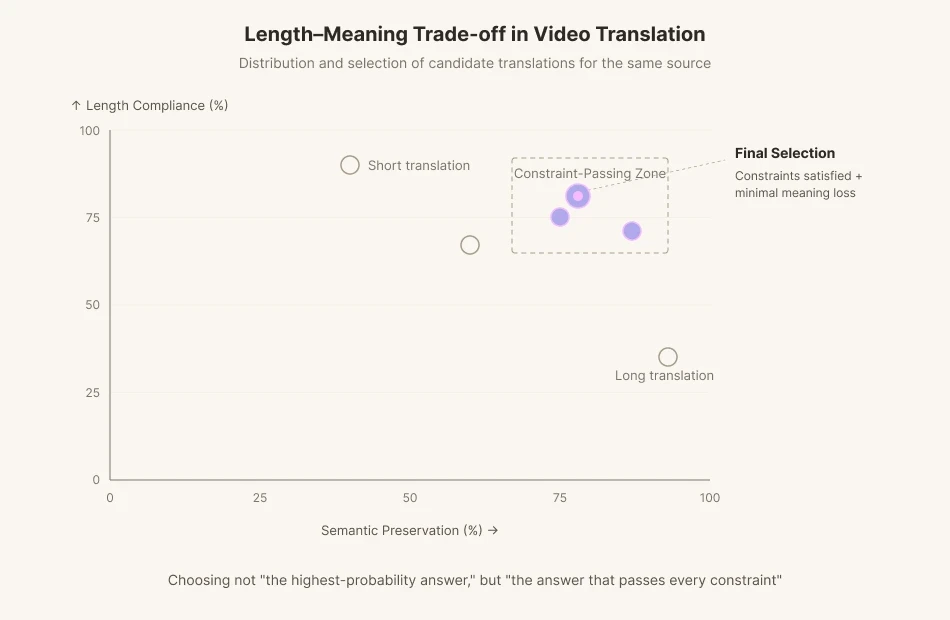

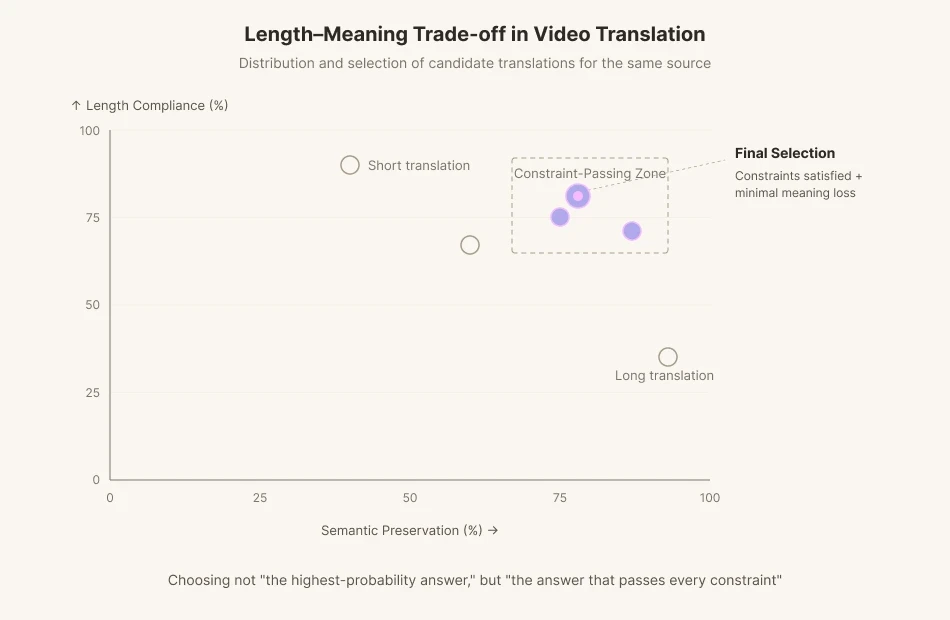

Команда перевода Perso AI работает именно над этой проблемой. Команда опубликовала статью в EMNLP (https://aclanthology.org/2025.emnlp-demos.37), в которой количественно оценивается компромисс между Изохронией (соблюдением длины) и Семантическим соответствием в видеопереводе.

EMNLP (Empirical Methods in Natural Language Processing) — это ведущая площадка в области обработки естественного языка. В соответствии со своим названием, она ценит эмпирические исследования, которые доказывают реальную эффективность технологии на основе данных и экспериментов, а не чисто теоретических гипотез. В духе этого характера статья исследовательской команды ESTsoft берётся за сложную проблему видеоперевода, количественно оценивает её с помощью данных и решает с помощью алгоритма. Практический, реальный вклад.

Ключевой вопрос, который учитывает дублинговый пайплайн Perso AI, заключается именно здесь. Не символы, не слоги, а фонема — наименьшая единица речи. Символы и слоги — это единицы на экране; фонемы соответствуют времени, реально затрачиваемому в рту. Алгоритм, предложенный в статье, CountPhonemes, подсчитывает количество фонем в переведённом предложении, сравнивает его с целевым числом фонем и правит предложение, чтобы привести их в соответствие.

Существующие модели машинного перевода оптимизируются под метрики сохранения смысла, такие как BLEU и COMET. Их учат выдавать наиболее правдоподобный перевод как можно быстрее. Но в видеопереводе иногда приходится отвергать самый правдоподобный вариант. Когда фонем не хватает, приходится жертвовать частью смысла и искать другую формулировку. Мы просим ИИ не о "самом вероятном ответе", а о "ответе, который проходит все ограничения".

Именно это и решает дублинговый пайплайн Perso AI. На этапе перевода система генерирует множество кандидатов, удовлетворяющих ограничениям по длине и фонемам, а затем выбирает тот, где семантические потери минимальны. Это идея inference-time compute из предыдущего раздела, перенесённая в область дубляжа. Не позволяйте модели выпаливать первый пришедший в голову ответ. Заставьте её переписывать. Заставьте её проверять. Этот итеративный перевод — это намеренно навязанная машине нерешительность. Внутри итеративного цикла обратной связи модель ищет оптимум между соблюдением длины (Isochrony) и смысловым соответствием (Semantic Alignment). Это работа по пересадке мучительного процесса видеопереводчика внутрь самой модели.

В заключение

Нерешительность — это не просто несовершенство, не просто замедление. Это накопление времени, потраченного на других. Если ИИ когда-нибудь научится делать паузу ради внимания к другим, это будет не потому, что модель стала умнее. Это будет потому, что мы спроектировали её так, чтобы она была менее уверенной, дольше задерживалась и колебалась.

Как научить ИИ колебаться

Несколько дней назад я наткнулся на ролик на YouTube. Телеведущий Сон Сок-хи интервьюировал писательницу Ким Эран. Вопрос был: "Что есть у человека такого, чего нет у ИИ?", и её ответ был: "Нерешительность."

Писательница упомянула момент из одной старой передачи ведущего. Во время выпуска новостей о смерти покойного Ро Хе-чана, профсоюзного активиста, ставшего политиком, он на двадцать секунд потерял дар речи. Момент сдерживания слов, колебания и различения — нерешительность. ИИ на такое неспособен. А вот нерешительность человека становится утешением и вежливостью.

Это было около двадцати лет назад, когда я занимался разработкой шутера. Один коллега по 3D-моделированию персонажей дал мне книгу со словами: "Моя приятельница со старшей школы — писательница; тебе стоит это прочитать." Глубокие наблюдения, приправленные остроумием. Я был совершенно поглощён. Это был сборник рассказов Ким Эран Run, Daddy, Run (달려라 아비). С тех пор я остаюсь её поклонником.

Нерешительность требует времени и меньшей определённости

Ким Эран говорила, что её писательские навыки укреплялись благодаря кропотливой выверке и самопроверке каждой строки. Она говорила, что время, проведённое между предложениями, становится проявлением внимания к другим. Она также утверждала, что истинная ценность литературы заключается не в содержании, а в её форме. Тогда, если важна и форма, возможно, ИИ сможет хотя бы приблизительно её имитировать?

С точки зрения физики, время — это изменение физического состояния. В физике время не прошло, если состояние не изменилось. Следовательно, меньшее изменение состояния равно более медленному времени, а большее изменение — более длительному времени. Мимолётная секунда для человека для ИИ — вечность, растянутая на сотни миллиардов и даже триллионы операций с плавающей запятой (FLOPs). По сравнению с прежним ПО, недавние ответы ИИ — результат долгой, мучительной работы. Именно поэтому индустрия ИИ может расти по выручке, испытывая при этом трудности с прибылью. С точки зрения классического ПО ИИ для машины слишком медленен. Даже такая простая вещь, как проверка JSON-формата, если прогонять её через инференс большой языковой модели, стоит сотен миллионов вычислительных операций по сравнению с классическим ПО.

Большие языковые модели (LLM), двигатель недавнего прогресса ИИ, — это программы, которые предсказывают следующее слово в предложении. ИИ прогоняет электрический ток, чтобы найти следующее слово. Он снова и снова умножает и складывает огромные матрицы. Вычисления ИИ требуют физического расхода аппаратного обеспечения. Чтобы наделить ИИ хотя бы подобием нерешительности — человеческого времени мучительного раздумья, — его подвергают интенсивным вычислениям. Сотни миллиардов операций, чтобы получить одно следующее слово. Ещё сотни миллиардов операций следуют за ним, чтобы получить слово после этого.

Большинство современных вычислений глубокого обучения связано с взвешенными суммами, а заранее вычисленные значения, используемые в этих суммах, называются параметрами.

Когда мы говорим о модели "Qwen 3.6 27B", это означает, что есть 27 миллиардов параметров, готовых к взвешенному суммированию, и нужно около 27 миллиардов умножений, чтобы предсказать всего лишь один следующий токен. И это только начало. Более того, одно целочисленное умножение включает десятки логических операций, а операция с плавающей запятой — тысячи. При такой сложности это, пожалуй, можно назвать ошеломляющим.

Снижение температуры усиливает предвзятость

Давайте глубже посмотрим, как работают LLM. Уже стало общим знанием, что глубокое обучение, лежащее в основе LLM, — это машина сопоставления шаблонов, которая применяет запомненные во время обучения шаблоны к реальному использованию. Этим процессом повторения управляют две вещи: выборка токенов и температура.

Чтобы предсказать одно следующее слово, модель присваивает оценку (logit) каждой из десятков тысяч возможных слов. Затем эти оценки преобразуются в вероятности, и слово выбирается пропорционально своей вероятности. Этот процесс называется выборкой.

Чтобы добавить вариативности выборке, был введён математический параметр под названием "температура". Чем ниже температура, тем сильнее расходятся оценки кандидатов. Слова с высокой вероятностью выбираются чаще, чем слова на базовом уровне. Слова с низкой вероятностью выбираются ещё реже. Это похоже на то, как богатые становятся богаче, а бедные — беднее. И наоборот, когда температура повышается, разрыв сокращается. Он выравнивается и сглаживается. Слова с низкой вероятностью, которые обычно были бы проигнорированы, при более высокой температуре могут выбираться чаще.

Язык человека похож на это. Группа и культура, к которым я принадлежу, отражаются в вероятностном распределении моего языка. Более холодный и резкий язык рождает речь более рациональную, более оптимизированную и более соответствующую большинству. Более тёплый, округлый язык менее рационален и менее оптимизирован, но учитывает меньшинство.

Внимание к другим — это акт траты дополнительной энергии, чтобы выйти за пределы вероятностного распределения собственных мыслей. Это значит замечать то, что скрывает большинство, и находить предложения, которые обычно не используются. То, что писатель описывал как кропотливый процесс письма, для ИИ должно стать отказом от ответов, основанных лишь на смещённом обучении, и усилием выйти за его пределы.

Механическое беспокойство

Как можно научить ИИ быть внимательным к другим? Нельзя позволять ему сразу выплёвывать слово с наивысшей вероятностью. Это лишь переносит смещения, присущие обучающим данным.

Причина, по которой сегодняшние модели ИИ достигают таких поразительных результатов, в том, что в этой области продвинулась технология, сосредоточенная на "Inference-Time Compute". Это технология, которая даёт ИИ больше времени на вычисления до того, как он ответит. Прошлые модели ИИ просто выдавали первый вычисленный ответ, другими словами — ответ, который первым приходит в голову. Напротив, сегодняшние думающие модели генерируют несколько путей рассуждения.

Они создают различные варианты ответов и оценивают их с помощью собственной модели вознаграждения. Она проходит процесс проверки того, подходят ли слова контексту и не звучат ли они для неё слишком категорично, а затем при необходимости внутренне их отбрасывает.

Это похоже на то, как люди мысленно правят предложения перед тем, как сказать их вслух. Вместо того чтобы требовать от ИИ выдать ответ как можно точнее на основе вероятностных распределений, вычислительные ресурсы тратятся на то, чтобы дать ему время на правку. Мы позволяем ему уйти от центра массы вероятностей к краям: механическая форма беспокойства.

Беспокойство при видеопереводе

Обычный перевод считается завершённым, когда смысл передан, но видеоперевод требует не только точного смысла, — длина и тайминг движения губ тоже должны совпадать.

Если актёр на экране двигает ртом 1,8 секунды и произносит 11 английских слогов, переводчик должен создать корейскую фразу, которая поместится в эти 1,8 секунды. Сохрани смысл — и нарушится длина. Подгони длину — и смысл размывается. Когда финальные согласные и открытые гласные отличаются от оригинала, зритель мгновенно чувствует, что что-то не так. Субтитры накладывают ещё одно ограничение: скорость чтения 12–15 символов в секунду. Поэтому переводчик, работающий с дубляжом, выстраивает пять строк эквивалентного смысла, считает слоги, подбирает ударения и выбирает не самый точный перевод, а тот, который теряет меньше всего в рамках ограничений.

Команда перевода Perso AI работает именно над этой проблемой. Команда опубликовала статью в EMNLP (https://aclanthology.org/2025.emnlp-demos.37), в которой количественно оценивается компромисс между Изохронией (соблюдением длины) и Семантическим соответствием в видеопереводе.

EMNLP (Empirical Methods in Natural Language Processing) — это ведущая площадка в области обработки естественного языка. В соответствии со своим названием, она ценит эмпирические исследования, которые доказывают реальную эффективность технологии на основе данных и экспериментов, а не чисто теоретических гипотез. В духе этого характера статья исследовательской команды ESTsoft берётся за сложную проблему видеоперевода, количественно оценивает её с помощью данных и решает с помощью алгоритма. Практический, реальный вклад.

Ключевой вопрос, который учитывает дублинговый пайплайн Perso AI, заключается именно здесь. Не символы, не слоги, а фонема — наименьшая единица речи. Символы и слоги — это единицы на экране; фонемы соответствуют времени, реально затрачиваемому в рту. Алгоритм, предложенный в статье, CountPhonemes, подсчитывает количество фонем в переведённом предложении, сравнивает его с целевым числом фонем и правит предложение, чтобы привести их в соответствие.

Существующие модели машинного перевода оптимизируются под метрики сохранения смысла, такие как BLEU и COMET. Их учат выдавать наиболее правдоподобный перевод как можно быстрее. Но в видеопереводе иногда приходится отвергать самый правдоподобный вариант. Когда фонем не хватает, приходится жертвовать частью смысла и искать другую формулировку. Мы просим ИИ не о "самом вероятном ответе", а о "ответе, который проходит все ограничения".

Именно это и решает дублинговый пайплайн Perso AI. На этапе перевода система генерирует множество кандидатов, удовлетворяющих ограничениям по длине и фонемам, а затем выбирает тот, где семантические потери минимальны. Это идея inference-time compute из предыдущего раздела, перенесённая в область дубляжа. Не позволяйте модели выпаливать первый пришедший в голову ответ. Заставьте её переписывать. Заставьте её проверять. Этот итеративный перевод — это намеренно навязанная машине нерешительность. Внутри итеративного цикла обратной связи модель ищет оптимум между соблюдением длины (Isochrony) и смысловым соответствием (Semantic Alignment). Это работа по пересадке мучительного процесса видеопереводчика внутрь самой модели.

В заключение

Нерешительность — это не просто несовершенство, не просто замедление. Это накопление времени, потраченного на других. Если ИИ когда-нибудь научится делать паузу ради внимания к другим, это будет не потому, что модель стала умнее. Это будет потому, что мы спроектировали её так, чтобы она была менее уверенной, дольше задерживалась и колебалась.

Продолжить чтение

Просмотреть все

ПРОДУКТ

Случай использования

РЕСУРС

ESTsoft Inc. 15770 Лагуна Каньон Рд #250, Ирвайн, Калифорния 92618

ПРОДУКТ

Случай использования

РЕСУРС

ESTsoft Inc. 15770 Лагуна Каньон Рд #250, Ирвайн, Калифорния 92618

ПРОДУКТ

Случай использования

РЕСУРС

ESTsoft Inc. 15770 Лагуна Каньон Рд #250, Ирвайн, Калифорния 92618