如何教 AI 學會猶豫:推論時運算與審慎翻譯的藝術

人工智能視頻翻譯、定位和配音工具

免費試用

如何教 AI 學會猶豫

幾天前,我偶然看到一段 YouTube 影片。新聞主播孫石熙正在採訪小說家金愛蘭。問題是「人類有而 AI 沒有的是什麼?」她的回答是「猶豫。」

這位小說家提起了主播過去某次播報中的一個瞬間。當他播報已故的盧會燦——這位從勞工運動人士轉而成為政治人物的人——去世的消息時,他有二十秒說不出話來。收住話語、搖擺不定、辨明取捨——這就是猶豫。AI 無法做到這一點。然而,人類的猶豫卻成了安慰與禮貌。

大約二十年前,當時我正專注於開發射擊遊戲。3D 角色建模的一位同事遞給我一本書,說:「我有個高中同學是小說家,你應該讀讀這本。」充滿機智的深刻觀察。我完全沉浸其中。那本書是金愛蘭的短篇小說集 快跑吧,爸爸(달려라 아비)。從那以後我就成了她的粉絲。

猶豫需要時間與較低的不確定性

金愛蘭說,她的寫作肌肉是透過對每一行字都小心翼翼地斟酌並自我質疑而變強的。她說,句與句之間花費的時間,就是對他人的體貼。她也指出,文學的真正價值不在內容,而在形式。那麼,如果形式也重要,AI 或許至少能粗略模仿它?

從物理學的角度來看,時間是物理狀態的變化。在物理學中,如果狀態沒有改變,時間就沒有流逝。因此,狀態變化越少,時間就越慢;變化越多,時間就越長。對人類來說轉瞬即逝的一秒,對 AI 而言,卻是跨越數千億甚至數兆次浮點運算(FLOPs)的漫長永恆。與過去的軟體相比,近年的 AI 回答是長時間、痛苦硬撐的成果。這也是為什麼 AI 產業能在營收成長的同時,卻仍苦於獲利。從傳統軟體的角度看,AI 對機器而言實在太慢了。即使像 JSON 格式驗證這樣簡單的事,透過大型語言模型推理來執行,其計算成本也比傳統軟體高出數億次。

大型語言模型(LLMs)是 AI 近年進展的引擎,是會預測句子中下一個詞的程式。AI 透過電流來尋找下一個詞,反覆對龐大的矩陣做乘加運算。AI 的計算需要硬體的實體消耗。若要讓 AI 至少具備一種猶豫——人類那種煎熬的時間——就得讓它經歷高強度計算。為了產生一個下一個詞,需要數千億次運算;接著再來數千億次,才能產生下一個詞之後的那個詞。

當代深度學習的大多數計算都涉及加權總和,而用於這些總和的預先計算值稱為參數。

當我們談到「Qwen 3.6 27B」模型時,意思是它有 270 億個可供加權求和的參數,僅預測一個下一個 token 就大約需要 270 億次乘法。而這還只是開始。此外,一次整數乘法涉及數十個邏輯運算,而浮點數乘法則需要數千個。如此複雜,稱之為令人瞠目結舌也不為過。

降低溫度會讓偏差更銳利

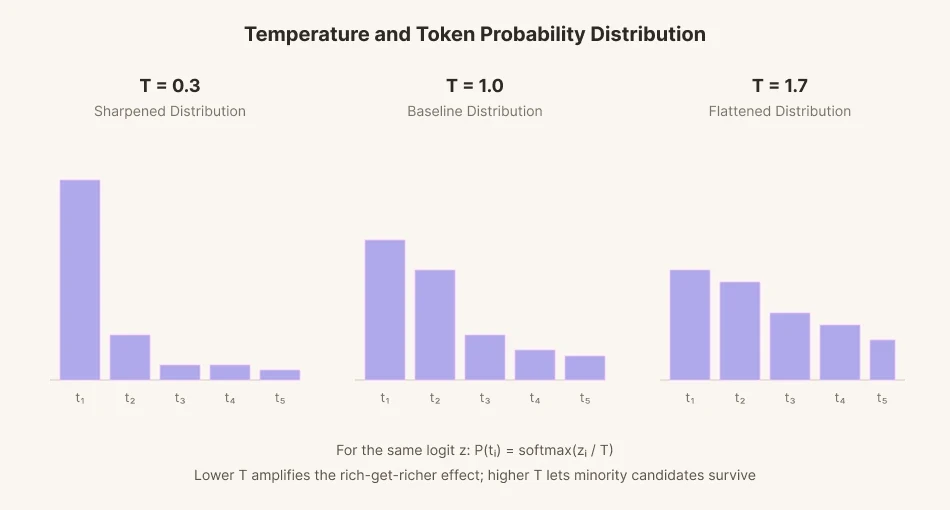

讓我們更深入看看 LLM 的運作方式。如今大家已普遍知道,深度學習——LLM 的基礎——是一台模式配對機器;它會把訓練時記住的模式套用到真實世界的使用情境中。這個重述過程由兩件事所支配:token 抽樣與溫度。

為了預測下一個詞,模型會為數萬個候選詞中的每一個分配一個分數(logit)。這些分數接著被轉換成機率,並依照各自的機率比例選出一個詞。這個過程稱為抽樣。

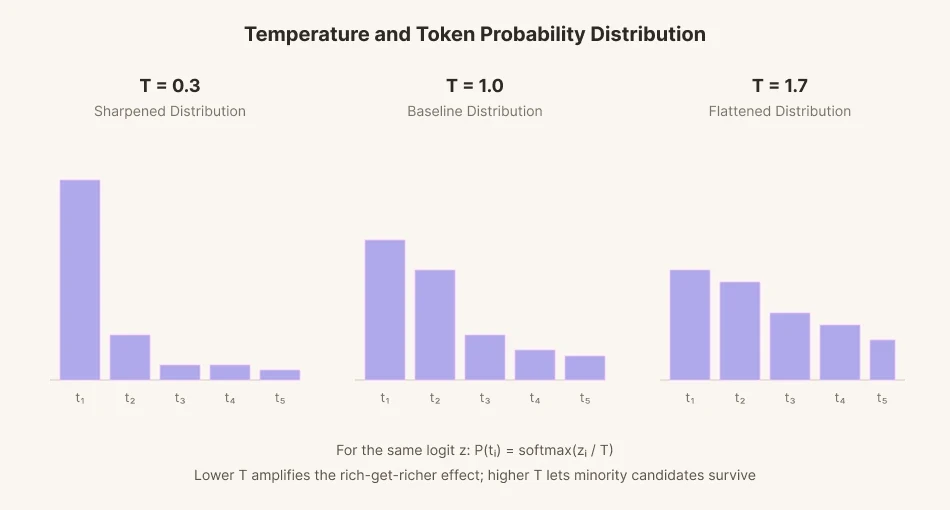

為了讓抽樣更有變化,引入了一個稱為「溫度」的數學參數。溫度越低,候選分數之間的差距就會被拉到極端。高機率的詞更常被選中,低機率的詞則更不容易被選中。這有點像富者越富、貧者越貧。相反地,當溫度升高時,差距就會縮小。落差被壓平並趨於平均。原本會被略過的低機率詞,在溫度升高時反而更有機會被選到。

人類語言也與此相似。我的所屬群體與文化,會反映在我語言的機率分佈之中。更冷、更銳利的語言,產生的是更理性、更最佳化、也更符合多數人的言語。更溫暖、更圓融的語言則沒那麼理性、也沒那麼最佳化,但會把少數人納入考量。

體貼,就是多花一些額外的能量,走出自己思考的機率分佈。它意味著注意到多數人所忽略的事物,並找出平常不會使用的句子。寫作者所描述的那種費工寫作過程,對 AI 來說,應該變成一種拒絕只根據偏見訓練而作答、並努力走得更遠的行為。

機械式猶豫

我們該如何教 AI 變得體貼?不能讓它立刻吐出最高機率的詞。那只會把訓練資料中固有的偏差直接輸出。

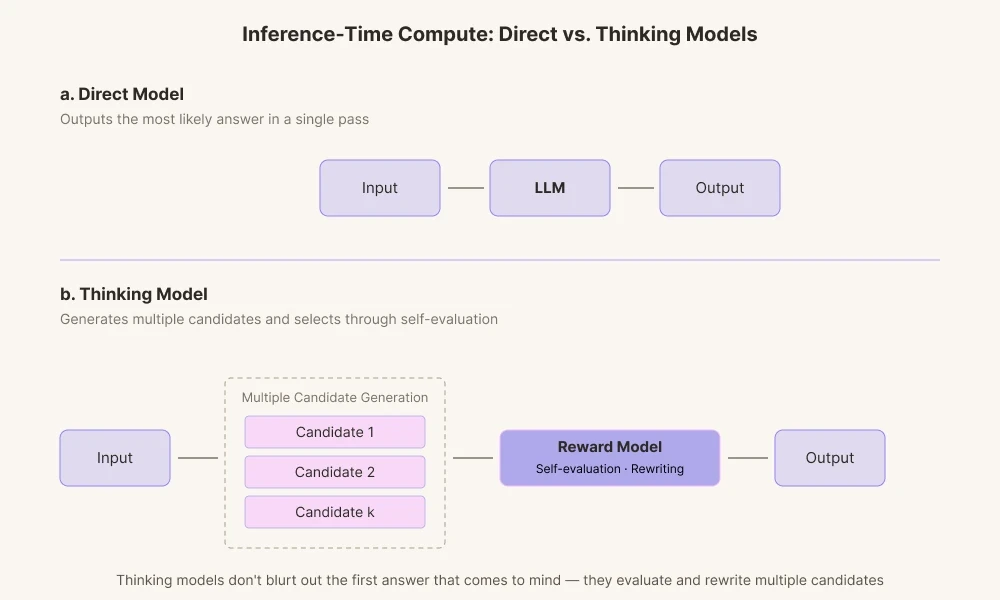

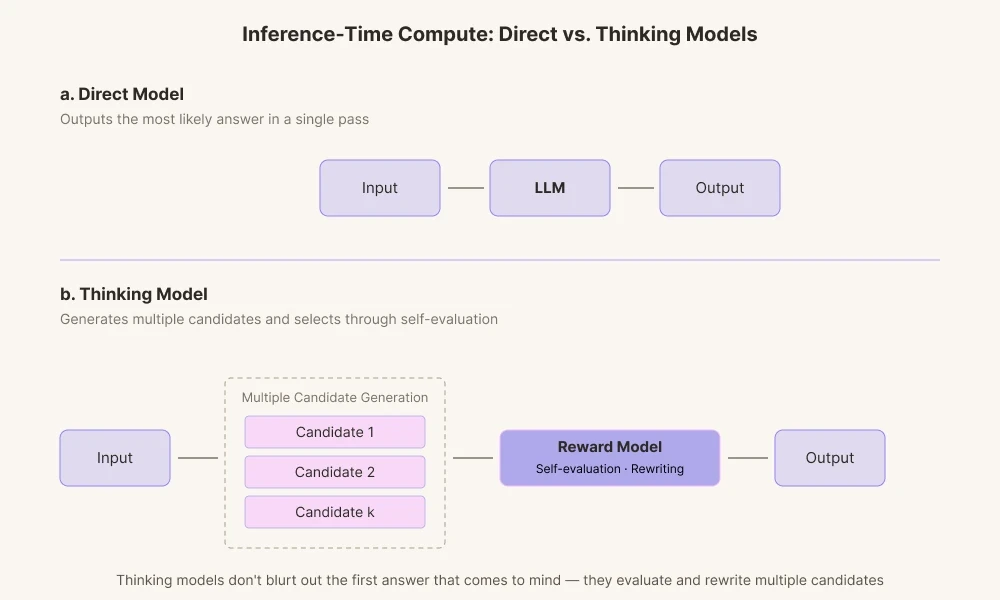

今日 AI 模型之所以能取得如此驚人的成果,是因為這個領域發展出一種聚焦於「推理時運算(Inference-Time Compute)」的技術。這是一種在 AI 回答之前,先給它更多計算時間的技術。過去的 AI 模型只是輸出第一個算出來的答案,換句話說,就是腦海中先浮現的答案。相較之下,如今的思考型模型會生成多條推理路徑。

它們會產生各種候選答案,並透過內建的獎勵模型進行評分。它會檢查這些詞是否符合上下文、是否對它來說顯得過於斷定,然後在需要時於內部將它們捨棄。

這很像人類在說話前,先在腦中修改句子。與其要求 AI 基於機率分佈盡可能準確地直接給出答案,不如花費運算資源給它時間去修訂。我們讓它從機率質量的中心遊走到邊緣:一種機械式的煩惱。

影片翻譯中的猶豫

一般翻譯只要語意對了就算完成,但影片翻譯不僅要意思準確,嘴型動作的長度與節奏也必須對上。

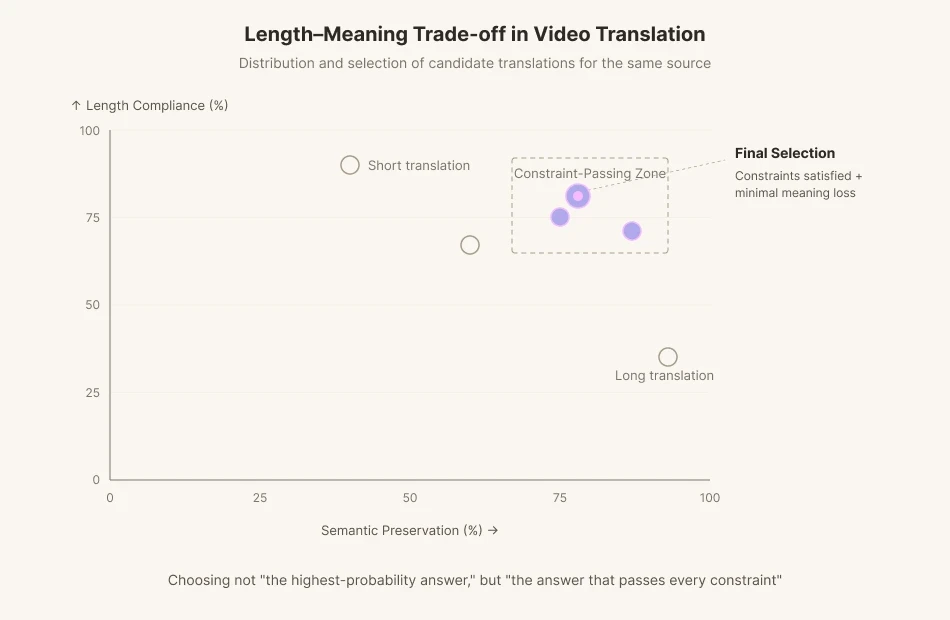

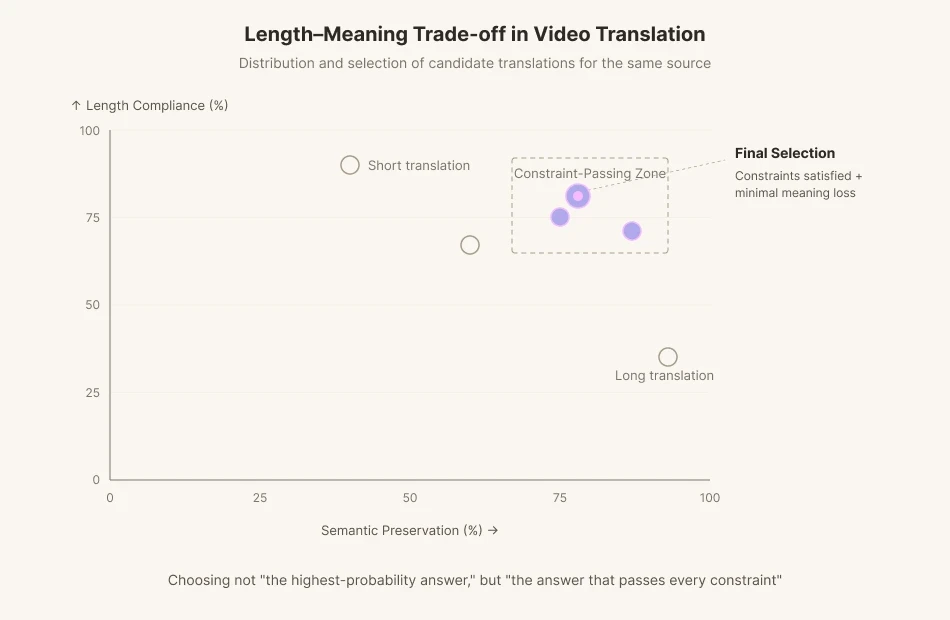

如果螢幕上的演員嘴巴動 1.8 秒,說出 11 個英文音節,譯者就必須做出一行能塞進這 1.8 秒的韓文。保住意思,長度就會被打斷;配合長度,意思又會變得模糊。當結尾子音與開口母音和原文不同時,觀眾在看到的瞬間就會覺得不對勁。字幕又帶來另一個限制:每秒 12 到 15 個字元的閱讀速度。因此,做配音的譯者得先鋪出五種等義的句子,數音節、對重音,最後選的不是最精準的譯法,而是在各種限制下損失最少的那一個。

Perso AI 的翻譯團隊一直在處理的正是這個問題。該團隊在 EMNLP 發表了一篇論文(https://aclanthology.org/2025.emnlp-demos.37),用數據量化了影片翻譯中 Isochrony(長度符合度)與 Semantic Alignment(語意對齊)之間的取捨。

EMNLP(Empirical Methods in Natural Language Processing,自然語言處理實證方法)是自然語言處理領域的頂尖會議。正如其名,它重視透過資料與實驗證明技術在真實世界中的有效性,而不只是純理論假設。也正因如此,ESTsoft 研究團隊的論文正是把影片翻譯中的難題攤開、用數據量化,並以演算法解決。這是一項務實、面向現實世界的貢獻。

Perso AI 的配音流程所考慮的關鍵問題就在這裡。不是字元,不是音節,而是語音的最小單位——音素。字元與音節是螢幕上的單位;音素則對應於口腔中實際花費的時間。論文中提出的演算法 CountPhonemes 會計算譯文的音素數,與目標音素數比較,並修訂句子,使兩者對齊。

現有的機器翻譯模型是以保留語意的指標來最佳化,例如 BLEU 和 COMET。它們的訓練目標是盡快給出最有可能的翻譯。但影片翻譯有時必須拒絕那個最有可能的版本。當音素數不夠時,你就必須捨棄一部分意思,另找一種說法。我們向 AI 要的不是「最高機率的答案」,而是「能通過每一項限制的答案」。

這正是 Perso AI 的配音流程所解決的問題。在翻譯步驟中,系統會生成許多符合長度與音素限制的候選譯文,再選出語意損失最少的一個。這就是前一節所說的 推理時運算(inference-time compute) 概念,轉置到配音領域中。阻止模型脫口而出它腦中先想到的答案。讓它重寫。讓它驗證。這種 迭代式翻譯,就是加諸機器的一種刻意猶豫。在 迭代式回饋迴圈 中,模型追逐的是長度符合度(Isochrony)與語意對齊(Semantic Alignment)之間的最佳平衡。這是把影片翻譯者的煎熬,移植進模型本身的工作。

結語

猶豫不是單純的不完美,也不是單純的變慢。它是為他人著想而累積的時間。如果有一天 AI 學會為了體貼而停頓,那不是因為模型變得更聰明,而是因為我們把它設計得沒那麼確定、停留得更久、學會了猶豫。

如何教 AI 學會猶豫

幾天前,我偶然看到一段 YouTube 影片。新聞主播孫石熙正在採訪小說家金愛蘭。問題是「人類有而 AI 沒有的是什麼?」她的回答是「猶豫。」

這位小說家提起了主播過去某次播報中的一個瞬間。當他播報已故的盧會燦——這位從勞工運動人士轉而成為政治人物的人——去世的消息時,他有二十秒說不出話來。收住話語、搖擺不定、辨明取捨——這就是猶豫。AI 無法做到這一點。然而,人類的猶豫卻成了安慰與禮貌。

大約二十年前,當時我正專注於開發射擊遊戲。3D 角色建模的一位同事遞給我一本書,說:「我有個高中同學是小說家,你應該讀讀這本。」充滿機智的深刻觀察。我完全沉浸其中。那本書是金愛蘭的短篇小說集 快跑吧,爸爸(달려라 아비)。從那以後我就成了她的粉絲。

猶豫需要時間與較低的不確定性

金愛蘭說,她的寫作肌肉是透過對每一行字都小心翼翼地斟酌並自我質疑而變強的。她說,句與句之間花費的時間,就是對他人的體貼。她也指出,文學的真正價值不在內容,而在形式。那麼,如果形式也重要,AI 或許至少能粗略模仿它?

從物理學的角度來看,時間是物理狀態的變化。在物理學中,如果狀態沒有改變,時間就沒有流逝。因此,狀態變化越少,時間就越慢;變化越多,時間就越長。對人類來說轉瞬即逝的一秒,對 AI 而言,卻是跨越數千億甚至數兆次浮點運算(FLOPs)的漫長永恆。與過去的軟體相比,近年的 AI 回答是長時間、痛苦硬撐的成果。這也是為什麼 AI 產業能在營收成長的同時,卻仍苦於獲利。從傳統軟體的角度看,AI 對機器而言實在太慢了。即使像 JSON 格式驗證這樣簡單的事,透過大型語言模型推理來執行,其計算成本也比傳統軟體高出數億次。

大型語言模型(LLMs)是 AI 近年進展的引擎,是會預測句子中下一個詞的程式。AI 透過電流來尋找下一個詞,反覆對龐大的矩陣做乘加運算。AI 的計算需要硬體的實體消耗。若要讓 AI 至少具備一種猶豫——人類那種煎熬的時間——就得讓它經歷高強度計算。為了產生一個下一個詞,需要數千億次運算;接著再來數千億次,才能產生下一個詞之後的那個詞。

當代深度學習的大多數計算都涉及加權總和,而用於這些總和的預先計算值稱為參數。

當我們談到「Qwen 3.6 27B」模型時,意思是它有 270 億個可供加權求和的參數,僅預測一個下一個 token 就大約需要 270 億次乘法。而這還只是開始。此外,一次整數乘法涉及數十個邏輯運算,而浮點數乘法則需要數千個。如此複雜,稱之為令人瞠目結舌也不為過。

降低溫度會讓偏差更銳利

讓我們更深入看看 LLM 的運作方式。如今大家已普遍知道,深度學習——LLM 的基礎——是一台模式配對機器;它會把訓練時記住的模式套用到真實世界的使用情境中。這個重述過程由兩件事所支配:token 抽樣與溫度。

為了預測下一個詞,模型會為數萬個候選詞中的每一個分配一個分數(logit)。這些分數接著被轉換成機率,並依照各自的機率比例選出一個詞。這個過程稱為抽樣。

為了讓抽樣更有變化,引入了一個稱為「溫度」的數學參數。溫度越低,候選分數之間的差距就會被拉到極端。高機率的詞更常被選中,低機率的詞則更不容易被選中。這有點像富者越富、貧者越貧。相反地,當溫度升高時,差距就會縮小。落差被壓平並趨於平均。原本會被略過的低機率詞,在溫度升高時反而更有機會被選到。

人類語言也與此相似。我的所屬群體與文化,會反映在我語言的機率分佈之中。更冷、更銳利的語言,產生的是更理性、更最佳化、也更符合多數人的言語。更溫暖、更圓融的語言則沒那麼理性、也沒那麼最佳化,但會把少數人納入考量。

體貼,就是多花一些額外的能量,走出自己思考的機率分佈。它意味著注意到多數人所忽略的事物,並找出平常不會使用的句子。寫作者所描述的那種費工寫作過程,對 AI 來說,應該變成一種拒絕只根據偏見訓練而作答、並努力走得更遠的行為。

機械式猶豫

我們該如何教 AI 變得體貼?不能讓它立刻吐出最高機率的詞。那只會把訓練資料中固有的偏差直接輸出。

今日 AI 模型之所以能取得如此驚人的成果,是因為這個領域發展出一種聚焦於「推理時運算(Inference-Time Compute)」的技術。這是一種在 AI 回答之前,先給它更多計算時間的技術。過去的 AI 模型只是輸出第一個算出來的答案,換句話說,就是腦海中先浮現的答案。相較之下,如今的思考型模型會生成多條推理路徑。

它們會產生各種候選答案,並透過內建的獎勵模型進行評分。它會檢查這些詞是否符合上下文、是否對它來說顯得過於斷定,然後在需要時於內部將它們捨棄。

這很像人類在說話前,先在腦中修改句子。與其要求 AI 基於機率分佈盡可能準確地直接給出答案,不如花費運算資源給它時間去修訂。我們讓它從機率質量的中心遊走到邊緣:一種機械式的煩惱。

影片翻譯中的猶豫

一般翻譯只要語意對了就算完成,但影片翻譯不僅要意思準確,嘴型動作的長度與節奏也必須對上。

如果螢幕上的演員嘴巴動 1.8 秒,說出 11 個英文音節,譯者就必須做出一行能塞進這 1.8 秒的韓文。保住意思,長度就會被打斷;配合長度,意思又會變得模糊。當結尾子音與開口母音和原文不同時,觀眾在看到的瞬間就會覺得不對勁。字幕又帶來另一個限制:每秒 12 到 15 個字元的閱讀速度。因此,做配音的譯者得先鋪出五種等義的句子,數音節、對重音,最後選的不是最精準的譯法,而是在各種限制下損失最少的那一個。

Perso AI 的翻譯團隊一直在處理的正是這個問題。該團隊在 EMNLP 發表了一篇論文(https://aclanthology.org/2025.emnlp-demos.37),用數據量化了影片翻譯中 Isochrony(長度符合度)與 Semantic Alignment(語意對齊)之間的取捨。

EMNLP(Empirical Methods in Natural Language Processing,自然語言處理實證方法)是自然語言處理領域的頂尖會議。正如其名,它重視透過資料與實驗證明技術在真實世界中的有效性,而不只是純理論假設。也正因如此,ESTsoft 研究團隊的論文正是把影片翻譯中的難題攤開、用數據量化,並以演算法解決。這是一項務實、面向現實世界的貢獻。

Perso AI 的配音流程所考慮的關鍵問題就在這裡。不是字元,不是音節,而是語音的最小單位——音素。字元與音節是螢幕上的單位;音素則對應於口腔中實際花費的時間。論文中提出的演算法 CountPhonemes 會計算譯文的音素數,與目標音素數比較,並修訂句子,使兩者對齊。

現有的機器翻譯模型是以保留語意的指標來最佳化,例如 BLEU 和 COMET。它們的訓練目標是盡快給出最有可能的翻譯。但影片翻譯有時必須拒絕那個最有可能的版本。當音素數不夠時,你就必須捨棄一部分意思,另找一種說法。我們向 AI 要的不是「最高機率的答案」,而是「能通過每一項限制的答案」。

這正是 Perso AI 的配音流程所解決的問題。在翻譯步驟中,系統會生成許多符合長度與音素限制的候選譯文,再選出語意損失最少的一個。這就是前一節所說的 推理時運算(inference-time compute) 概念,轉置到配音領域中。阻止模型脫口而出它腦中先想到的答案。讓它重寫。讓它驗證。這種 迭代式翻譯,就是加諸機器的一種刻意猶豫。在 迭代式回饋迴圈 中,模型追逐的是長度符合度(Isochrony)與語意對齊(Semantic Alignment)之間的最佳平衡。這是把影片翻譯者的煎熬,移植進模型本身的工作。

結語

猶豫不是單純的不完美,也不是單純的變慢。它是為他人著想而累積的時間。如果有一天 AI 學會為了體貼而停頓,那不是因為模型變得更聰明,而是因為我們把它設計得沒那麼確定、停留得更久、學會了猶豫。

繼續閱讀

瀏覽全部

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618