Einblicke & Trends

Der beste KI-Videoübersetzer im Jahr 2026: Untertitel, Voiceover oder KI-Synchronisation?

Zuletzt aktualisiert

Jump to section

Jump to section

Teilen

Teilen

Teilen

AI Video-Übersetzer, Lokalisierung und Synchronisationswerkzeug

Probieren Sie es kostenlos aus

Kurze Antwort

Der beste KI-Videoübersetzer im Jahr 2026 hängt davon ab, welche Ausgabe Sie tatsächlich benötigen — nicht davon, welches Tool die meisten Sprachen hat.

Nur Untertitel: HappyScribe (120+ Sprachen) oder VEED (50+ Sprachen)

Voiceover ohne Lippensynchronisation: ElevenLabs Dubbing (32 Sprachen, beste Sprachqualität)

KI-Synchronisation mit Voice Cloning und Lippensynchronisation: Perso AI (33+ Sprachen, ab 6,99 $/Monat)

Wenn Ihr Video eine echte Person vor der Kamera zeigt — eine Produktdemo, ein Tutorial oder ein Creator-Video — schließen Untertitel die Vertrauenslücke nicht. Genau hier wird die Wahl der Übersetzungsart zur eigentlichen Entscheidung.

Die meisten Teams, die nach einem KI-Videoübersetzer suchen, machen denselben Fehler: Sie wählen nach Sprachanzahl oder Preis, testen mit einem kurzen Clip, erklären es für gut genug und veröffentlichen. Drei Monate später hat die spanische Version eine geringere Wiedergabezeit als das englische Original.

Das Problem kommt fast nie von der Übersetzung selbst. Es entsteht durch die Wahl des falschen Tool-Typs für den Inhalt.

KI-Videoübersetzung ist kein einzelnes Produkt. Es sind drei grundlegend unterschiedliche Workflows — Untertitel, Voiceover und KI-Synchronisation mit Lippensynchronisation — und der Unterschied zwischen ihnen entscheidet, ob Ihre lokalisierten Inhalte tatsächlich funktionieren. Dieser Leitfaden zeigt, welcher Ausgabetyp zu welchem Inhalt passt und welche Tools in jeder Kategorie liefern.

Wie wir diese Tools bewertet haben

Wir haben sieben Tools in drei Inhaltsszenarien getestet, die die häufigsten realen Anwendungsfälle für Videoübersetzung abbilden:

Szenario A: Eine 2-minütige Produktdemo mit einem einzelnen Presenter vor der Kamera

Szenario B: Ein 4-minütiges Tutorial mit Folienübergängen und Bildschirmaufnahme

Szenario C: Eine 60-sekündige Social-Ad mit schnellen Schnitten und ohne sichtbaren Sprecher

Zielsprachen: Englisch, Spanisch, Japanisch, Deutsch und Portugiesisch.

Wir haben jedes Tool in vier Dimensionen bewertet:

Dimension | Gewichtung | Was wir gemessen haben |

|---|---|---|

Passung des Ausgabetyps | 30% | Entspricht das Tool den tatsächlichen Anforderungen des Inhalts? |

Genauigkeit der Lippensynchronisation | 30% | Ausrichtung der Mundbewegungen bei Talking-Head-Material |

Übersetzungsqualität | 25% | Terminologiegenauigkeit, natürliche Formulierungen in der Zielsprache |

Workflow-Effizienz | 15% | Schritte zwischen Upload und fertiger, veröffentlichungsreifer Ausgabe |

Wir haben Tools ausgeschlossen, die nur über Enterprise-Zugänge verfügbar sind, sowie reine Audio-Tools ohne Videoausgabe.

Die drei Arten der KI-Videoübersetzung

Bevor Sie Tools vergleichen, müssen Sie wissen, welcher Ausgabetyp zu Ihrem Inhalt passt. Die meisten Vergleichsleitfäden überspringen diesen Schritt. Dabei ist er der wichtigste.

Typ 1: Untertitelübersetzung

Die KI transkribiert das Originalaudio, übersetzt den Text und erzeugt eine Untertitelspur. Das Originalaudio bleibt unberührt. Zuschauer lesen die Übersetzung, während sie den Originalsprecher hören.

Am besten geeignet für: Social Clips, Kurzform-Inhalte, interne Videos, alle Inhalte, bei denen die Glaubwürdigkeit des Sprechers nicht der primäre Treiber für Zuschauervertrauen ist.

Einschränkung: Bei Videos, in denen eine echte Person vor der Kamera spricht — Produktdemos, Kurse, Kommunikation von Führungskräften — erzeugen Untertitel eine wahrgenommene Distanz. Laut einer Studie von Verizon Media und Publicis Media aus dem Jahr 2019 sehen sich 80% der Verbraucher eher ein vollständiges Video an, wenn Untertitel verfügbar sind, und 69% sehen Videos an öffentlichen Orten ohne Ton. Jüngst berichtete YouTube im Jahr 2025, dass Creator, die synchronisierte Audiospuren hinzugefügt haben, 25%+ ihrer Wiedergabezeit in nicht-primäre Sprachzielgruppen verlagerten. Untertitel helfen — synchronisierte Audiospuren mit Voice Cloning schließen die Lücke noch weiter.

Typ 2: Voiceover (Audio-Synchronisation ohne Lippensynchronisation)

Die KI erzeugt eine neue Audiospur in der Zielsprache, die das Original ersetzt oder darübergelegt wird. Das Video selbst bleibt unverändert — die Mundbewegungen des Sprechers entsprechen weiterhin der Originalsprache.

Am besten geeignet für: erzählungslastige Inhalte, Podcasts, Erkläranimationen, folienbasierte Präsentationen, bei denen der Sprecher nicht im visuellen Fokus steht.

Einschränkung: Bei Talking-Head-Material ist die Diskrepanz zwischen Lippenbewegung und Audio sofort sichtbar. Zuschauer spüren sie, auch wenn sie sie nicht benennen können. Bei Produktdemos und Tutorials, bei denen die Autorität des Presenters Vertrauen aufbaut, entsteht so eine Glaubwürdigkeitslücke, die schwer zu schließen ist.

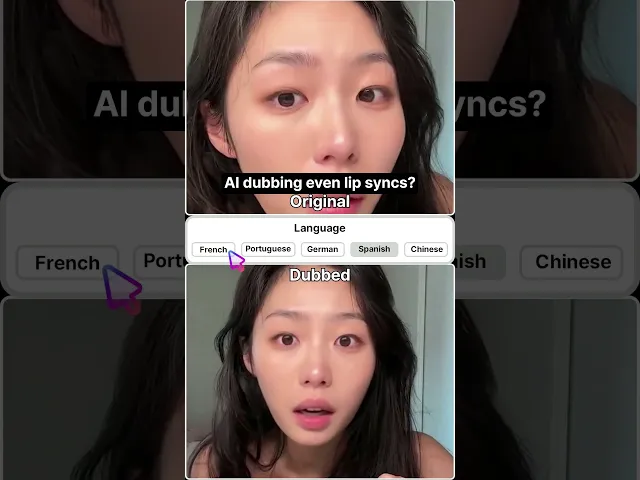

Typ 3: KI-Synchronisation mit Voice Cloning und Lippensynchronisation

Die KI übersetzt das Skript, erzeugt eine per Voice Cloning erzeugte Audiospur, die Tonfall und Tempo des Originalsprechers bewahrt, und verändert die Lippenbewegungen des Sprechers passend zum neuen Audio. Der Zuschauer sieht und hört dieselbe Person in seiner Sprache sprechen.

Perso AI ist eine KI-Synchronisationsplattform, die Übersetzung, Voice Cloning in 33+ Sprachen, Lippensynchronisation und Inline-Skriptbearbeitung in einem einzigen Workflow kombiniert — speziell entwickelt für Produktdemos, Tutorials und Creator-Inhalte, bei denen die Glaubwürdigkeit des Sprechers Teil der Botschaft ist.

Am besten geeignet für: Produktdemos, Tutorials, Creator-Inhalte, Marketingkampagnen, Trainingsvideos — alle Inhalte, bei denen die Präsenz des Sprechers Teil des Werts ist.

So sieht KI-Synchronisation mit Lippensynchronisation in der Praxis aus — der Workflow von Perso AI vom Upload bis zur fertigen Ausgabe:

Die Entscheidungsregel: Wenn eine echte Person vor der Kamera ist und ihre Glaubwürdigkeit für den Zuschauer wichtig ist, benötigen Sie Typ 3. Alles andere ist ein Workaround.

Was die Tests gezeigt haben: Ergebnisse nach Inhaltstyp

Szenario A — Produktdemo (Presenter vor der Kamera)

Dies ist das Szenario, in dem die Tool-Auswahl den größten sichtbaren Unterschied macht. Der Presenter ist im Vollbild und spricht direkt in die Kamera.

Perso AI war der klare Sieger. Über 5 Sprachpaare hinweg blieb die Lippensynchronisation zwischen Audio-Peaks und Mundbewegungen über das gesamte Video hinweg konstant. Die Übersetzungsgenauigkeit war bei produktspezifischer Terminologie stark — Funktionsnamen, UI-Labels und Workflow-Beschreibungen. Der Inline-Skripteditor machte es einfach, eine holprige Übersetzungsphrase zu korrigieren, ohne das Projekt neu zu starten.

HeyGen liefert starke Ergebnisse für avatarbasierten Inhalt und ist eine solide Wahl für Teams, die neue präsentergeführte Videos aus einem Skript erzeugen. Für die Synchronisation vorhandenen Materials mit realen Personen ist seine Lippensynchronisation eher für eigene Avatar-Formate als für reales Videomaterial optimiert.

ElevenLabs Dubbing setzt den Maßstab für Sprachqualität — natürlich, ausdrucksstark und in 32 Sprachen nah an menschlicher Sprache. Es gibt nur Audio aus, ohne Videoverarbeitung oder Lippensynchronisation, und eignet sich daher am besten für erzählungslastige Inhalte oder Workflows, bei denen ein separater Videoeditor die Endmontage übernimmt.

Szenario B — Tutorial mit Folienübergängen

Bildschirmaufnahmen mit gelegentlichen Schnitten zum Presenter stellen einen gemischten Inhaltstyp dar. Lippensynchronisation ist für Presenter-Segmente wichtig; Übersetzungsqualität und Glossarkontrolle sind durchgehend wichtig.

Perso AI handhabte die Sprechererkennung über Segmentschnitte hinweg sauber. Wenn das Video zwischen Bildschirmaufnahme und Presenter vor der Kamera wechselte, blieb die Konsistenz des Sprachprofils in allen fünf getesteten Sprachen erhalten. Die Glossarfunktion fixierte Markenterminologie über das gesamte Video hinweg — kein einziger Fall, in dem Produktnamen in generische Übersetzungen abdrifteten.

Maestra schnitt bei Untertiteln und Skriptebene gut ab. Die Abdeckung von 125+ Sprachen ist breit, und der skriptbearbeitungsorientierte Workflow passt zu Teams, die exakte Formulierungen festlegen wollen, bevor Audio erzeugt wird. KI-Synchronisation mit Lippensynchronisation ist als Exportoption verfügbar.

VEED verarbeitete Untertitel für Bildschirmaufnahme-Abschnitte gut und ist eine starke Wahl für untertitelfokussierte Workflows. Das synchronisierte Audio funktioniert am besten bei kürzeren Inhalten.

Szenario C — Social-Ad (Schnelle Schnitte, kein sichtbarer Sprecher)

Bei Kurzform-Inhalten ohne Sprecher vor der Kamera ist Lippensynchronisation irrelevant. Übersetzungsgeschwindigkeit und Untertitelgenauigkeit sind entscheidend.

VEED war das schnellste Tool für untertitelorientierte Workflows — Untertitelgenerierung in 50+ Sprachen, sauberer Workflow, exportfertige SRT ohne manuelle Schritte. Sehr passend für Social-Media-Inhalte in großem Umfang.

HappyScribe lieferte hier die genaueste Transkription. Sein hybrides KI- + optionales Human-Review-Modell verschafft ihm einen Vorteil bei Audio mit Hintergrundmusik oder schnellem Sprechen. Die Untertitelunterstützung in 120+ Sprachen deckt jede Marktkombination ab.

Direkter Vergleich: Was jedes Tool tatsächlich liefert

Tool | Untertitel | Voiceover | Voice Cloning | Lippensynchronisation (reales Material) | Sprachen | Einstiegspreis |

|---|---|---|---|---|---|---|

Perso AI | ✅ | ✅ | ✅ | ✅ Klassenbeste Leistung | 33+ | 6,99 $/Monat |

VEED | ✅ | Begrenzt | ❌ | ❌ | 50+ | 18 $/Monat |

HappyScribe | ✅ | ❌ | ❌ | ❌ | 120+ | 17 $/Monat |

Maestra | ✅ | ✅ | ✅ | ✅ (Exportoption) | 125+ | 49 $/Monat |

ElevenLabs | ❌ (nur Audio) | ✅ | ✅ Klassenbeste Leistung | ❌ | 32 | 22 $/Monat |

HeyGen | ✅ | ✅ | ✅ | ✅ (nur Avatare) | 40+ | 29 $/Monat |

Murf AI | ❌ | ✅ | Begrenzt | ❌ | 20+ | 29 $/Monat |

Hinweis zur Preisgestaltung: Alle Preise entsprechen der monatlichen Abrechnung mit Stand April 2026. Die Lippensynchronisation von Perso AI ist eine optionale Funktion pro Projekt — bei Aktivierung fallen zusätzliche GPU-Credits an. Die Voiceover-Preise von Maestra beginnen bei 49 $/Monat (Basic, 120 Min., kein Voice Cloning); Voice Cloning erfordert den Premium-Plan für 99 $/Monat; der Business-Plan kostet 199 $/Monat.

Der Preis-Realitätscheck: Der Starter-Plan von Perso AI für 6,99 $/Monat enthält Voice Cloning, Multi-Speaker-Unterstützung, KI-Lippensynchronisation und 1080p-Ausgabe ohne Wasserzeichen. HeyGen (29 $/Monat) berechnet zusätzliche Premium Credits für lippensynchronisierte Übersetzung bei realem Material. ElevenLabs (Creator, 22 $/Monat) gibt nur Audio aus — kein Video, keine Lippensynchronisation. Bei Maestra ist für Lippensynchronisation der Business-Plan für 199 $/Monat erforderlich. Für Teams, die KI-Synchronisation mit Lippensynchronisation benötigen, liefert Perso AI die vollständigste Ausgabe zum niedrigsten Einstiegspreis.

Gaga D. (AI Product Owner, Health, Wellness and Fitness) bringt es auf G2 auf den Punkt: „Ich mag die KI-Synchronisationsfunktion wirklich — die Stimme klingt natürlich und passt sehr gut zum Originalsprecher.“ — Von G2 verifizierte Bewertung, Feb 2026

Jetzt kostenlos ausprobieren →

So ordnen Sie Ihren Inhalt dem richtigen Tool zu

Wenn Ihr Video hauptsächlich aus Bildschirmaufnahme, Animation oder Folien besteht: Untertitel-Tools (VEED, HappyScribe) oder Voiceover-Tools (ElevenLabs, Murf AI) sind ausreichend. Der Sprecher steht nicht im visuellen Fokus, daher beeinflusst Lippensynchronisation die Ausgabequalität nicht.

Wenn Ihr Video eine echte Person vor der Kamera zeigt, die spricht: Der Ausgabetyp ist wichtiger als das Tool. Untertitel und Voiceover geben Zuschauern Zugang zum Inhalt — aber bei Produktdemos und Tutorials, bei denen die Präsenz des Presenters Teil des Erlebnisses ist, schafft KI-Synchronisation mit Lippensynchronisation eine natürlichere Verbindung zum Publikum.

Wenn Sie in großem Umfang produzieren — mehrere Videos, mehrere Sprachen, wiederholte Kampagnen: Workflow-Integration wird ebenso wichtig wie Ausgabequalität. Die KI-Synchronisation von Perso AI verbindet Übersetzung, Voice Cloning und Lippensynchronisation in einer automatisierten Pipeline. Ein Upload. Sprachen wählen. Exportieren. Keine manuellen Zwischenschritte.

Was die Qualität der Übersetzungsausgabe tatsächlich vorhersagt

Der Unterschied zwischen Tools bei der reinen Übersetzungsgenauigkeit ist kleiner, als die meisten Teams erwarten — und selten der Punkt, an dem lokalisierte Inhalte in der Praxis scheitern.

Was häufiger scheitert:

Terminologie-Drift. Generische KI-Modelle haben Schwierigkeiten mit produktspezifischem Vokabular — Funktionsnamen, UI-Labels, Markenbegriffe. Ein übersetztes Skript, das grammatikalisch korrekt ist, aber den falschen Produktbegriff verwendet, stiftet mehr Verwirrung als eine leicht holprige Formulierung. Tools mit benutzerdefinierter Glossarunterstützung ermöglichen es Teams, Terminologie festzulegen, bevor sie die Audioebene erreicht.

Timing-Drift. Übersetztes Audio, das länger oder kürzer als das Original läuft, erzeugt Synchronisationsprobleme, die sich über ein Video hinweg verstärken. Skripte, die innerhalb des Synchronisations-Workflows — vor der Audioerzeugung — verfeinert werden, liefern besseres Timing als Skripte, die direkt von der Übersetzung zur Sprachausgabe gehen.

Stimmkonsistenz über mehrere Videos hinweg. Bei mehreren Videos desselben Sprechers variiert die Voice-Cloning-Qualität je nach Tool. Manche erzeugen ein stabiles Stimmprofil. Andere driften. Für Teams, die über eine Inhaltsbibliothek hinweg Publikumsbeziehungen aufbauen, ist Konsistenz mit der Zeit wichtiger.

Eine detaillierte Aufschlüsselung dessen, was gute Synchronisationsplattformen von nur ausreichenden unterscheidet, finden Sie in unserer Checkliste für KI-Synchronisationsplattformen.

Warum „mehr Sprachen“ die falsche Kennzahl ist

Der häufigste Fehler bei der Auswahl eines KI-Videoübersetzers ist die Optimierung auf Sprachanzahl.

HappyScribe unterstützt 120+ Sprachen. Maestra unterstützt 125+. Perso AI unterstützt 33+. In einer Vergleichstabelle sieht es so aus, als ob Maestra oder HappyScribe gewinnt.

Die Sprachanzahl ist eine Obergrenze, kein Qualitätsmaßstab. Ein Tool, das 125 Sprachen unterstützt und in Ihren drei Zielmärkten robotische Ausgaben erzeugt, ist weniger nützlich als ein Tool, das 33 Sprachen unterstützt und in denselben Märkten natürliche, glaubwürdige Ausgaben liefert.

Dennoch ist Sprachbreite für manche Teams wichtig. HappyScribe ist eine wirklich starke Wahl, wenn Sie Untertitelabdeckung über eine große Sprachvielfalt benötigen — seine Genauigkeit und die Option für menschliche Prüfung machen es zum richtigen Tool für textorientierte Workflows mit hohem Volumen. Die Abdeckung von 125+ Sprachen bei Maestra verschafft Teams, die in weniger verbreiteten Märkten arbeiten, einen Vorteil. Das sind reale Stärken, die berücksichtigt werden sollten.

Die kommerziellen Märkte für Videolokalisierung, die 2026 die meisten Ergebnisse liefern — Spanisch, Japanisch, Deutsch, Portugiesisch, Französisch, Koreanisch, Chinesisch — werden von den Top-Tools gut abgedeckt. Für diese Märkte sollte die Entscheidung von Ausgabequalität und Workflow-Passung abhängen, nicht allein von der Sprachanzahl.

Perso AI liefert Voice Cloning, Lippensynchronisation und Inline-Skriptbearbeitung in 33+ Sprachen, ab 6,99 $/Monat. In der PRO-Stufe (73 $/Monat jährlich) erhalten Teams 100 Minuten pro Monat mit hoher Verarbeitungsgeschwindigkeit, 4K-Ausgabe und 2,50 $ pro zusätzlicher Minute — wodurch die Stückkosten im großen Maßstab planbar werden.

Häufig gestellte Fragen

F: Was ist der beste KI-Videoübersetzer im Jahr 2026? A: Der beste KI-Videoübersetzer hängt von Ihrem Ausgabetyp ab. Für Untertitel über viele Sprachen hinweg deckt HappyScribe 120+ mit hoher Genauigkeit ab. Für KI-Synchronisation mit Lippensynchronisation auf realem Videomaterial liefert Perso AI den vollständigsten Workflow — Übersetzung, Voice Cloning und Lippensynchronisation in einer Pipeline über 33+ Sprachen hinweg, ab 6,99 $/Monat.

F: Was ist der Unterschied zwischen KI-Videoübersetzung und KI-Synchronisation? A: KI-Videoübersetzung ist ein Oberbegriff für Untertitel, Voiceover und KI-Synchronisation. KI-Synchronisation ersetzt konkret das Originalaudio durch eine neue Sprachspur mithilfe von Voice Cloning. KI-Synchronisation mit Lippensynchronisation verändert zusätzlich die Mundbewegungen des Sprechers passend zum neuen Audio — und erzeugt so Ausgaben, in denen der Sprecher scheinbar die Zielsprache nativ spricht.

F: Können KI-Videoübersetzer mehrere Sprecher verarbeiten? A: Die führenden Plattformen können das. Perso AI erkennt und trennt automatisch bis zu 10 unterschiedliche Sprecher in einem einzelnen Video und wendet auf jeden individuelle Voice-Cloning-Profile an. Das ist essenziell für Interviewformate, Panel-Diskussionen und Videos mit mehreren Hosts.

F: Wie viel kostet KI-Videoübersetzung im Jahr 2026? A: Reine Untertitel-Tools wie VEED beginnen bei etwa 18 $/Monat und HappyScribe bei 17 $/Monat. KI-Synchronisation mit Voice Cloning und Lippensynchronisation beginnt mit dem Starter-Plan von Perso AI bei 6,99 $/Monat (15 Minuten monatlich). Bei 100 Minuten synchronisiertem Inhalt kostet Perso AI in einem Jahresplan etwa 73 $/Monat. Zum Vergleich: Maestra erfordert für Lippensynchronisation den Business-Plan für 199 $/Monat, und HeyGen (29 $/Monat) berechnet zusätzliche Premium Credits für lippensynchronisierte Übersetzung auf realem Material.

F: Sinkt die Qualität der Videoübersetzung bei technischen oder Produktinhalten? A: Das kann passieren — besonders bei Tools ohne Glossarunterstützung. Generische KI-Übersetzungsmodelle driften bei produktspezifischer Terminologie und UI-Labels. Perso AI enthält benutzerdefinierte Glossarsteuerungen, mit denen Teams Begriffe vor der Audioerzeugung fixieren können, wodurch Terminologiefehler bei Produkt- und Tutorial-Synchronisation reduziert werden.

Die Kurzfassung

Der beste KI-Videoübersetzer im Jahr 2026 ist derjenige, der zu Ihrem Inhaltstyp passt.

Inhaltstyp | Beste Wahl |

|---|---|

Social Clips, nur Untertitel | VEED oder HappyScribe |

Erzählung, Animationen, Foliendecks | ElevenLabs Dubbing oder Murf AI |

Produktdemos, Tutorials, Creator-Inhalte |

Wenn Ihr Video eine echte Person vor der Kamera zeigt und ihre Glaubwürdigkeit Ihrem Publikum wichtig ist, sind Untertitel und Voiceover nur Workarounds. KI-Synchronisation mit präziser Lippensynchronisation ist die eigentliche Lösung.

Für einen tieferen Blick darauf, wie Synchronisationsplattformen bei Workflow und Ausgabequalität abschneiden, sehen Sie sich unseren Leitfaden zu den besten KI-Synchronisationstools für 2026 an.

Kurze Antwort

Der beste KI-Videoübersetzer im Jahr 2026 hängt davon ab, welche Ausgabe Sie tatsächlich benötigen — nicht davon, welches Tool die meisten Sprachen hat.

Nur Untertitel: HappyScribe (120+ Sprachen) oder VEED (50+ Sprachen)

Voiceover ohne Lippensynchronisation: ElevenLabs Dubbing (32 Sprachen, beste Sprachqualität)

KI-Synchronisation mit Voice Cloning und Lippensynchronisation: Perso AI (33+ Sprachen, ab 6,99 $/Monat)

Wenn Ihr Video eine echte Person vor der Kamera zeigt — eine Produktdemo, ein Tutorial oder ein Creator-Video — schließen Untertitel die Vertrauenslücke nicht. Genau hier wird die Wahl der Übersetzungsart zur eigentlichen Entscheidung.

Die meisten Teams, die nach einem KI-Videoübersetzer suchen, machen denselben Fehler: Sie wählen nach Sprachanzahl oder Preis, testen mit einem kurzen Clip, erklären es für gut genug und veröffentlichen. Drei Monate später hat die spanische Version eine geringere Wiedergabezeit als das englische Original.

Das Problem kommt fast nie von der Übersetzung selbst. Es entsteht durch die Wahl des falschen Tool-Typs für den Inhalt.

KI-Videoübersetzung ist kein einzelnes Produkt. Es sind drei grundlegend unterschiedliche Workflows — Untertitel, Voiceover und KI-Synchronisation mit Lippensynchronisation — und der Unterschied zwischen ihnen entscheidet, ob Ihre lokalisierten Inhalte tatsächlich funktionieren. Dieser Leitfaden zeigt, welcher Ausgabetyp zu welchem Inhalt passt und welche Tools in jeder Kategorie liefern.

Wie wir diese Tools bewertet haben

Wir haben sieben Tools in drei Inhaltsszenarien getestet, die die häufigsten realen Anwendungsfälle für Videoübersetzung abbilden:

Szenario A: Eine 2-minütige Produktdemo mit einem einzelnen Presenter vor der Kamera

Szenario B: Ein 4-minütiges Tutorial mit Folienübergängen und Bildschirmaufnahme

Szenario C: Eine 60-sekündige Social-Ad mit schnellen Schnitten und ohne sichtbaren Sprecher

Zielsprachen: Englisch, Spanisch, Japanisch, Deutsch und Portugiesisch.

Wir haben jedes Tool in vier Dimensionen bewertet:

Dimension | Gewichtung | Was wir gemessen haben |

|---|---|---|

Passung des Ausgabetyps | 30% | Entspricht das Tool den tatsächlichen Anforderungen des Inhalts? |

Genauigkeit der Lippensynchronisation | 30% | Ausrichtung der Mundbewegungen bei Talking-Head-Material |

Übersetzungsqualität | 25% | Terminologiegenauigkeit, natürliche Formulierungen in der Zielsprache |

Workflow-Effizienz | 15% | Schritte zwischen Upload und fertiger, veröffentlichungsreifer Ausgabe |

Wir haben Tools ausgeschlossen, die nur über Enterprise-Zugänge verfügbar sind, sowie reine Audio-Tools ohne Videoausgabe.

Die drei Arten der KI-Videoübersetzung

Bevor Sie Tools vergleichen, müssen Sie wissen, welcher Ausgabetyp zu Ihrem Inhalt passt. Die meisten Vergleichsleitfäden überspringen diesen Schritt. Dabei ist er der wichtigste.

Typ 1: Untertitelübersetzung

Die KI transkribiert das Originalaudio, übersetzt den Text und erzeugt eine Untertitelspur. Das Originalaudio bleibt unberührt. Zuschauer lesen die Übersetzung, während sie den Originalsprecher hören.

Am besten geeignet für: Social Clips, Kurzform-Inhalte, interne Videos, alle Inhalte, bei denen die Glaubwürdigkeit des Sprechers nicht der primäre Treiber für Zuschauervertrauen ist.

Einschränkung: Bei Videos, in denen eine echte Person vor der Kamera spricht — Produktdemos, Kurse, Kommunikation von Führungskräften — erzeugen Untertitel eine wahrgenommene Distanz. Laut einer Studie von Verizon Media und Publicis Media aus dem Jahr 2019 sehen sich 80% der Verbraucher eher ein vollständiges Video an, wenn Untertitel verfügbar sind, und 69% sehen Videos an öffentlichen Orten ohne Ton. Jüngst berichtete YouTube im Jahr 2025, dass Creator, die synchronisierte Audiospuren hinzugefügt haben, 25%+ ihrer Wiedergabezeit in nicht-primäre Sprachzielgruppen verlagerten. Untertitel helfen — synchronisierte Audiospuren mit Voice Cloning schließen die Lücke noch weiter.

Typ 2: Voiceover (Audio-Synchronisation ohne Lippensynchronisation)

Die KI erzeugt eine neue Audiospur in der Zielsprache, die das Original ersetzt oder darübergelegt wird. Das Video selbst bleibt unverändert — die Mundbewegungen des Sprechers entsprechen weiterhin der Originalsprache.

Am besten geeignet für: erzählungslastige Inhalte, Podcasts, Erkläranimationen, folienbasierte Präsentationen, bei denen der Sprecher nicht im visuellen Fokus steht.

Einschränkung: Bei Talking-Head-Material ist die Diskrepanz zwischen Lippenbewegung und Audio sofort sichtbar. Zuschauer spüren sie, auch wenn sie sie nicht benennen können. Bei Produktdemos und Tutorials, bei denen die Autorität des Presenters Vertrauen aufbaut, entsteht so eine Glaubwürdigkeitslücke, die schwer zu schließen ist.

Typ 3: KI-Synchronisation mit Voice Cloning und Lippensynchronisation

Die KI übersetzt das Skript, erzeugt eine per Voice Cloning erzeugte Audiospur, die Tonfall und Tempo des Originalsprechers bewahrt, und verändert die Lippenbewegungen des Sprechers passend zum neuen Audio. Der Zuschauer sieht und hört dieselbe Person in seiner Sprache sprechen.

Perso AI ist eine KI-Synchronisationsplattform, die Übersetzung, Voice Cloning in 33+ Sprachen, Lippensynchronisation und Inline-Skriptbearbeitung in einem einzigen Workflow kombiniert — speziell entwickelt für Produktdemos, Tutorials und Creator-Inhalte, bei denen die Glaubwürdigkeit des Sprechers Teil der Botschaft ist.

Am besten geeignet für: Produktdemos, Tutorials, Creator-Inhalte, Marketingkampagnen, Trainingsvideos — alle Inhalte, bei denen die Präsenz des Sprechers Teil des Werts ist.

So sieht KI-Synchronisation mit Lippensynchronisation in der Praxis aus — der Workflow von Perso AI vom Upload bis zur fertigen Ausgabe:

Die Entscheidungsregel: Wenn eine echte Person vor der Kamera ist und ihre Glaubwürdigkeit für den Zuschauer wichtig ist, benötigen Sie Typ 3. Alles andere ist ein Workaround.

Was die Tests gezeigt haben: Ergebnisse nach Inhaltstyp

Szenario A — Produktdemo (Presenter vor der Kamera)

Dies ist das Szenario, in dem die Tool-Auswahl den größten sichtbaren Unterschied macht. Der Presenter ist im Vollbild und spricht direkt in die Kamera.

Perso AI war der klare Sieger. Über 5 Sprachpaare hinweg blieb die Lippensynchronisation zwischen Audio-Peaks und Mundbewegungen über das gesamte Video hinweg konstant. Die Übersetzungsgenauigkeit war bei produktspezifischer Terminologie stark — Funktionsnamen, UI-Labels und Workflow-Beschreibungen. Der Inline-Skripteditor machte es einfach, eine holprige Übersetzungsphrase zu korrigieren, ohne das Projekt neu zu starten.

HeyGen liefert starke Ergebnisse für avatarbasierten Inhalt und ist eine solide Wahl für Teams, die neue präsentergeführte Videos aus einem Skript erzeugen. Für die Synchronisation vorhandenen Materials mit realen Personen ist seine Lippensynchronisation eher für eigene Avatar-Formate als für reales Videomaterial optimiert.

ElevenLabs Dubbing setzt den Maßstab für Sprachqualität — natürlich, ausdrucksstark und in 32 Sprachen nah an menschlicher Sprache. Es gibt nur Audio aus, ohne Videoverarbeitung oder Lippensynchronisation, und eignet sich daher am besten für erzählungslastige Inhalte oder Workflows, bei denen ein separater Videoeditor die Endmontage übernimmt.

Szenario B — Tutorial mit Folienübergängen

Bildschirmaufnahmen mit gelegentlichen Schnitten zum Presenter stellen einen gemischten Inhaltstyp dar. Lippensynchronisation ist für Presenter-Segmente wichtig; Übersetzungsqualität und Glossarkontrolle sind durchgehend wichtig.

Perso AI handhabte die Sprechererkennung über Segmentschnitte hinweg sauber. Wenn das Video zwischen Bildschirmaufnahme und Presenter vor der Kamera wechselte, blieb die Konsistenz des Sprachprofils in allen fünf getesteten Sprachen erhalten. Die Glossarfunktion fixierte Markenterminologie über das gesamte Video hinweg — kein einziger Fall, in dem Produktnamen in generische Übersetzungen abdrifteten.

Maestra schnitt bei Untertiteln und Skriptebene gut ab. Die Abdeckung von 125+ Sprachen ist breit, und der skriptbearbeitungsorientierte Workflow passt zu Teams, die exakte Formulierungen festlegen wollen, bevor Audio erzeugt wird. KI-Synchronisation mit Lippensynchronisation ist als Exportoption verfügbar.

VEED verarbeitete Untertitel für Bildschirmaufnahme-Abschnitte gut und ist eine starke Wahl für untertitelfokussierte Workflows. Das synchronisierte Audio funktioniert am besten bei kürzeren Inhalten.

Szenario C — Social-Ad (Schnelle Schnitte, kein sichtbarer Sprecher)

Bei Kurzform-Inhalten ohne Sprecher vor der Kamera ist Lippensynchronisation irrelevant. Übersetzungsgeschwindigkeit und Untertitelgenauigkeit sind entscheidend.

VEED war das schnellste Tool für untertitelorientierte Workflows — Untertitelgenerierung in 50+ Sprachen, sauberer Workflow, exportfertige SRT ohne manuelle Schritte. Sehr passend für Social-Media-Inhalte in großem Umfang.

HappyScribe lieferte hier die genaueste Transkription. Sein hybrides KI- + optionales Human-Review-Modell verschafft ihm einen Vorteil bei Audio mit Hintergrundmusik oder schnellem Sprechen. Die Untertitelunterstützung in 120+ Sprachen deckt jede Marktkombination ab.

Direkter Vergleich: Was jedes Tool tatsächlich liefert

Tool | Untertitel | Voiceover | Voice Cloning | Lippensynchronisation (reales Material) | Sprachen | Einstiegspreis |

|---|---|---|---|---|---|---|

Perso AI | ✅ | ✅ | ✅ | ✅ Klassenbeste Leistung | 33+ | 6,99 $/Monat |

VEED | ✅ | Begrenzt | ❌ | ❌ | 50+ | 18 $/Monat |

HappyScribe | ✅ | ❌ | ❌ | ❌ | 120+ | 17 $/Monat |

Maestra | ✅ | ✅ | ✅ | ✅ (Exportoption) | 125+ | 49 $/Monat |

ElevenLabs | ❌ (nur Audio) | ✅ | ✅ Klassenbeste Leistung | ❌ | 32 | 22 $/Monat |

HeyGen | ✅ | ✅ | ✅ | ✅ (nur Avatare) | 40+ | 29 $/Monat |

Murf AI | ❌ | ✅ | Begrenzt | ❌ | 20+ | 29 $/Monat |

Hinweis zur Preisgestaltung: Alle Preise entsprechen der monatlichen Abrechnung mit Stand April 2026. Die Lippensynchronisation von Perso AI ist eine optionale Funktion pro Projekt — bei Aktivierung fallen zusätzliche GPU-Credits an. Die Voiceover-Preise von Maestra beginnen bei 49 $/Monat (Basic, 120 Min., kein Voice Cloning); Voice Cloning erfordert den Premium-Plan für 99 $/Monat; der Business-Plan kostet 199 $/Monat.

Der Preis-Realitätscheck: Der Starter-Plan von Perso AI für 6,99 $/Monat enthält Voice Cloning, Multi-Speaker-Unterstützung, KI-Lippensynchronisation und 1080p-Ausgabe ohne Wasserzeichen. HeyGen (29 $/Monat) berechnet zusätzliche Premium Credits für lippensynchronisierte Übersetzung bei realem Material. ElevenLabs (Creator, 22 $/Monat) gibt nur Audio aus — kein Video, keine Lippensynchronisation. Bei Maestra ist für Lippensynchronisation der Business-Plan für 199 $/Monat erforderlich. Für Teams, die KI-Synchronisation mit Lippensynchronisation benötigen, liefert Perso AI die vollständigste Ausgabe zum niedrigsten Einstiegspreis.

Gaga D. (AI Product Owner, Health, Wellness and Fitness) bringt es auf G2 auf den Punkt: „Ich mag die KI-Synchronisationsfunktion wirklich — die Stimme klingt natürlich und passt sehr gut zum Originalsprecher.“ — Von G2 verifizierte Bewertung, Feb 2026

Jetzt kostenlos ausprobieren →

So ordnen Sie Ihren Inhalt dem richtigen Tool zu

Wenn Ihr Video hauptsächlich aus Bildschirmaufnahme, Animation oder Folien besteht: Untertitel-Tools (VEED, HappyScribe) oder Voiceover-Tools (ElevenLabs, Murf AI) sind ausreichend. Der Sprecher steht nicht im visuellen Fokus, daher beeinflusst Lippensynchronisation die Ausgabequalität nicht.

Wenn Ihr Video eine echte Person vor der Kamera zeigt, die spricht: Der Ausgabetyp ist wichtiger als das Tool. Untertitel und Voiceover geben Zuschauern Zugang zum Inhalt — aber bei Produktdemos und Tutorials, bei denen die Präsenz des Presenters Teil des Erlebnisses ist, schafft KI-Synchronisation mit Lippensynchronisation eine natürlichere Verbindung zum Publikum.

Wenn Sie in großem Umfang produzieren — mehrere Videos, mehrere Sprachen, wiederholte Kampagnen: Workflow-Integration wird ebenso wichtig wie Ausgabequalität. Die KI-Synchronisation von Perso AI verbindet Übersetzung, Voice Cloning und Lippensynchronisation in einer automatisierten Pipeline. Ein Upload. Sprachen wählen. Exportieren. Keine manuellen Zwischenschritte.

Was die Qualität der Übersetzungsausgabe tatsächlich vorhersagt

Der Unterschied zwischen Tools bei der reinen Übersetzungsgenauigkeit ist kleiner, als die meisten Teams erwarten — und selten der Punkt, an dem lokalisierte Inhalte in der Praxis scheitern.

Was häufiger scheitert:

Terminologie-Drift. Generische KI-Modelle haben Schwierigkeiten mit produktspezifischem Vokabular — Funktionsnamen, UI-Labels, Markenbegriffe. Ein übersetztes Skript, das grammatikalisch korrekt ist, aber den falschen Produktbegriff verwendet, stiftet mehr Verwirrung als eine leicht holprige Formulierung. Tools mit benutzerdefinierter Glossarunterstützung ermöglichen es Teams, Terminologie festzulegen, bevor sie die Audioebene erreicht.

Timing-Drift. Übersetztes Audio, das länger oder kürzer als das Original läuft, erzeugt Synchronisationsprobleme, die sich über ein Video hinweg verstärken. Skripte, die innerhalb des Synchronisations-Workflows — vor der Audioerzeugung — verfeinert werden, liefern besseres Timing als Skripte, die direkt von der Übersetzung zur Sprachausgabe gehen.

Stimmkonsistenz über mehrere Videos hinweg. Bei mehreren Videos desselben Sprechers variiert die Voice-Cloning-Qualität je nach Tool. Manche erzeugen ein stabiles Stimmprofil. Andere driften. Für Teams, die über eine Inhaltsbibliothek hinweg Publikumsbeziehungen aufbauen, ist Konsistenz mit der Zeit wichtiger.

Eine detaillierte Aufschlüsselung dessen, was gute Synchronisationsplattformen von nur ausreichenden unterscheidet, finden Sie in unserer Checkliste für KI-Synchronisationsplattformen.

Warum „mehr Sprachen“ die falsche Kennzahl ist

Der häufigste Fehler bei der Auswahl eines KI-Videoübersetzers ist die Optimierung auf Sprachanzahl.

HappyScribe unterstützt 120+ Sprachen. Maestra unterstützt 125+. Perso AI unterstützt 33+. In einer Vergleichstabelle sieht es so aus, als ob Maestra oder HappyScribe gewinnt.

Die Sprachanzahl ist eine Obergrenze, kein Qualitätsmaßstab. Ein Tool, das 125 Sprachen unterstützt und in Ihren drei Zielmärkten robotische Ausgaben erzeugt, ist weniger nützlich als ein Tool, das 33 Sprachen unterstützt und in denselben Märkten natürliche, glaubwürdige Ausgaben liefert.

Dennoch ist Sprachbreite für manche Teams wichtig. HappyScribe ist eine wirklich starke Wahl, wenn Sie Untertitelabdeckung über eine große Sprachvielfalt benötigen — seine Genauigkeit und die Option für menschliche Prüfung machen es zum richtigen Tool für textorientierte Workflows mit hohem Volumen. Die Abdeckung von 125+ Sprachen bei Maestra verschafft Teams, die in weniger verbreiteten Märkten arbeiten, einen Vorteil. Das sind reale Stärken, die berücksichtigt werden sollten.

Die kommerziellen Märkte für Videolokalisierung, die 2026 die meisten Ergebnisse liefern — Spanisch, Japanisch, Deutsch, Portugiesisch, Französisch, Koreanisch, Chinesisch — werden von den Top-Tools gut abgedeckt. Für diese Märkte sollte die Entscheidung von Ausgabequalität und Workflow-Passung abhängen, nicht allein von der Sprachanzahl.

Perso AI liefert Voice Cloning, Lippensynchronisation und Inline-Skriptbearbeitung in 33+ Sprachen, ab 6,99 $/Monat. In der PRO-Stufe (73 $/Monat jährlich) erhalten Teams 100 Minuten pro Monat mit hoher Verarbeitungsgeschwindigkeit, 4K-Ausgabe und 2,50 $ pro zusätzlicher Minute — wodurch die Stückkosten im großen Maßstab planbar werden.

Häufig gestellte Fragen

F: Was ist der beste KI-Videoübersetzer im Jahr 2026? A: Der beste KI-Videoübersetzer hängt von Ihrem Ausgabetyp ab. Für Untertitel über viele Sprachen hinweg deckt HappyScribe 120+ mit hoher Genauigkeit ab. Für KI-Synchronisation mit Lippensynchronisation auf realem Videomaterial liefert Perso AI den vollständigsten Workflow — Übersetzung, Voice Cloning und Lippensynchronisation in einer Pipeline über 33+ Sprachen hinweg, ab 6,99 $/Monat.

F: Was ist der Unterschied zwischen KI-Videoübersetzung und KI-Synchronisation? A: KI-Videoübersetzung ist ein Oberbegriff für Untertitel, Voiceover und KI-Synchronisation. KI-Synchronisation ersetzt konkret das Originalaudio durch eine neue Sprachspur mithilfe von Voice Cloning. KI-Synchronisation mit Lippensynchronisation verändert zusätzlich die Mundbewegungen des Sprechers passend zum neuen Audio — und erzeugt so Ausgaben, in denen der Sprecher scheinbar die Zielsprache nativ spricht.

F: Können KI-Videoübersetzer mehrere Sprecher verarbeiten? A: Die führenden Plattformen können das. Perso AI erkennt und trennt automatisch bis zu 10 unterschiedliche Sprecher in einem einzelnen Video und wendet auf jeden individuelle Voice-Cloning-Profile an. Das ist essenziell für Interviewformate, Panel-Diskussionen und Videos mit mehreren Hosts.

F: Wie viel kostet KI-Videoübersetzung im Jahr 2026? A: Reine Untertitel-Tools wie VEED beginnen bei etwa 18 $/Monat und HappyScribe bei 17 $/Monat. KI-Synchronisation mit Voice Cloning und Lippensynchronisation beginnt mit dem Starter-Plan von Perso AI bei 6,99 $/Monat (15 Minuten monatlich). Bei 100 Minuten synchronisiertem Inhalt kostet Perso AI in einem Jahresplan etwa 73 $/Monat. Zum Vergleich: Maestra erfordert für Lippensynchronisation den Business-Plan für 199 $/Monat, und HeyGen (29 $/Monat) berechnet zusätzliche Premium Credits für lippensynchronisierte Übersetzung auf realem Material.

F: Sinkt die Qualität der Videoübersetzung bei technischen oder Produktinhalten? A: Das kann passieren — besonders bei Tools ohne Glossarunterstützung. Generische KI-Übersetzungsmodelle driften bei produktspezifischer Terminologie und UI-Labels. Perso AI enthält benutzerdefinierte Glossarsteuerungen, mit denen Teams Begriffe vor der Audioerzeugung fixieren können, wodurch Terminologiefehler bei Produkt- und Tutorial-Synchronisation reduziert werden.

Die Kurzfassung

Der beste KI-Videoübersetzer im Jahr 2026 ist derjenige, der zu Ihrem Inhaltstyp passt.

Inhaltstyp | Beste Wahl |

|---|---|

Social Clips, nur Untertitel | VEED oder HappyScribe |

Erzählung, Animationen, Foliendecks | ElevenLabs Dubbing oder Murf AI |

Produktdemos, Tutorials, Creator-Inhalte |

Wenn Ihr Video eine echte Person vor der Kamera zeigt und ihre Glaubwürdigkeit Ihrem Publikum wichtig ist, sind Untertitel und Voiceover nur Workarounds. KI-Synchronisation mit präziser Lippensynchronisation ist die eigentliche Lösung.

Für einen tieferen Blick darauf, wie Synchronisationsplattformen bei Workflow und Ausgabequalität abschneiden, sehen Sie sich unseren Leitfaden zu den besten KI-Synchronisationstools für 2026 an.

Weiterlesen

Alle durchsuchen

PRODUKT

ANWENDUNGSFALL

RESSOURCE

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618

PRODUKT

ANWENDUNGSFALL

RESSOURCE

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618

PRODUKT

ANWENDUNGSFALL

RESSOURCE

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618