Cómo enseñar a la IA a dudar: computación en tiempo de inferencia y el arte de la traducción meditada

Última actualización

Ir a la sección

Ir a la sección

Compartir

Compartir

Compartir

Herramienta de Traducción de Video AI, Localización y Doblaje

Pruébalo gratis

Cómo enseñarle a la IA a titubear

Hace unos días, me encontré con un clip de YouTube. El presentador de noticias Sohn Suk-hee estaba entrevistando a la novelista Kim Ae-ran. La pregunta era "¿Qué tiene un ser humano que la IA no tiene?", y su respuesta fue "Titubeo."

La novelista recordó un momento de una de las viejas emisiones del presentador. Mientras daba la noticia de la muerte del fallecido Roh Hoe-chan, activista laboral convertido en político, se quedó sin palabras durante veinte segundos. El momento de contener las palabras, vacilar y discernir—el titubeo. La IA es incapaz de esto. Sin embargo, el titubeo de una persona se convierte en consuelo y cortesía.

Fue hace unos veinte años, cuando yo estaba centrado en desarrollar un juego de disparos. Un compañero del modelado de personajes en 3D me entregó un libro diciendo: "Un amigo mío del instituto es novelista; deberías leer esto." Observaciones profundas salpicadas de ingenio. Quedé completamente absorbido. El libro era la colección de relatos cortos de Kim Ae-ran Run, Daddy, Run (달려라 아비). He sido fan suyo desde entonces.

El titubeo requiere tiempo y menor certeza

Kim Ae-ran dijo que sus músculos de la escritura se fortalecieron mediante un cuidado minucioso y una autoindagación en cada línea. Dijo que el tiempo entre frases se convierte en consideración por los demás. También sugirió que el verdadero valor de la literatura no reside en el contenido, sino en su forma. Entonces, si la forma también importa, ¿quizá la IA pueda imitarla al menos de manera aproximada?

Desde el punto de vista de la física, el tiempo es un cambio en el estado físico. En física, si el estado no cambia, el tiempo no ha pasado. Por tanto, menos cambio de estado equivale a un tiempo más lento y más cambio equivale a más tiempo. Un segundo fugaz para un ser humano es, para la IA, una eternidad extendida a lo largo de cientos de miles de millones, incluso billones, de operaciones de coma flotante (FLOPs). En comparación con el software del pasado, las respuestas de la IA reciente son el producto de un trabajo largo y agónico. Esta es también la razón por la que la industria de la IA puede crecer en ingresos mientras lucha por ser rentable. Desde el punto de vista del software heredado, la IA es demasiado lenta para una máquina. Incluso algo tan simple como la validación del formato JSON, cuando se ejecuta mediante inferencia de grandes modelos de lenguaje, cuesta cientos de millones de cómputos en comparación con el software heredado.

Los modelos de lenguaje grandes (LLMs), el motor del reciente progreso de la IA, son programas que predicen la siguiente palabra de una oración. La IA hace circular corriente eléctrica para encontrar la siguiente palabra. Multiplica y suma repetidamente enormes matrices. El cómputo de la IA requiere consumo físico de hardware. Para dotar a la IA al menos de una forma de titubeo, el tiempo de agonía humano, se la somete a un cómputo intenso. Cientos de miles de millones de operaciones para producir una sola siguiente palabra. Otros cientos de miles de millones de operaciones siguen para producir la palabra posterior.

La mayoría de los cálculos de aprendizaje profundo contemporáneo implican sumas ponderadas, y los valores precalculados utilizados en estas sumas se conocen como parámetros.

Cuando hablamos del modelo 'Qwen 3.6 27B', significa que hay 27 mil millones de parámetros listos para la suma de pesos, lo que requiere unos 27 mil millones de multiplicaciones para predecir solo un único token siguiente. Y eso es solo el comienzo. Además, una sola multiplicación de enteros implica decenas de operaciones lógicas y una de coma flotante requiere miles. Dada tal complejidad, uno podría llamarlo alucinante.

Bajar la temperatura agudiza el sesgo

Vamos a mirar más de cerca cómo funcionan los LLM. Se ha convertido en conocimiento común que el aprendizaje profundo, la base de los LLM, es una máquina de emparejamiento de patrones que aplica patrones memorizados durante el entrenamiento al uso en el mundo real. Dos cosas gobiernan ese proceso de regurgitación: el muestreo de tokens y la temperatura.

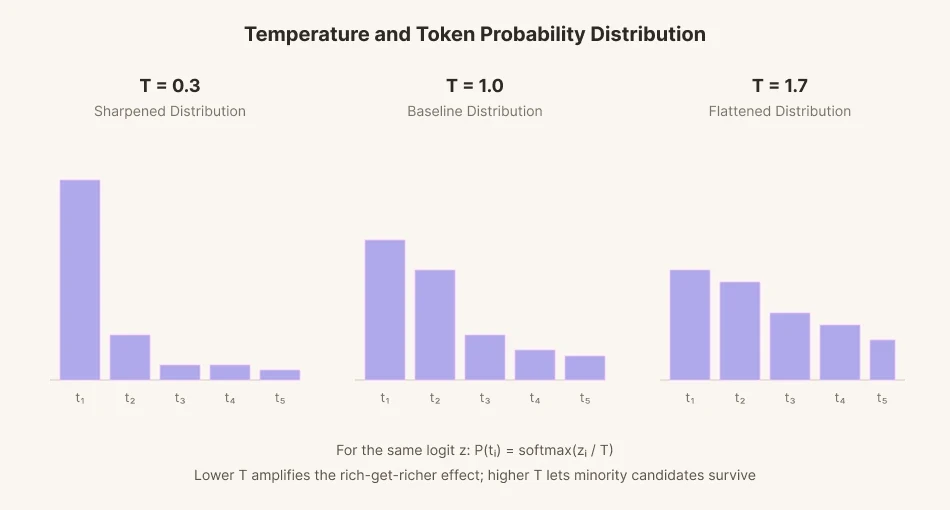

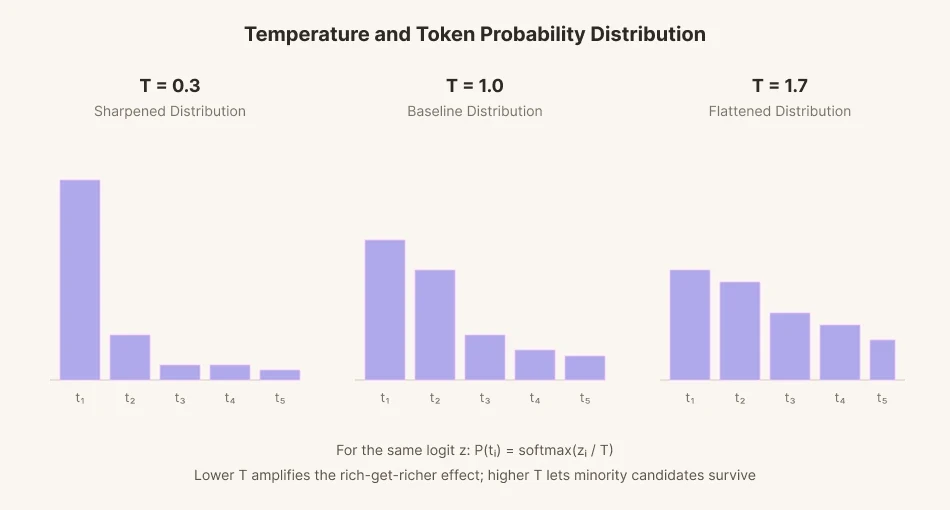

Para predecir una sola palabra siguiente, el modelo asigna una puntuación (logit) a cada una de decenas de miles de palabras candidatas. Luego esas puntuaciones se convierten en probabilidades, y se selecciona una palabra en proporción a cada probabilidad. Este proceso se llama muestreo.

Para añadir variación al muestreo, se introdujo un parámetro matemático llamado 'temperatura'. Cuanto más baja es la temperatura, más se ensancha la diferencia entre las puntuaciones candidatas hasta los extremos. Las palabras con alta probabilidad se eligen más a menudo que las palabras de base. Las palabras con baja probabilidad se eligen aún menos. Es similar a cómo los ricos se hacen más ricos y los pobres más pobres. Por el contrario, la brecha se estrecha cuando aumenta la temperatura. La brecha se aplana y se nivela. Las palabras de baja probabilidad que normalmente se habrían pasado por alto pueden seleccionarse con mayor frecuencia cuando sube la temperatura.

El lenguaje humano es similar a esto. El grupo y la cultura a los que pertenezco se reflejan en la distribución de probabilidad de mi idioma. Un lenguaje más frío y más nítido produce un habla más racional, más optimizada y más alineada con la mayoría. Un lenguaje más cálido y redondeado es menos racional y menos optimizado, pero tiene en cuenta a la minoría.

La consideración es el acto de gastar energía extra para salir de la distribución de probabilidad de los propios pensamientos. Significa notar aquello que la mayoría oculta, y encontrar frases que normalmente no se usan. Lo que el escritor describió como un proceso de escritura minucioso, para la IA debería convertirse en un acto de rechazar respuestas basadas solo en un entrenamiento sesgado, y esforzarse por ir más allá.

Cavilación mecánica

¿Cómo podríamos enseñar a la IA a ser considerada? No puedes dejar que escupa de inmediato la palabra de mayor probabilidad. Eso solo exporta los sesgos inherentes en los datos de entrenamiento.

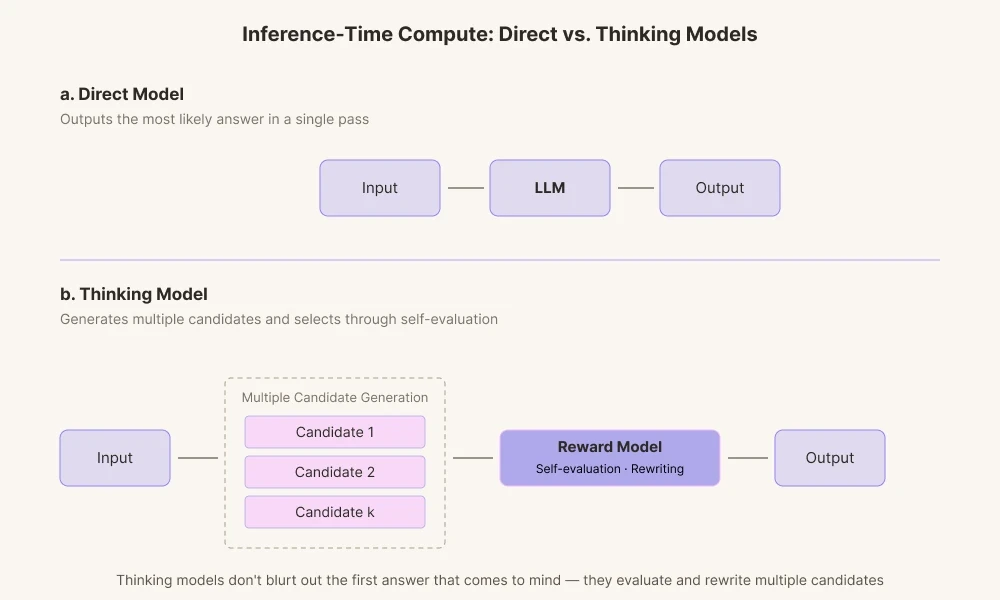

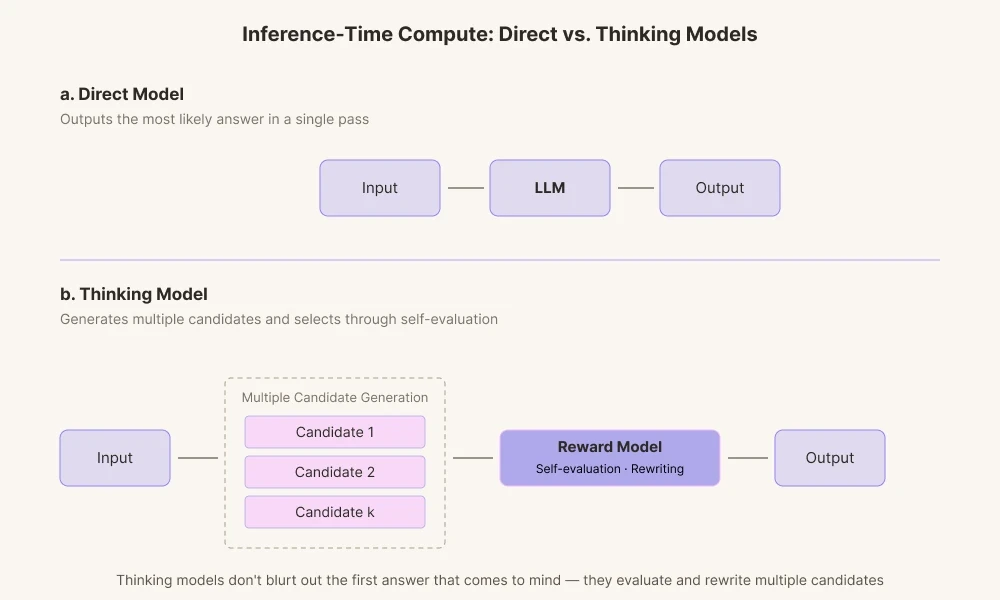

La razón por la que los modelos de IA de hoy logran resultados tan llamativos es que el campo ha avanzado en una tecnología centrada en el 'cómputo en tiempo de inferencia'. Es una tecnología que le da a la IA más tiempo de cómputo antes de responder. Los modelos de IA del pasado simplemente devolvían la primera respuesta calculada, en otras palabras, la respuesta que se les venía primero a la mente. En contraste, los modelos pensantes de hoy generan múltiples caminos de razonamiento.

Producen varias respuestas candidatas y las evalúan mediante su modelo de recompensa intrínseco. Recorre el proceso de comprobar si las palabras encajan en el contexto y si le suenan demasiado definitivas, y luego las descarta internamente si es necesario.

Esto es similar a cómo los humanos revisan las frases en la mente antes de hablar. En lugar de exigir a la IA que entregue una respuesta lo más precisa posible basándose en distribuciones de probabilidad, se gastan recursos de cómputo para darle tiempo a revisar. La dejamos vagar desde el centro de la masa de probabilidad hacia los bordes: una especie de cavilación mecánica.

Cavilación en la traducción de vídeo

La traducción ordinaria termina una vez que el significado encaja, pero la traducción de vídeo requiere no solo un significado preciso, sino también que la duración y el ritmo de los movimientos labiales coincidan.

Si un actor en pantalla mueve la boca durante 1,8 segundos y pronuncia 11 sílabas en inglés, el traductor tiene que construir una línea en coreano que quepa dentro de esos 1,8 segundos. Conserva el significado y la duración se desajusta. Igualas la duración y el significado se difumina. Cuando las consonantes finales y las vocales abiertas son distintas del original, el espectador siente que algo no encaja en el momento en que lo ve. Los subtítulos añaden otra restricción: 12 a 15 caracteres por segundo de velocidad de lectura. Así que un traductor que trabaja con doblaje dispone cinco líneas de significado equivalente, cuenta sílabas, iguala acentos y elige no la traducción más exacta sino la que pierde menos dentro de las restricciones.

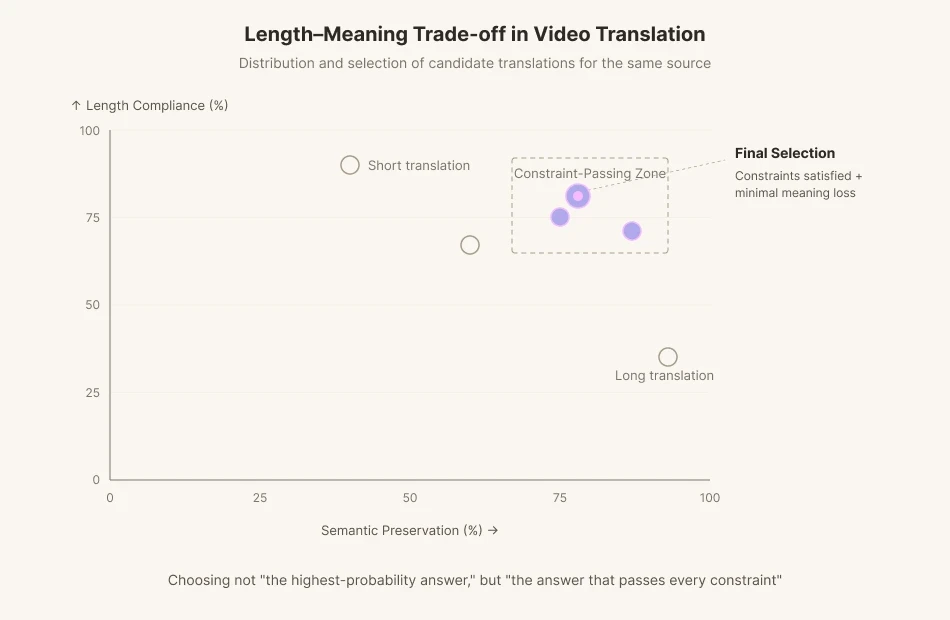

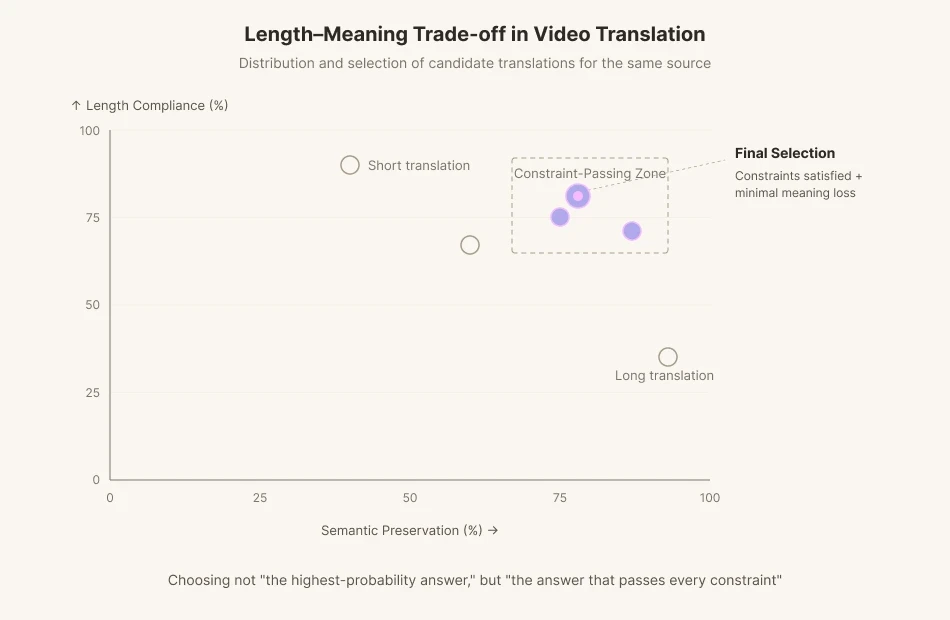

El equipo de traducción de Perso AI ha estado trabajando exactamente en este problema. El equipo publicó un artículo en EMNLP (https://aclanthology.org/2025.emnlp-demos.37) que cuantifica el compromiso entre Isocronía (cumplimiento de la duración) y Alineación semántica en la traducción de vídeo.

EMNLP (Empirical Methods in Natural Language Processing) es un foro de primer nivel en procesamiento del lenguaje natural. Fiel a su nombre, valora la investigación empírica que demuestra la eficacia real de una tecnología mediante datos y experimentos, más que las hipótesis puramente teóricas. En consonancia con ese carácter, el artículo del equipo de investigación de ESTsoft aborda un problema difícil en la traducción de vídeo, lo cuantifica con datos y lo resuelve con un algoritmo. Una contribución práctica y real.

La cuestión clave que tiene en cuenta la canalización de doblaje de Perso AI está aquí. No los caracteres, no las sílabas, sino el fonema, que es la unidad más pequeña del habla. Los caracteres y las sílabas son unidades en la pantalla; los fonemas corresponden al tiempo realmente pasado en la boca. El algoritmo propuesto en el artículo, CountPhonemes, cuenta el número de fonemas de la frase traducida, lo compara con el número objetivo de fonemas y revisa la frase para alinear ambos.

Los modelos de traducción automática existentes están optimizados para métricas de preservación del significado como BLEU y COMET. Están entrenados para ofrecer la traducción más plausible, lo más rápido posible. Pero la traducción de vídeo a veces tiene que rechazar la más plausible. Cuando los fonemas se quedan cortos, hay que renunciar a parte del significado y encontrar otra formulación. No le pedimos a la IA "la respuesta de mayor probabilidad" sino "la respuesta que supera todas las restricciones".

Esto es exactamente lo que resuelve la canalización de doblaje de Perso AI. En la etapa de traducción, el sistema genera muchos candidatos que cumplen las restricciones de duración y fonemas, y luego elige el que tiene la menor pérdida semántica. Es la idea de cómputo en tiempo de inferencia de la sección anterior, trasladada al dominio del doblaje. Evita que el modelo suelte la primera respuesta que se le ocurra. Haz que reescriba. Haz que verifique. Esta traducción iterativa es una vacilación deliberada impuesta a la máquina. Dentro de un bucle iterativo de retroalimentación, el modelo persigue el óptimo entre el cumplimiento de la duración (Isocronía) y la alineación del significado (Alineación semántica). Es el trabajo de trasplantar la agonía del traductor de vídeo al propio modelo.

Para terminar

El titubeo no es mera imperfección, ni mero ralentizamiento. Es la acumulación del tiempo dedicado a considerar a los demás. Si alguna vez la IA aprende a hacer una pausa por consideración, no será porque el modelo se haya vuelto más inteligente. Será porque la diseñamos para ser menos segura, para demorarse más, para vacilar.

Cómo enseñarle a la IA a titubear

Hace unos días, me encontré con un clip de YouTube. El presentador de noticias Sohn Suk-hee estaba entrevistando a la novelista Kim Ae-ran. La pregunta era "¿Qué tiene un ser humano que la IA no tiene?", y su respuesta fue "Titubeo."

La novelista recordó un momento de una de las viejas emisiones del presentador. Mientras daba la noticia de la muerte del fallecido Roh Hoe-chan, activista laboral convertido en político, se quedó sin palabras durante veinte segundos. El momento de contener las palabras, vacilar y discernir—el titubeo. La IA es incapaz de esto. Sin embargo, el titubeo de una persona se convierte en consuelo y cortesía.

Fue hace unos veinte años, cuando yo estaba centrado en desarrollar un juego de disparos. Un compañero del modelado de personajes en 3D me entregó un libro diciendo: "Un amigo mío del instituto es novelista; deberías leer esto." Observaciones profundas salpicadas de ingenio. Quedé completamente absorbido. El libro era la colección de relatos cortos de Kim Ae-ran Run, Daddy, Run (달려라 아비). He sido fan suyo desde entonces.

El titubeo requiere tiempo y menor certeza

Kim Ae-ran dijo que sus músculos de la escritura se fortalecieron mediante un cuidado minucioso y una autoindagación en cada línea. Dijo que el tiempo entre frases se convierte en consideración por los demás. También sugirió que el verdadero valor de la literatura no reside en el contenido, sino en su forma. Entonces, si la forma también importa, ¿quizá la IA pueda imitarla al menos de manera aproximada?

Desde el punto de vista de la física, el tiempo es un cambio en el estado físico. En física, si el estado no cambia, el tiempo no ha pasado. Por tanto, menos cambio de estado equivale a un tiempo más lento y más cambio equivale a más tiempo. Un segundo fugaz para un ser humano es, para la IA, una eternidad extendida a lo largo de cientos de miles de millones, incluso billones, de operaciones de coma flotante (FLOPs). En comparación con el software del pasado, las respuestas de la IA reciente son el producto de un trabajo largo y agónico. Esta es también la razón por la que la industria de la IA puede crecer en ingresos mientras lucha por ser rentable. Desde el punto de vista del software heredado, la IA es demasiado lenta para una máquina. Incluso algo tan simple como la validación del formato JSON, cuando se ejecuta mediante inferencia de grandes modelos de lenguaje, cuesta cientos de millones de cómputos en comparación con el software heredado.

Los modelos de lenguaje grandes (LLMs), el motor del reciente progreso de la IA, son programas que predicen la siguiente palabra de una oración. La IA hace circular corriente eléctrica para encontrar la siguiente palabra. Multiplica y suma repetidamente enormes matrices. El cómputo de la IA requiere consumo físico de hardware. Para dotar a la IA al menos de una forma de titubeo, el tiempo de agonía humano, se la somete a un cómputo intenso. Cientos de miles de millones de operaciones para producir una sola siguiente palabra. Otros cientos de miles de millones de operaciones siguen para producir la palabra posterior.

La mayoría de los cálculos de aprendizaje profundo contemporáneo implican sumas ponderadas, y los valores precalculados utilizados en estas sumas se conocen como parámetros.

Cuando hablamos del modelo 'Qwen 3.6 27B', significa que hay 27 mil millones de parámetros listos para la suma de pesos, lo que requiere unos 27 mil millones de multiplicaciones para predecir solo un único token siguiente. Y eso es solo el comienzo. Además, una sola multiplicación de enteros implica decenas de operaciones lógicas y una de coma flotante requiere miles. Dada tal complejidad, uno podría llamarlo alucinante.

Bajar la temperatura agudiza el sesgo

Vamos a mirar más de cerca cómo funcionan los LLM. Se ha convertido en conocimiento común que el aprendizaje profundo, la base de los LLM, es una máquina de emparejamiento de patrones que aplica patrones memorizados durante el entrenamiento al uso en el mundo real. Dos cosas gobiernan ese proceso de regurgitación: el muestreo de tokens y la temperatura.

Para predecir una sola palabra siguiente, el modelo asigna una puntuación (logit) a cada una de decenas de miles de palabras candidatas. Luego esas puntuaciones se convierten en probabilidades, y se selecciona una palabra en proporción a cada probabilidad. Este proceso se llama muestreo.

Para añadir variación al muestreo, se introdujo un parámetro matemático llamado 'temperatura'. Cuanto más baja es la temperatura, más se ensancha la diferencia entre las puntuaciones candidatas hasta los extremos. Las palabras con alta probabilidad se eligen más a menudo que las palabras de base. Las palabras con baja probabilidad se eligen aún menos. Es similar a cómo los ricos se hacen más ricos y los pobres más pobres. Por el contrario, la brecha se estrecha cuando aumenta la temperatura. La brecha se aplana y se nivela. Las palabras de baja probabilidad que normalmente se habrían pasado por alto pueden seleccionarse con mayor frecuencia cuando sube la temperatura.

El lenguaje humano es similar a esto. El grupo y la cultura a los que pertenezco se reflejan en la distribución de probabilidad de mi idioma. Un lenguaje más frío y más nítido produce un habla más racional, más optimizada y más alineada con la mayoría. Un lenguaje más cálido y redondeado es menos racional y menos optimizado, pero tiene en cuenta a la minoría.

La consideración es el acto de gastar energía extra para salir de la distribución de probabilidad de los propios pensamientos. Significa notar aquello que la mayoría oculta, y encontrar frases que normalmente no se usan. Lo que el escritor describió como un proceso de escritura minucioso, para la IA debería convertirse en un acto de rechazar respuestas basadas solo en un entrenamiento sesgado, y esforzarse por ir más allá.

Cavilación mecánica

¿Cómo podríamos enseñar a la IA a ser considerada? No puedes dejar que escupa de inmediato la palabra de mayor probabilidad. Eso solo exporta los sesgos inherentes en los datos de entrenamiento.

La razón por la que los modelos de IA de hoy logran resultados tan llamativos es que el campo ha avanzado en una tecnología centrada en el 'cómputo en tiempo de inferencia'. Es una tecnología que le da a la IA más tiempo de cómputo antes de responder. Los modelos de IA del pasado simplemente devolvían la primera respuesta calculada, en otras palabras, la respuesta que se les venía primero a la mente. En contraste, los modelos pensantes de hoy generan múltiples caminos de razonamiento.

Producen varias respuestas candidatas y las evalúan mediante su modelo de recompensa intrínseco. Recorre el proceso de comprobar si las palabras encajan en el contexto y si le suenan demasiado definitivas, y luego las descarta internamente si es necesario.

Esto es similar a cómo los humanos revisan las frases en la mente antes de hablar. En lugar de exigir a la IA que entregue una respuesta lo más precisa posible basándose en distribuciones de probabilidad, se gastan recursos de cómputo para darle tiempo a revisar. La dejamos vagar desde el centro de la masa de probabilidad hacia los bordes: una especie de cavilación mecánica.

Cavilación en la traducción de vídeo

La traducción ordinaria termina una vez que el significado encaja, pero la traducción de vídeo requiere no solo un significado preciso, sino también que la duración y el ritmo de los movimientos labiales coincidan.

Si un actor en pantalla mueve la boca durante 1,8 segundos y pronuncia 11 sílabas en inglés, el traductor tiene que construir una línea en coreano que quepa dentro de esos 1,8 segundos. Conserva el significado y la duración se desajusta. Igualas la duración y el significado se difumina. Cuando las consonantes finales y las vocales abiertas son distintas del original, el espectador siente que algo no encaja en el momento en que lo ve. Los subtítulos añaden otra restricción: 12 a 15 caracteres por segundo de velocidad de lectura. Así que un traductor que trabaja con doblaje dispone cinco líneas de significado equivalente, cuenta sílabas, iguala acentos y elige no la traducción más exacta sino la que pierde menos dentro de las restricciones.

El equipo de traducción de Perso AI ha estado trabajando exactamente en este problema. El equipo publicó un artículo en EMNLP (https://aclanthology.org/2025.emnlp-demos.37) que cuantifica el compromiso entre Isocronía (cumplimiento de la duración) y Alineación semántica en la traducción de vídeo.

EMNLP (Empirical Methods in Natural Language Processing) es un foro de primer nivel en procesamiento del lenguaje natural. Fiel a su nombre, valora la investigación empírica que demuestra la eficacia real de una tecnología mediante datos y experimentos, más que las hipótesis puramente teóricas. En consonancia con ese carácter, el artículo del equipo de investigación de ESTsoft aborda un problema difícil en la traducción de vídeo, lo cuantifica con datos y lo resuelve con un algoritmo. Una contribución práctica y real.

La cuestión clave que tiene en cuenta la canalización de doblaje de Perso AI está aquí. No los caracteres, no las sílabas, sino el fonema, que es la unidad más pequeña del habla. Los caracteres y las sílabas son unidades en la pantalla; los fonemas corresponden al tiempo realmente pasado en la boca. El algoritmo propuesto en el artículo, CountPhonemes, cuenta el número de fonemas de la frase traducida, lo compara con el número objetivo de fonemas y revisa la frase para alinear ambos.

Los modelos de traducción automática existentes están optimizados para métricas de preservación del significado como BLEU y COMET. Están entrenados para ofrecer la traducción más plausible, lo más rápido posible. Pero la traducción de vídeo a veces tiene que rechazar la más plausible. Cuando los fonemas se quedan cortos, hay que renunciar a parte del significado y encontrar otra formulación. No le pedimos a la IA "la respuesta de mayor probabilidad" sino "la respuesta que supera todas las restricciones".

Esto es exactamente lo que resuelve la canalización de doblaje de Perso AI. En la etapa de traducción, el sistema genera muchos candidatos que cumplen las restricciones de duración y fonemas, y luego elige el que tiene la menor pérdida semántica. Es la idea de cómputo en tiempo de inferencia de la sección anterior, trasladada al dominio del doblaje. Evita que el modelo suelte la primera respuesta que se le ocurra. Haz que reescriba. Haz que verifique. Esta traducción iterativa es una vacilación deliberada impuesta a la máquina. Dentro de un bucle iterativo de retroalimentación, el modelo persigue el óptimo entre el cumplimiento de la duración (Isocronía) y la alineación del significado (Alineación semántica). Es el trabajo de trasplantar la agonía del traductor de vídeo al propio modelo.

Para terminar

El titubeo no es mera imperfección, ni mero ralentizamiento. Es la acumulación del tiempo dedicado a considerar a los demás. Si alguna vez la IA aprende a hacer una pausa por consideración, no será porque el modelo se haya vuelto más inteligente. Será porque la diseñamos para ser menos segura, para demorarse más, para vacilar.

Seguir Leyendo

Explorar todo

PRODUCTO

CASO DE USO

RECURSO

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618

PRODUCTO

CASO DE USO

RECURSO

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618

PRODUCTO

CASO DE USO

RECURSO

ESTsoft Inc. 15770 Laguna Canyon Rd #250, Irvine, CA 92618